简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

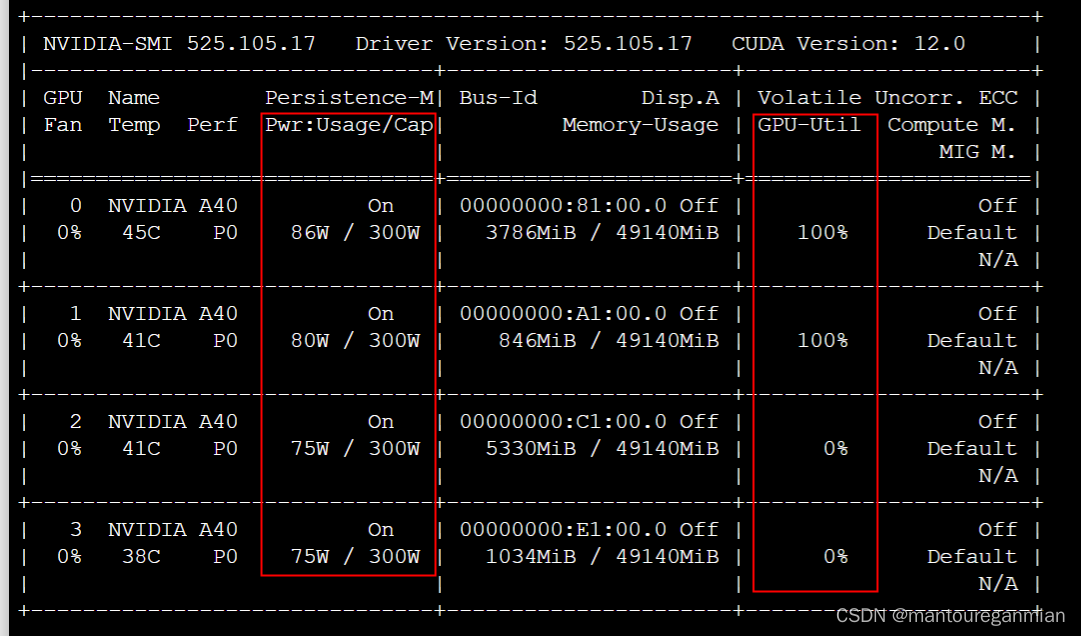

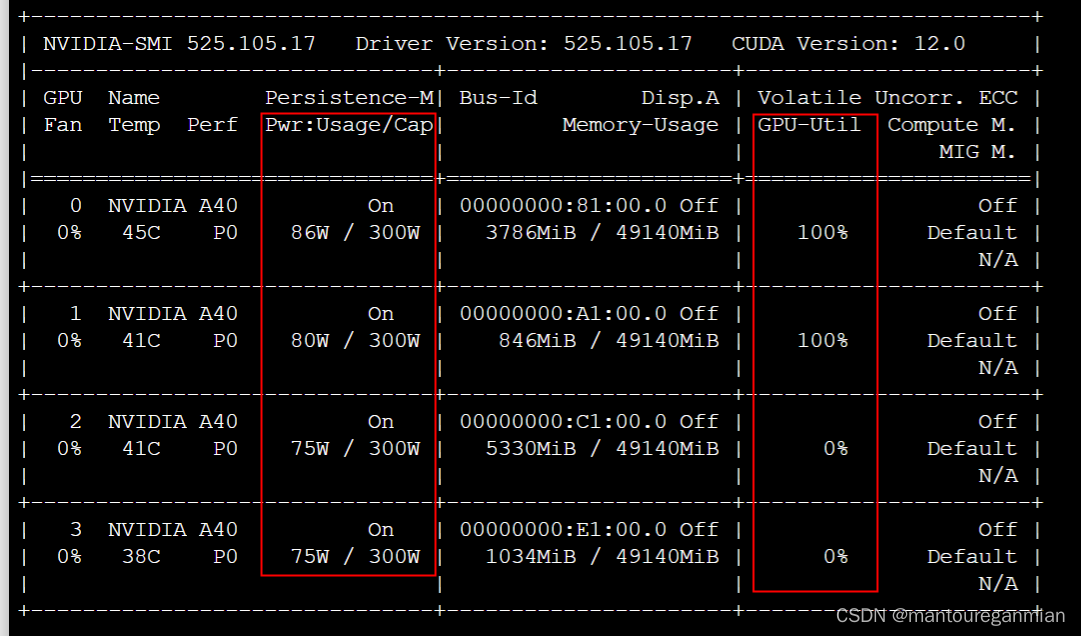

三个人,一个在举重,一个人在跑步,一个人在走路。他们都在运动,都是忙碌的,也就是GPU-Util占用高。但是很显然举重的,对外做功高,跑步的做功低,走路的最差,也就是GPU的耗电情况。如下所示,其表格中,有这么多参数,且参数名与值的其位置是一一对应的。我用不同颜色进行标识,同一种颜色的方框和箭头,标识出参数名和其值的位置关系。Pwr是指GPU运行时耗电情况,如图中GPU满载是300W,目前是86W

三个人,一个在举重,一个人在跑步,一个人在走路。他们都在运动,都是忙碌的,也就是GPU-Util占用高。但是很显然举重的,对外做功高,跑步的做功低,走路的最差,也就是GPU的耗电情况。如下所示,其表格中,有这么多参数,且参数名与值的其位置是一一对应的。我用不同颜色进行标识,同一种颜色的方框和箭头,标识出参数名和其值的位置关系。Pwr是指GPU运行时耗电情况,如图中GPU满载是300W,目前是86W

如何施加一定的变形呢,而且还不会把模型搞为白痴呢,而且施加的形变太小,容易没啥用,施加的太大又容易搞错边界。作者提出对每个样本施加一个梯度变化方向上的。在NLP领域,每个样本最后会变成embedding,输入到模型进行预测。所以只需要对embedding层进行施加变化就好。FGM核心思想是:在训练时对样本施加一定的变形,从而提升模型的健壮性。,即可以解决此问题。先想再做,对比总结!

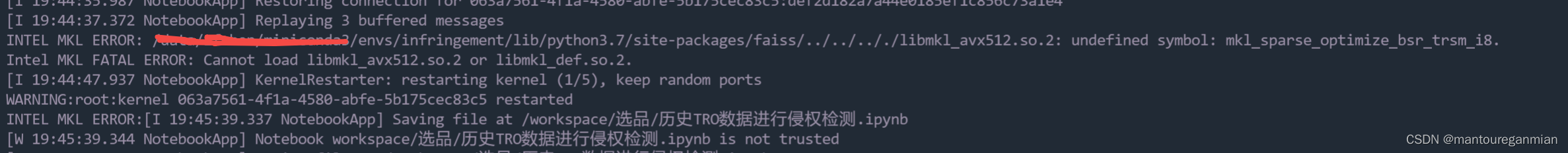

jupyter内核似乎挂掉了 它很快将自动重启NTEL MKL ERROR:Intel MKL FATAL ERROR: Cannot load libmkl_avx512.so.2 or libmkl_def.so.2.

在补《信息熵基础》,此书理论清晰,后面还有一堆要命的习题,加深理解和应用,实乃佳作。其中一些题目对我来说确实不易,记录巩固一下,也和大家交流一下。文章目录一、硬币称重问题描述二、解答2.1第一问2.2第二问2.1.1第一次称重方案2.1.2 最后一次称重方案2.1.3 第二次称重方案2.1.3.1 相等2.1.3.2 不相等三、总结四、参考文献一、硬币称重问题描述n枚硬币,可能有一枚假币,...