简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

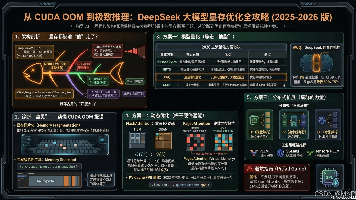

本文深入剖析大模型部署中的显存瓶颈问题,以DeepSeek-V3为例,系统分析显存占用的四大来源(模型权重、KV缓存、激活值、运行时上下文),并通过量化、动态优化、分布式扩展等策略提供解决方案。文章包含工业级诊断工具和实战代码,帮助开发者在资源受限环境下高效部署大模型,涵盖INT8/INT4量化、FlashAttention优化及vLLM集群部署等关键技术。

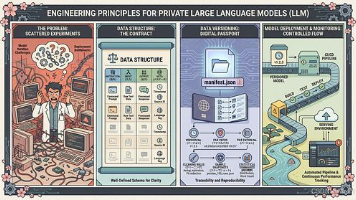

本文揭示了私有化大模型落地失败的核心原因——缺乏工程闭环,而非技术问题。作者提出标准化实践路径:1) 定义结构化数据契约;2) 通过manifest实现数据版本化;3) 使用Axolotl确保训练可复现;4) 构建回归集作为上线门禁;5) 建立失败样本反馈机制。文章强调模型交付应从"实验室玄学"转为包含数据治理、训练编排、评测验证的工程体系,并提供7天实施清单和验收标准,帮助开

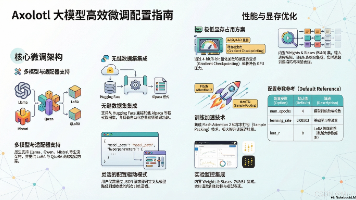

Axolotl 通过配置声明式微调解决大模型训练工程难题:将复杂的训练代码转化为标准化配置请求,实现跨环境一致性训练。它整合量化训练、显存优化(4bit/8bit)、样本打包(Sample Packing)和注意力加速(Flash Attention)等技术,使中端显卡(如4090)也能高效微调大模型。支持多模型家族统一接口,内置监控推送功能,将训练过程服务化。典型配置仅需声明模型参数、数据集和训

OpenClaw作为2026年爆发的AI Agent框架,凭借模块化设计、多模型支持和强化学习能力,正在重塑AI应用开发范式。本文从架构设计到实战部署,详细介绍了在Windows环境下搭建OpenClaw系统的全流程,包括硬件配置、安装指南、智谱GLM-4模型集成,以及强化学习调优等关键技术。通过高校智能助教系统的案例,展示了如何实现从基础对话到自主进化的完整AI Agent闭环。文章特别强调GR

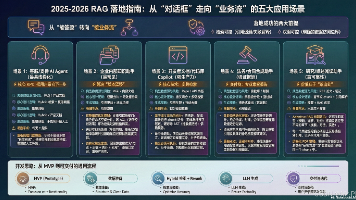

本文从工程实践角度剖析了当前最具商业价值的五大RAG应用场景,揭示了传统方法的三大致命漏洞:语义相似度陷阱、权限裸奔问题和黑盒生成风险。文章指出2025年工业级RAG的核心KPI已转变为检索可控性和权限可控性,并重点分析了客服AI Agent、企业知识助手和代码库Copilot三大深水区应用。

OpenClaw作为2026年爆发的AI Agent框架,凭借模块化设计、多模型支持和强化学习能力,正在重塑AI应用开发范式。本文从架构设计到实战部署,详细介绍了在Windows环境下搭建OpenClaw系统的全流程,包括硬件配置、安装指南、智谱GLM-4模型集成,以及强化学习调优等关键技术。通过高校智能助教系统的案例,展示了如何实现从基础对话到自主进化的完整AI Agent闭环。文章特别强调GR

本文深度拆解了2026年科研“全栈自动化”的演进之路:AI已从单纯的提效工具,跃升为重构科研的底层范式。借助“选题三角模型”、多智能体自动化工作流、“红队预审”防拒稿机制与“多模型路由”修回策略,AI将接管90%的繁重执行任务。未来科研的核心竞争力,将彻底回归人类高价值的深度思考与学术伦理坚守。

OpenClaw作为2026年爆发的AI Agent框架,凭借模块化设计、多模型支持和强化学习能力,正在重塑AI应用开发范式。本文从架构设计到实战部署,详细介绍了在Windows环境下搭建OpenClaw系统的全流程,包括硬件配置、安装指南、智谱GLM-4模型集成,以及强化学习调优等关键技术。通过高校智能助教系统的案例,展示了如何实现从基础对话到自主进化的完整AI Agent闭环。文章特别强调GR

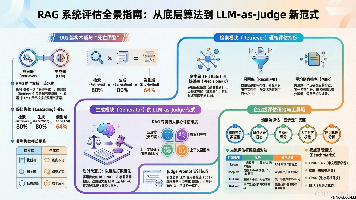

RAG系统评估:从检索到生成的全面优化 RAG(检索增强生成)系统结合了信息检索与大模型生成能力,但实际应用中常面临检索不准、生成幻觉等问题。本文系统性拆解RAG评估方法: 双核架构特性 检索器决定上下文质量,生成器影响答案准确性 级联误差导致端到端性能急剧下降(如80%检索+80%生成≈64%准确率) 检索模块评估 核心指标:Recall@K、MRR、NDCG 工程实现:Python代码示例展示

本文提出了一套智能舆情报告生成系统的工程化建设方案,核心聚焦于构建可追溯、可审计的完整生产链路,而非孤立的技术模块。系统分为三期实施:Phase1建立数据闭环(源管理→爬取→清洗→审核→导出),Phase2增强智能化能力(情感分析、AI报告生成),Phase3扩展为实时预警平台。文章强调数据资产标准化优先于AI应用,推荐采用Streamlit+RAG+模块化管道的架构,通过检索增强生成技术解决大模