简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

基于qwen1.0 和lora微调,训练自己的对话机器人

使用命令行前,请确保已经通过pip install modelscope 安装ModelScope。

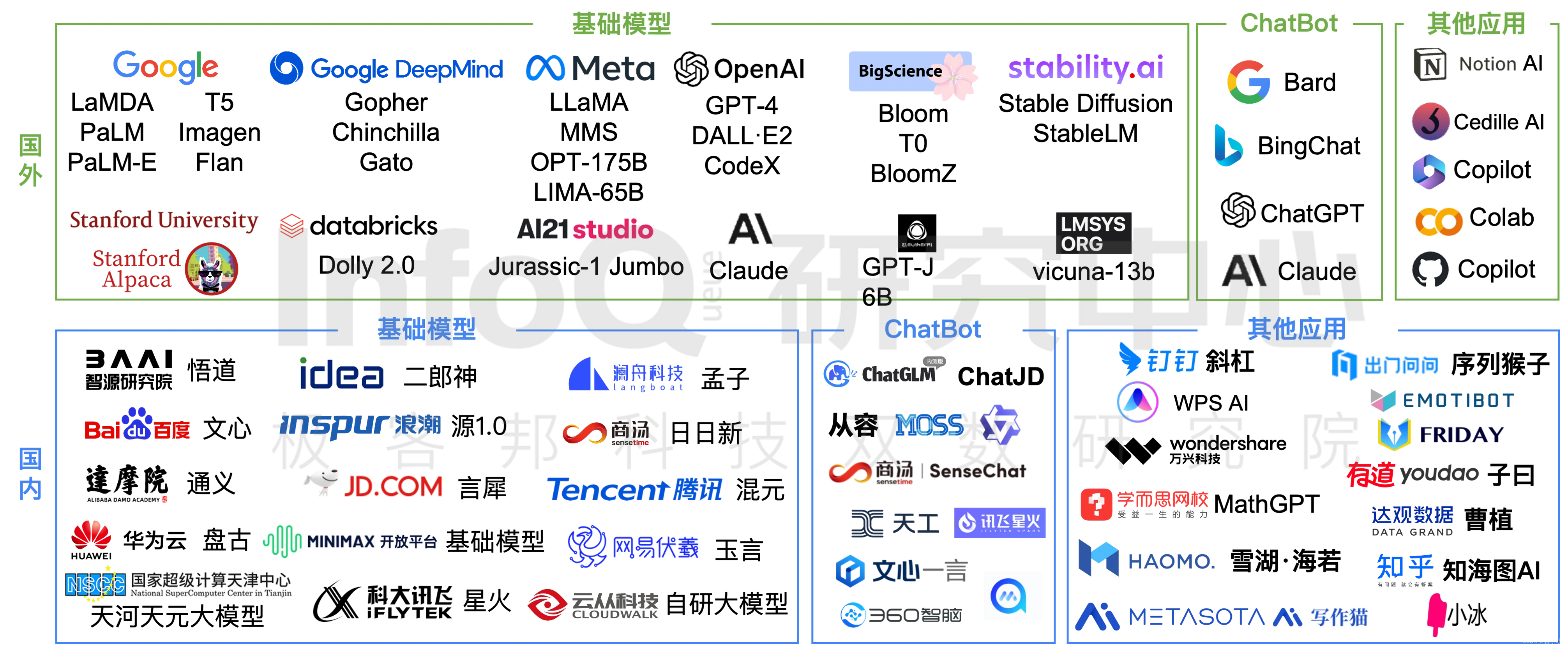

中文英文模型,GPT-4性能是当着无愧的王者,但无法使用。`中文评测平台`榜单比较混乱,看个人使用习惯。

使用命令行前,请确保已经通过pip install modelscope 安装ModelScope。

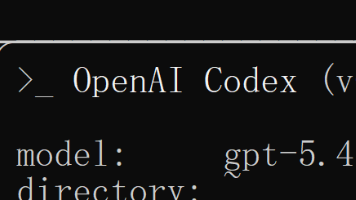

CC-Switch是一款管理AI编程工具(Claude/Codex/Gemini等)的桌面应用,提供可视化界面统一管理配置、供应商切换和扩展功能。安装需下载MSI安装包,配置Node.js环境并安装对应CLI工具(npm全局安装)。使用时可选择供应商API密钥,通过命令行调用工具(如codex)进行AI编程交互,支持模型选择和文件生成操作。配套教程链接提供详细配置指南,适合开发者统一管理多AI工具

基于stable-diffusion-v1.4的vae对图像重构。

CC-Switch是一款管理AI编程工具(Claude/Codex/Gemini等)的桌面应用,提供可视化界面统一管理配置、供应商切换和扩展功能。安装需下载MSI安装包,配置Node.js环境并安装对应CLI工具(npm全局安装)。使用时可选择供应商API密钥,通过命令行调用工具(如codex)进行AI编程交互,支持模型选择和文件生成操作。配套教程链接提供详细配置指南,适合开发者统一管理多AI工具

23.06 LLaVA-Med 使用通用领域( general-domain)的 LLaVA 进行初始化.然后60W+6W的数据以课程学习方式(curriculum learning)持续训练(首先是**生物医学概念对齐**(biomedical concept alignment), 然后是全面的指令微调( instruction-tuning))。

NeRF的核心优化手段: 端到端可微渲染(紧致-高效的三维视觉信息表达)从更本质的角度建立了二维图像与三维世界的联系

LInux切换到`root用户`再进行conda安装,可能之前conda某些包使用在root 用户下进行安装