简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

小学1-6年级,春季班,暑假班,寒假班,速航班。听说初中就要分等级,A\B\C三级。吓得我赶紧把学而思找出来。每个等级不同的教学方案。考题和奥数一个路子。

该模型参数规模为1.3B和6.7B,采用了创新的联合视觉和语言预训练方法,旨在解决传统的单模态预训练方法的局限性。在数据准备方面,采用了策略性数据采样方法,平衡了多模态数据和纯文本数据的比例,避免影响语言模型原有的语言理解能力。在模型架构方面,引入了混合视觉编码器,能够高效处理1024x1024高分辨率图像,同时控制了计算量的增长。在模型架构设计上,体现了在多任务场景下保持推理一致性和语义完整性的

而Reka Edge和Flash这两个规模较小的模型,也在各自的算力范围内展现了出色的性能,达到了业界领先水平。这些模型不仅能处理和推理文本,还能够灵活应对图像、视频和音频等多种输入,在各项测试中表现出色,在某些指标上甚至超越了更大规模的知名模型。总的来说,Reka团队通过大量高质量数据、先进的算法设计以及优化的训练流程,成功打造了这一系列强大的多模态语言模型,在AI技术发展中树立了新的里程碑。他

随着技术的不断进步,我们期待BitNet b1.58能够在成本更低的硬件上运行,进一步推动LLM的普及和应用。BitNet b1.58的内存占用是LLAMA LLM的1/3.32(基于3B模型的数据),所以70B参数的BitNet b1.58的内存占用大约是80GB / 3.32 ≈ 24GB。随着技术的成熟,我们期待它在更多领域中的应用,为我们的生活带来更多便利。最近,微软研究院的研究人员提出了

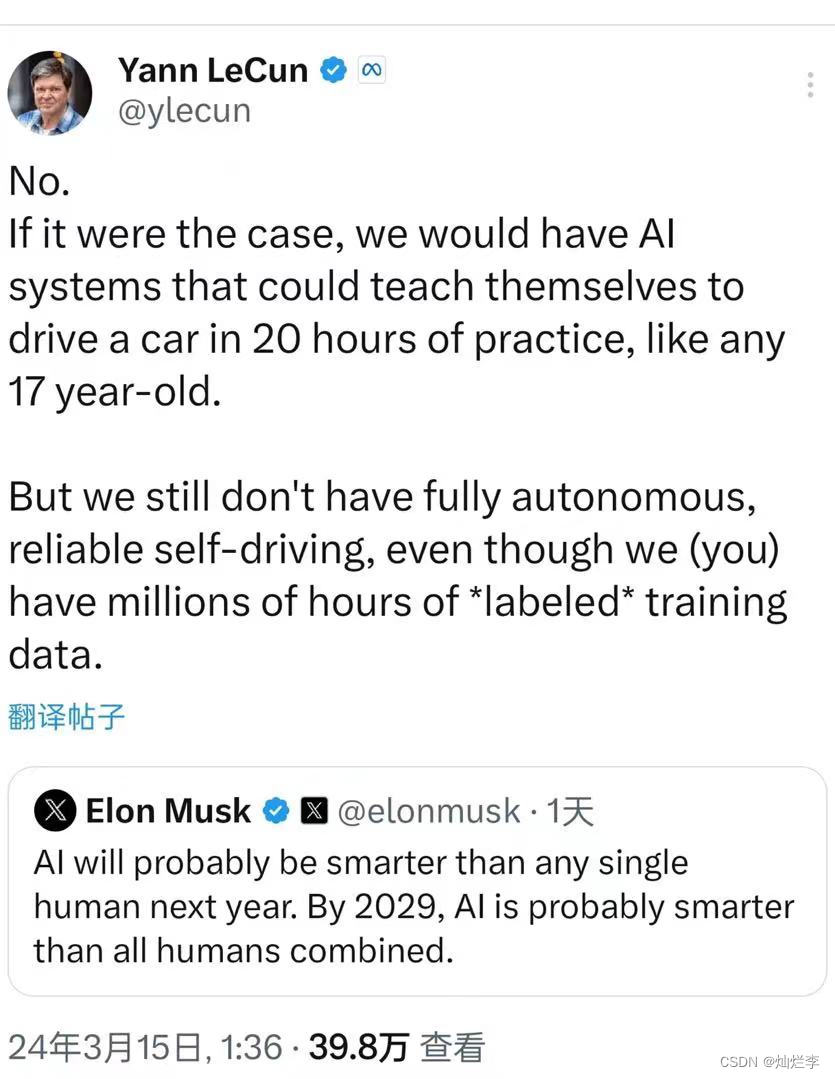

杨立坤:不,如果是这样的话,我们会有Alsystems,可以像任何17岁的孩子一样,在20个小时的练习中自学驾驶汽车。但我们仍然没有完全自主、可靠的自动驾驶,尽管我们(您)有数百万小时的“标记”培训数据。埃隆·马斯克:AI明年可能会比任何一个人都聪明。到2029年,Alis可能比所有人类加起来都聪明。

模型参数内存为14GB不变,但由于大幅降低了优化器状态和激活内存占用,最终总内存消耗仅为21.3GB,这意味着,我们现在可以在一张24GB显存的RTX 4090显卡上,轻松完成70亿参数模型的从头训练!这篇论文提出了一种名为GaLore的全新训练算法,让我们可以在单台24GB显存的消费级GPU上,高效训练70亿参数量级的大型语言模型。然而,训练这些大模型需要消耗大量的计算资源和内存,这对硬件提出了

然而,现有的多站融合案例大多局限于220千伏及以下的变电站,受限于站内可用空间,一般只能容纳几十面机柜,适合建设小型的边缘计算节点,难以支撑区域级、骨干级数据中心的建设需求。在"双碳"目标的背景下,如何在保障算力供给的同时,实现能源的高效利用和绿色发展,成为亟需破解的难题。能源和算力,一个是新经济的"血液",一个是新经济的"引擎"。电力行业要树立"算力即负荷"的新理念,加快电网基础设施与算力基础设

Lehigh大学的Lichao Sun教授作为共同通讯作者,对Mora项目的未来充满期待,他表示:“我们希望Mora能够指导视频生成技术的未来发展方向,通过协作AI智能体,推动视频内容创造和利用方式的重大进步。Mora采用多智能体协作的方式,通过分解视频生成过程为多个子任务,并由专门的智能体负责执行,从而实现了文本到视频、图像到视频、视频编辑和模拟数字世界等多种视频生成任务。随着技术的不断进步和开

随着技术的不断进步,我们期待BitNet b1.58能够在成本更低的硬件上运行,进一步推动LLM的普及和应用。BitNet b1.58的内存占用是LLAMA LLM的1/3.32(基于3B模型的数据),所以70B参数的BitNet b1.58的内存占用大约是80GB / 3.32 ≈ 24GB。随着技术的成熟,我们期待它在更多领域中的应用,为我们的生活带来更多便利。最近,微软研究院的研究人员提出了

模型参数内存为14GB不变,但由于大幅降低了优化器状态和激活内存占用,最终总内存消耗仅为21.3GB,这意味着,我们现在可以在一张24GB显存的RTX 4090显卡上,轻松完成70亿参数模型的从头训练!这篇论文提出了一种名为GaLore的全新训练算法,让我们可以在单台24GB显存的消费级GPU上,高效训练70亿参数量级的大型语言模型。然而,训练这些大模型需要消耗大量的计算资源和内存,这对硬件提出了