简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文分享了如何基于n8n构建自愈型质量管理系统。通过自动化采集缺陷、需求等数据并构建知识图谱,系统能智能分析、自动修复用例库。方案大幅降低了维护耗时与缺陷逃逸率,将测试团队从重复劳动中解放,转向质量策略设计,实现了质量数据的持续流动与优化。

本文分享了如何基于n8n构建自愈型质量管理系统。通过自动化采集缺陷、需求等数据并构建知识图谱,系统能智能分析、自动修复用例库。方案大幅降低了维护耗时与缺陷逃逸率,将测试团队从重复劳动中解放,转向质量策略设计,实现了质量数据的持续流动与优化。

本文详细介绍了如何利用n8n搭建基于GitHub事件驱动的智能测试流水线。通过配置Webhook触发器,实现代码推送后自动执行测试,并根据提交信息智能选择测试范围。工作流还集成了结果断言与多渠道通知,将测试环节无缝嵌入开发流程,有效提升了问题发现效率与交付质量。

本文介绍如何利用Coze AI Agent构建智能数据采集方案,实现从网站抓取到数据清洗、存储的全流程自动化。通过可视化工作流设计,该方案可将人工日均处理量从不足百条提升至无限制自动采集,大幅提升数据工作效率。

大模型正从对话迈向行动,核心是工具调用(Function Calling)。开发者向模型注册工具函数后,模型能根据问题智能选择并调用,附上正确参数,并将执行结果转化为最终答案。相比ReAct提示工程,工具调用更聚焦于明确的函数接口,适合API调用等场景,开发相对简便。它标志着大模型从“认知”走向“行动”,成为解决实际问题的关键。

在AI时代,有效提问是测试工程师的核心能力。直接输入模糊指令只会得到泛泛而谈的结果,而通过为AI设定明确身份、分步骤拆解任务、规定输出格式以及提供“种子”范例,测试人员可以引导AI生成深度覆盖业务场景、异常情况及安全风险的精准测试方案。掌握这些提示词技巧,能将AI从“工具”转变为高效产出高质量测试资产的协作伙伴。

谷歌Gemini Agents正重塑测试工作流,它能从需求文档自动生成用例与脚本,精准解决时间紧迫、路径复杂、回归耗资源三大痛点。文章建议测试工程师从小场景切入,掌握“测试语言”与AI对话,并将AI输出转化为团队资产。面对幻觉与安全等挑战,需建立验证机制。AI不会取代测试工程师,但能放大其业务理解与风险直觉等核心价值,助其聚焦更高维的质量体系建设。

AI大模型应用的测试与传统软件测试逻辑迥异,核心在于评估输出的准确性、鲁棒性与安全性。本文通过“打卡引导”功能案例,提出五维测试框架:需验证变量理解、意图匹配、抗Prompt注入攻击、内容安全过滤及高并发下的性能与多样性。测试工程师需从流程检验转向质量探针角色,系统评估AI输出,确保智能体被安全、负责任地交付。

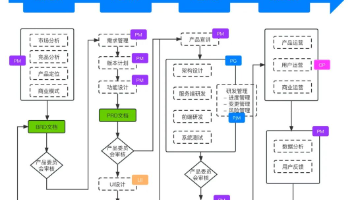

本文探讨了如何通过AI在需求与系统设计阶段提前介入,以减少返工与沟通成本。方案基于多智能体协作的流水线,将模糊的业务诉求转化为结构化的工程输入,涵盖从MRD到PRD的智能生成,再到系统分析与代码骨架准备。通过RAG技术增强业务语境理解,旨在将个人经验转化为团队可复用的工程能力,从而提升整体研发效率与确定性。

AI编程正从代码补全演进为Agent驱动,其核心挑战从效率转为系统化约束。Agent需在明确Spec限定下执行任务,Spec的作用是缩小决策空间,防止方向性错误。同时,需通过工程化管理上下文来控制成本,并将复用路径设计为低风险选项。真正的工程优势在于将隐性经验转化为可执行的系统规则,确保AI的决策与输出可控、可验证。