简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Latte(Latent Diffusion Transformer)是一种用于视频生成的创新模型。它首先通过预训练的变分自编码器(VAE)将输入视频编码为潜在空间中的特征,并从中提取出时空令牌(Token)。然后应用一系列 Transformer 块对这些令牌进行建模,以捕捉视频数据分布。

阿里巴巴最近开源了一个320亿参数的大语言模型Qwen1.5-32B,网上都说很强很强,那么它到底强在哪里呢?

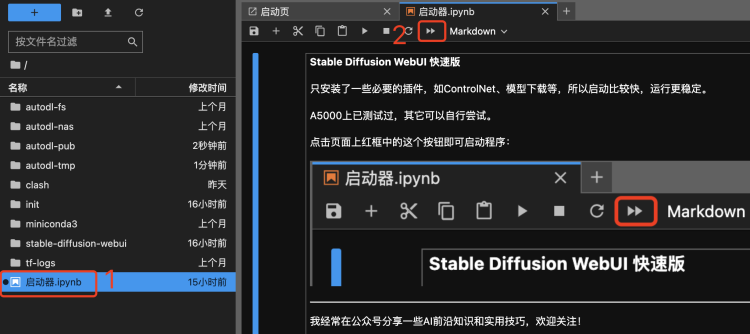

这里默认大家都安装好Stable Diffusion WebUI了,如果还没安装过的朋友,建议去AutoDL上租一个服务器体验下,方便不贵,选择A5000规格的就差不多了,安装教程网上应该挺多的,这里就不啰嗦了,还不会的可以联系我。以上就是本文的主要内容了,使用这种方法就可以无限制作自己的AI专属数字人,想要什么样的风格都可以,想做多少个都可以,有兴趣的快去试试吧。当然要遵纪守法,不要搞出事情来。

背景某个项目需要实现基础软件全部国产化,其中操作系统指定银河麒麟,数据库使用DM8。虽然在之前的文章中已经成功模拟国产飞腾处理器,但是运行效率不高,所以这里的银河麒麟操作系统还是运行在x64平台上。x64平台的DM8并没有提供银河麒麟版本,因为银河麒麟是基于Ubuntu的,Ubuntu又是基于Debian的,所以这里下载的是Debian版本的。为了方便安装达梦数据库,这里使用了带UI界面的银河麒麟

阿里巴巴最近开源了一个320亿参数的大语言模型Qwen1.5-32B,网上都说很强很强,那么它到底强在哪里呢?

阿里巴巴最近开源了一个320亿参数的大语言模型Qwen1.5-32B,网上都说很强很强,那么它到底强在哪里呢?

阿里巴巴最近开源了一个320亿参数的大语言模型Qwen1.5-32B,网上都说很强很强,那么它到底强在哪里呢?

Llama3是一个大型语言模型系列,它们是一组预先训练好的、专为对话场景优化的文本生成模型,目前包含80亿参数和700亿参数两种规格,两个规格均有预训练版和经过指令调优的版本可供选择。Llama3模型仅接收文本输入,模型仅生成文本和代码。Llama3经过指令调优的模型在常见行业基准测试中,性能超越了许多现有的开源聊天模型。8B参数的性能甚至大幅超越了之前的Llama2-70B的性能,革了自己的命。

随着互联网技术的发展,我们的生活变得越来越数字化,网上购物、社交、阅读新闻成为日常。而在这个数字化的世界中,Cookie扮演了一个不可或缺的角色。Cookie是一种由浏览器保存在用户电脑上的小块数据,用来帮助网站记住用户的信息和设置。网站可以在前端直接操作Cookie,也可以根据服务器返回的指令设置Cookie,当浏览器请求同一服务器时相应的Cookie会被回传。Cookie让网站能够记住用户的登

今天分享一个云服务器炼丹的方法,方便大家快速入门上手,这个云服务不需要特殊网络设置,能连接公网网盘,随开随用,有3090显卡,也有4090显卡,不过我经常使用的是A5000显卡。