简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

该方式前提是本地项目已关联远程仓库,由于业务变更git地址改变。

今天早些时候我在一个在线论坛上看到有用户在找如何恢复被删除的Performance Schema 数据库的方法。老实说,恢复删掉的performance schema数据库非常容易,下面就是操作命令:一旦你的操作成功了,就需要重启MySQL 服务。重启完成,你就有新的Performance Schema 数据库了。不用担心,你的数据是不会存在这个新的数据库的(译者注:这里指Performance

Server和ServerActive必须是zabbix-server的ip,hostname必须是agent本机的hostname。如果zabbix-agent报以下错误需要检查agent和server的版本是否匹配。安装3.0版本zabbix(其他版本自行改URL)

转至:http://www.itpub.net/thread-1922287-1-1.html。原来的格式是fileformat=dos,修改为fileformat=unix,就正常了。:set ff 可以看当前格式,显示dos的大部分原因是win平台生成的文件复制到。为什么会出现这样的错误?明明TNSNAME不长?有可能是tnsnames.ora文件格式的问题。:set ff=unix 设置成。

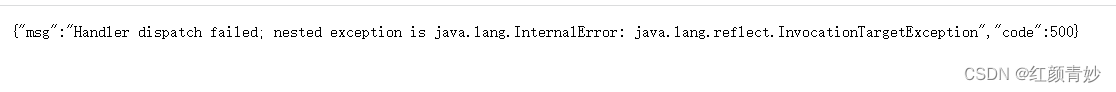

部署ruoyi-vue的jar。访问验证码接口时,出现异常。本地测试没有问题,起初使用的jdk8,怀疑jdk版本问题,但是本地使用11.0.15版本也没问题,后面也就没管,初步排除jdk版本的问题。之前项目也没问题,不知道怎么回事 = =!转至:https://blog.csdn.net/qq_38801506/article/details/126544485。安装完成后cd /usr/shar

转至:https://blog.csdn.net/u014454538/article/details/130735582。

今天早些时候我在一个在线论坛上看到有用户在找如何恢复被删除的Performance Schema 数据库的方法。老实说,恢复删掉的performance schema数据库非常容易,下面就是操作命令:一旦你的操作成功了,就需要重启MySQL 服务。重启完成,你就有新的Performance Schema 数据库了。不用担心,你的数据是不会存在这个新的数据库的(译者注:这里指Performance

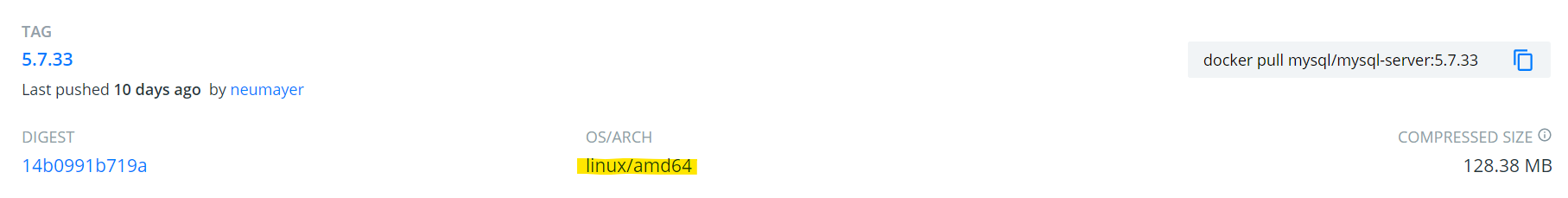

1.我们需要找一个适用于arm64架构的MySQL镜像,先看看官方有没有,社区里也有人做这些镜像,可以在Docker Hub上找找。2.docker官方提供的MySQL没有arm64架构的,但MySQL官方提供的mysql/mysql-server有,所以你可以选择执行。M1芯片是arm64架构,也称作aarch64架构,只能运行arm64/aarch64架构的程序。amd64的架构,也就是Int