简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文通过实证分析展示了实际LLM模型的FLOPS分配情况,并与理论分析进行对比。通过理论和实证相结合的方式,本文为理解和优化语言大模型的性能提供了有益见解。作者Finbarr Timbers是一名机器学习研究员,曾就职于DeepMind。(以下内容由OneFlow编译发布,转载请联系授权。原文:https://www.artfintel.com/p/where-do-llms-spend-thei

机器学习模型具有概率性。对于同一个问题,机器可能会给出不同回答,以“世界上最棒的美食是什么?”这一问题为例。假如我们间隔一分钟,对同一个人提问,这个人两次给出的回答应该是相同的;但如果我们分两次问模型同样的问题,它给出的答案可能会发生变化。如果模型认为越南菜最好吃的概率为70%,意大利菜最好吃的概率为30%,那么相应的,模型会有70...

本文将介绍Transformer架构和GPT-4、LLaMA等语言大模型中使用的自注意力机制。自注意力和相关机制是LLM的核心组件,使用LLM时,了解这些机制十分有必要。本文还提供了使用Python和PyTorch从零开始编码自注意力机制的详细指南,并演示其工作方式,帮助初学者和经验丰富的从业者深入理解它在LLM中的作用。本文作者是机器学习和人工智能研究员Sebastian Raschka,目前担

本文深入探讨了批处理在现代GPU上的工作原理,以及它是如何影响深度学习模型的推理速度,基于此,作者为模型优化提供了实用指导。通过优化批处理策略,研究人员和工程师可以更有效地利用计算资源,提高模型的推理效率。(本文作者为机器学习研究员Finbarr Timbers,他曾是DeepMind的工程师。本文由OneFlow编译发布,转载请联系授权。原文:https://www.artfintel.com/

矩阵乘法(MatMul)是深度学习中的主要计算瓶颈,尤其在ChatGPT等Transformer模型中,矩阵乘法的运行时长约占其总运行时长的45-60%,解决这一挑战对发展更经济的大模型具有重要意义。为此,加州大学的研究人员在论文《Scalable MatMul-free Language Modeling(可扩展的无矩阵乘法语言模型构建)》 中试图通过消除矩阵乘法来构建更便宜、耗能更少的语言模型

四年前,我对开源机器学习生态系统进行了分析。自那时起,情况就发生了变化,所以这次我打算重新讨论这个话题,本次主要关注的是基础模型的技术栈。我把完整的开源AI代码库列表放在了“llama-police”(https://huyenchip.com/llama-police,该列表每6小时更新一次。其余大部分也放在了我的GitHub“c...

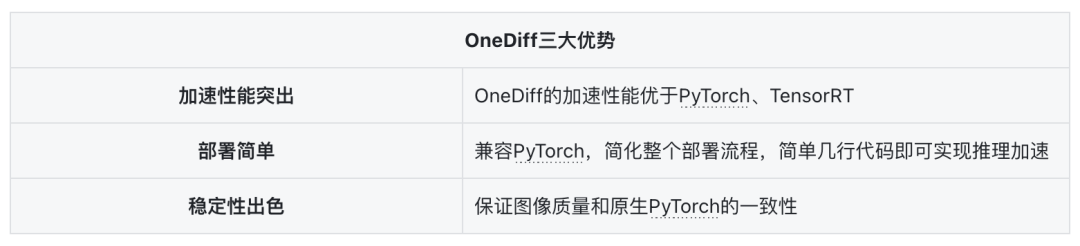

2024年,电商领域正目睹生成式AI软件工具的飞速发展,AI Generated Content (AIGC) 技术在电商应用中的普及率正在显著提升,这类技术能够显著提高商业运营的效率,并促进业绩的稳步增长。硅基流动研发的图片/视频生成推理引擎OneDiff能够以高性能和低成本的优势为AIGC应用程序提供支持。因其加速性能突出、部署简单、稳定性高的特点,南京一言万相网络科技有限公司的图生生团队在实

2019年,强化学习之父、阿尔伯塔大学教授Richard Sutton发表了后来被AI领域奉为经典的The Bitter lesson,这也是OpenAI研究员的必读文章。在这篇文章中,Richard指出,过去 70 年来,AI 研究的一大教训是过于重视人类既有经验和知识,而他认为最大的解决之道是摒弃人类在特定领域的知识,利用大规模算力才是王道。这一思想很快得到了OpenAI首席科学家Ilya S

欢迎Star、试用One-YOLOv5:https://github.com/Oneflow-Inc/one-yolov51结构项目预览2安装gitclonehttps://github.com/Oneflow-Inc/one-yolov5#clonecdone-yolov5pipinstall-rrequirements.txt#in...

算子即Operator,这里简称op。op是深度学习的基础操作,任意深度学习框架中都包含了数百个op,这些op用于各种类型的数值、tensor运算。在深度学习中,通过nn.Module这样搭积木的方式搭建网络,而op就是更基础的,用于制作积木的配方和原材料。...