简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

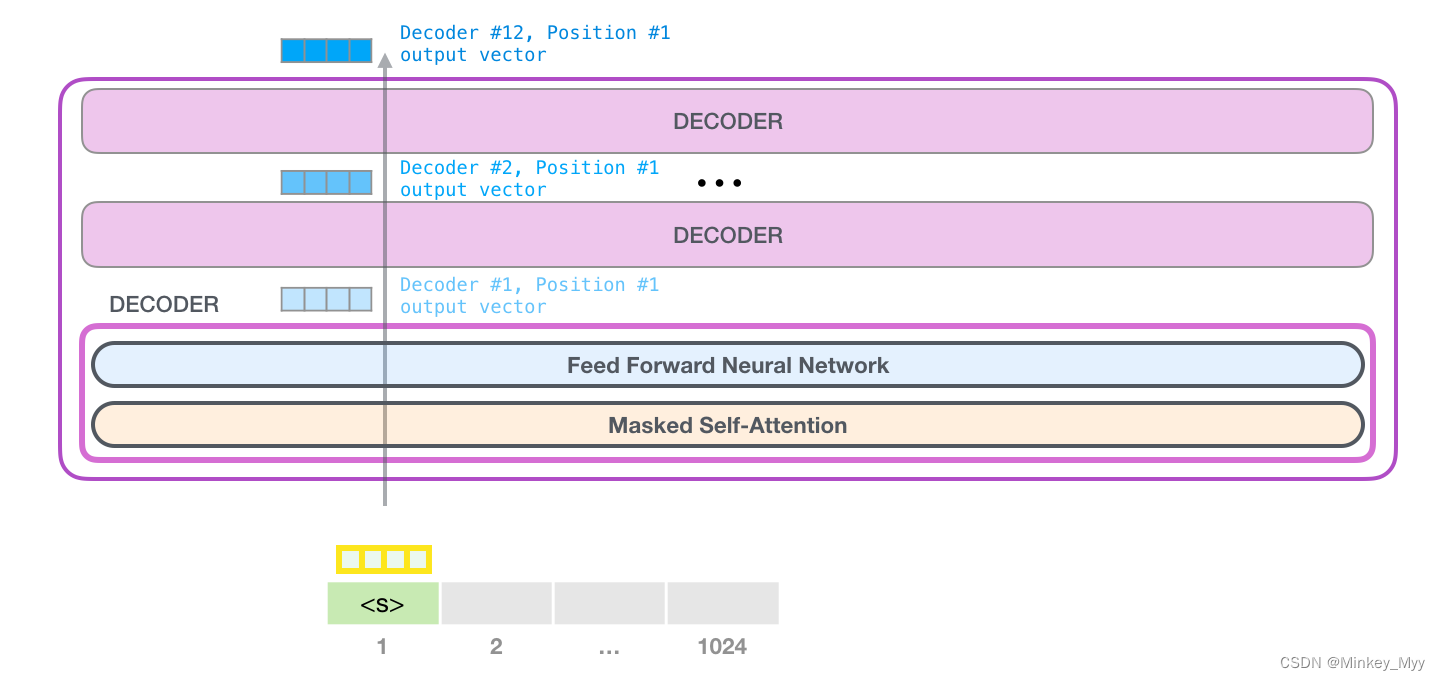

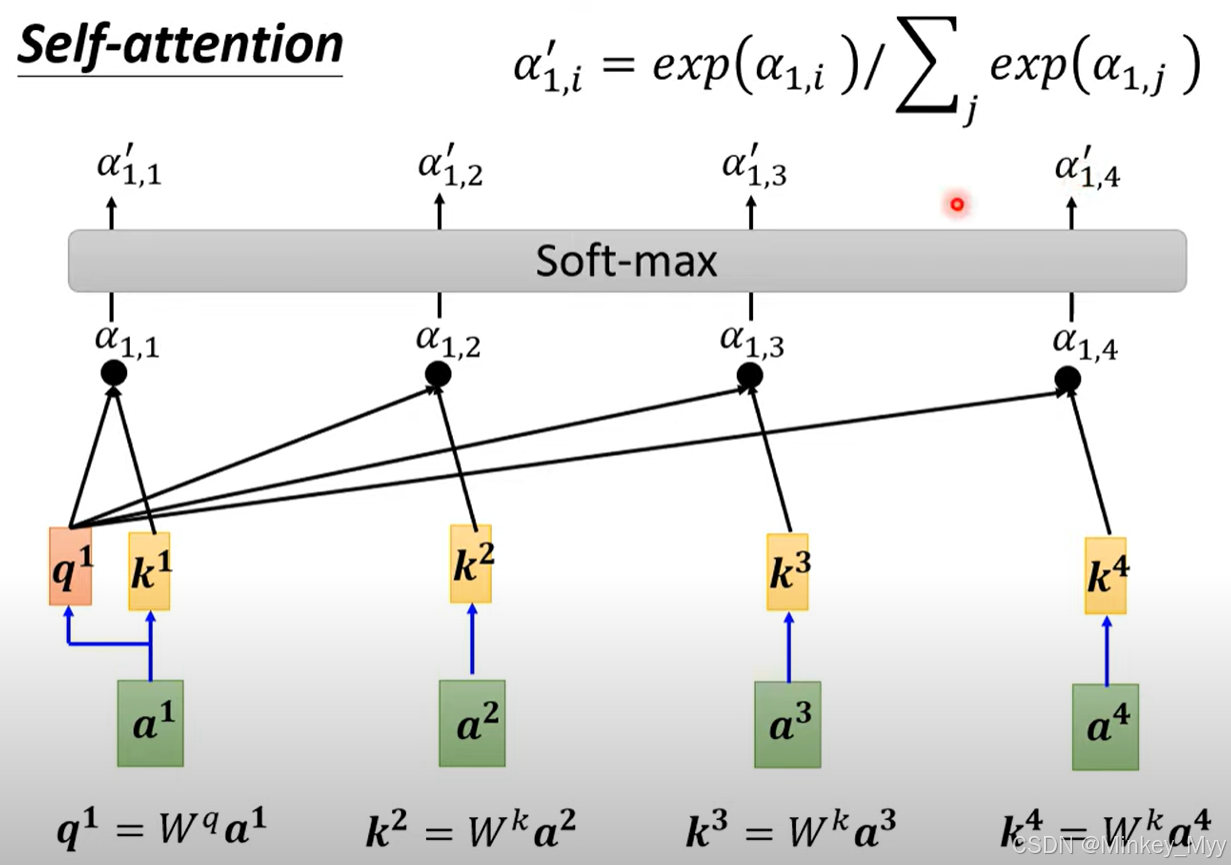

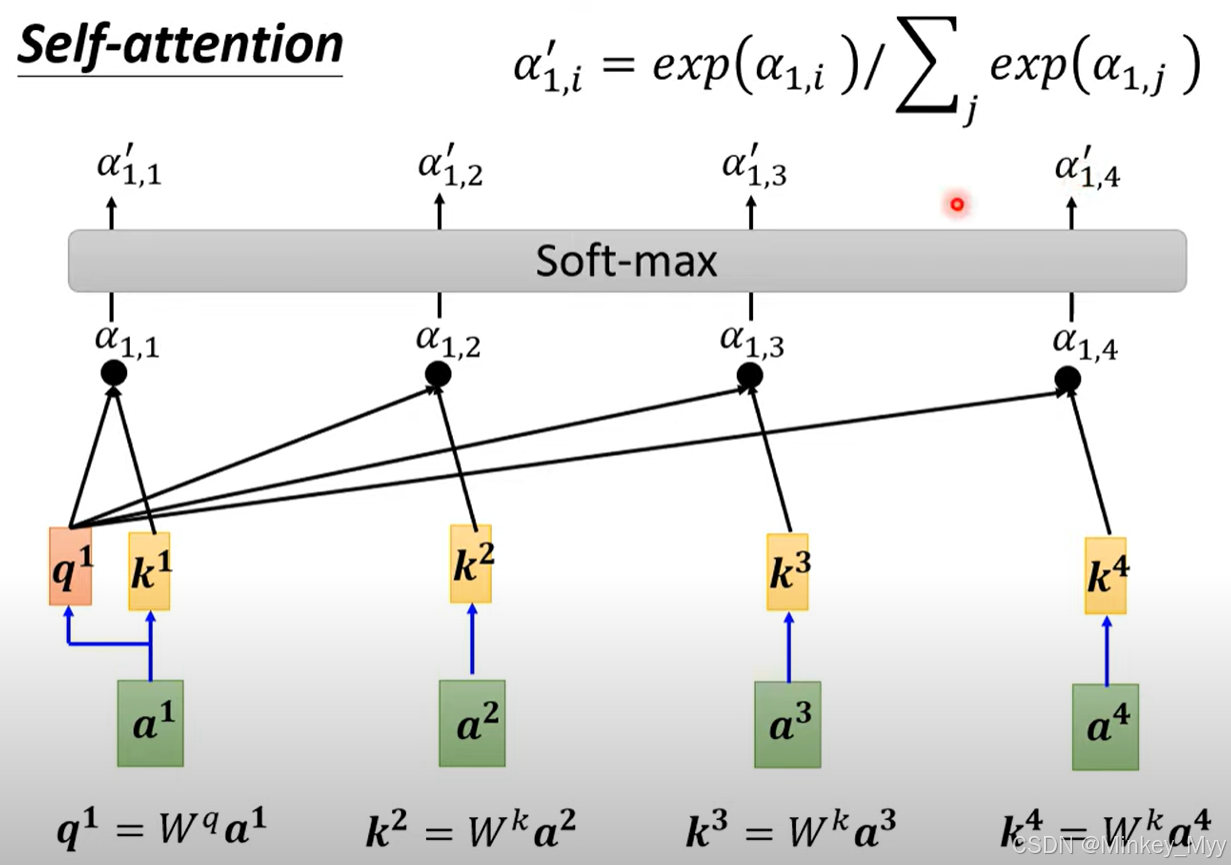

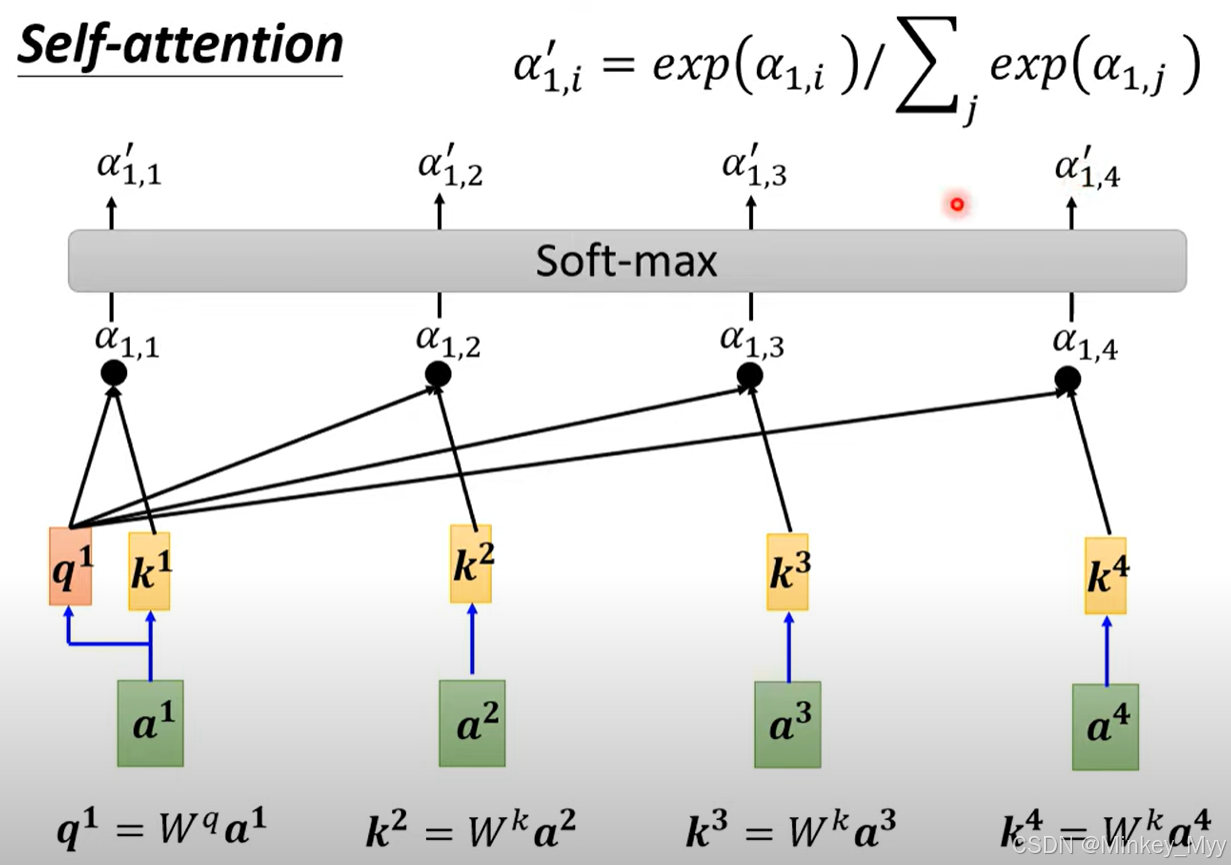

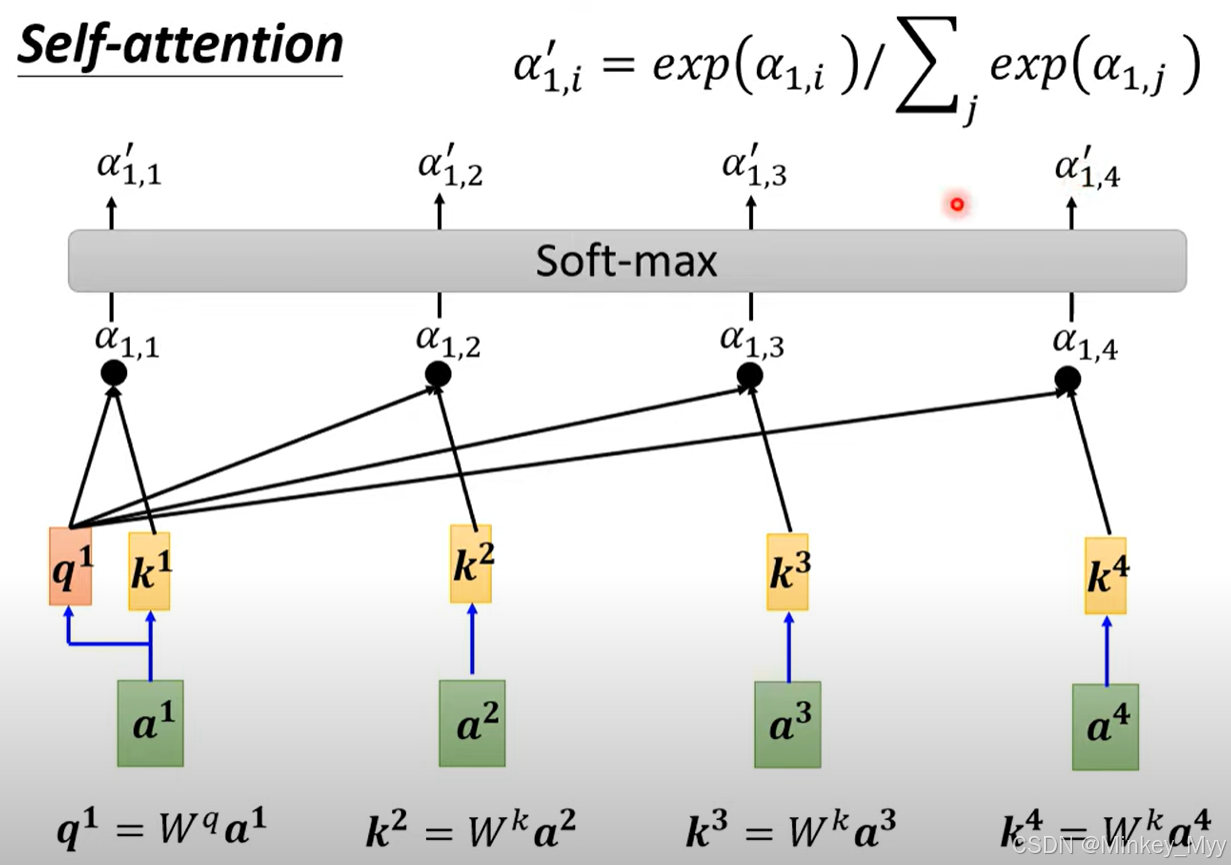

但由于Transformer不包含任何循环结构,Transformer模型对输入序列中的每个元素进行处理时是并行的,各个单词在Transformer中都同时经过Decoder-Encoder的变换,这就导致了Transformer无法捕获单词的位置信息。在编码器-解码器注意力中,查询来自前一个解码器层的输出,而键和值来自整个编码器的输出。有些区域很敏感,有些则不敏感。推荐时,会有一个助词词汇,剔除

但由于Transformer不包含任何循环结构,Transformer模型对输入序列中的每个元素进行处理时是并行的,各个单词在Transformer中都同时经过Decoder-Encoder的变换,这就导致了Transformer无法捕获单词的位置信息。在编码器-解码器注意力中,查询来自前一个解码器层的输出,而键和值来自整个编码器的输出。有些区域很敏感,有些则不敏感。推荐时,会有一个助词词汇,剔除

而 LangChain 则是提供一种通用的框架通过大语言模型的指令来轻松地实现这些工具的调用。我们都知道在执行一个复杂的任务时,我们需要考虑多方面的影响因素,将复杂任务拆分为细小的子任务去执行。AI Agent 的诞生就是为了处理各种复杂任务的,就复杂任务的处理流程而言 AI Agent 主要分为两大类:行动类、规划执行类。总而言之,AI Agent 就是结合大模型能去自动思考、规划、效验和执行的

但由于Transformer不包含任何循环结构,Transformer模型对输入序列中的每个元素进行处理时是并行的,各个单词在Transformer中都同时经过Decoder-Encoder的变换,这就导致了Transformer无法捕获单词的位置信息。在编码器-解码器注意力中,查询来自前一个解码器层的输出,而键和值来自整个编码器的输出。有些区域很敏感,有些则不敏感。推荐时,会有一个助词词汇,剔除

但由于Transformer不包含任何循环结构,Transformer模型对输入序列中的每个元素进行处理时是并行的,各个单词在Transformer中都同时经过Decoder-Encoder的变换,这就导致了Transformer无法捕获单词的位置信息。在编码器-解码器注意力中,查询来自前一个解码器层的输出,而键和值来自整个编码器的输出。有些区域很敏感,有些则不敏感。推荐时,会有一个助词词汇,剔除

参考重复这两个步骤直到生成 EOS token 或达到用户设定的停止条件(stop token 或最大 token 数)。让我们以 Llama2-7B(4096 序列长度,float16精度)为例,计算一下 batch_size = 1的理想推理速度。