简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

由于目前的工作,有一部分是为运营提供一些流量分析的支持,所以一些相应的基础知识就不得不学起来了。目前其中一种需求,就是统计广告的投放效果,常规做法就是添加追踪,在追踪链中添加utm参数,这样对于数据平台的聚合统计就比较方便了UTM :“Urchin Tracking Module”的简写,中文的大概意思就是跟踪模块功能:追踪渠道来源,便于根据不同渠道、内容等细分数据,目的:精细化运营分析...

大语言模型的训练主要包括哪几个阶段?每个阶段需要的数据、算力、训练方式、产出模型分别是什么? 每个阶段的训练难点分别是什么?哪个阶段是必须的,哪个阶段是可选的? 每个阶段模型的训练难点分别是什么?

算力是AI发展的驱动力,大模型时代更要格外关注算力。目前的大模型是个重资产行业,底层竞争在于半导体产业,AI的发展离不开芯片,甚至可以说,整个信息时代的发展都离不开芯片。

努力用这一万字,把Transformer相关知识讲明白......

努力用这一万字,把Transformer相关知识讲明白......

算力是AI发展的驱动力,大模型时代更要格外关注算力。目前的大模型是个重资产行业,底层竞争在于半导体产业,AI的发展离不开芯片,甚至可以说,整个信息时代的发展都离不开芯片。

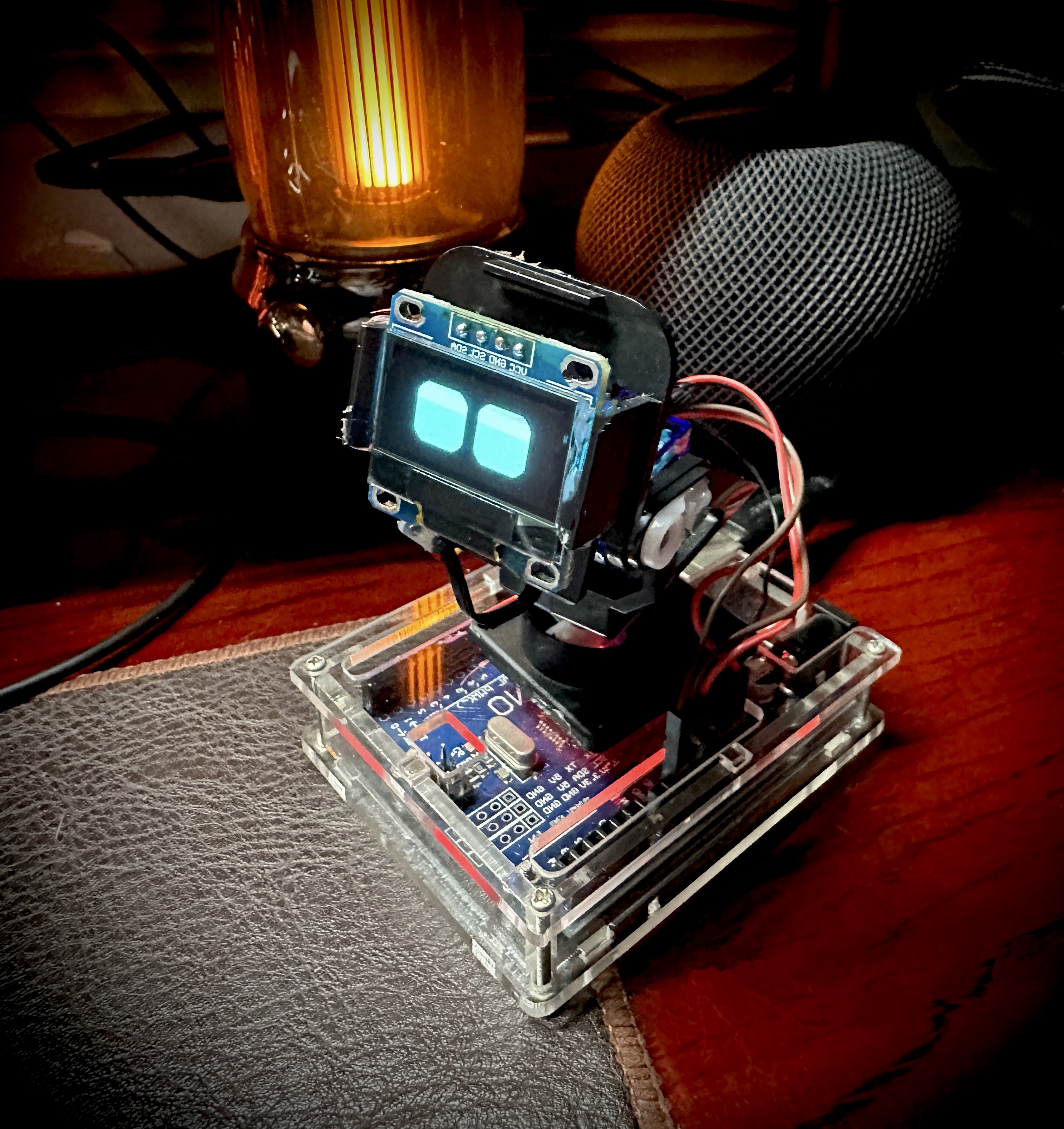

这是一篇给新手的「从0手搓AI机器人」教程

算力是AI发展的驱动力,大模型时代更要格外关注算力。目前的大模型是个重资产行业,底层竞争在于半导体产业,AI的发展离不开芯片,甚至可以说,整个信息时代的发展都离不开芯片。

努力用这一万字,把Transformer相关知识讲明白......

这里是陌小北,每周日解读每周AI大事件。本周事件:谷歌推出开源大模型Gemma | Groq自研AI芯片 | 英伟达成立GEAR研究具身智能体