简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

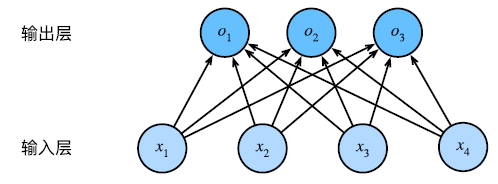

这里我们选择 ReLU,用于处理隐层的输出,再出入输出层。def relu(X): # 激活函数有了激活函数后,模型的定义可直接使用矩阵乘法实现。def net(X): # 模型X = X.reshape((-1, num_inputs)) # 展平H = relu(X@W1 + b1) # 这里“@”代表矩阵乘法这里我们通用采用交叉熵损失。值得一提的是,直接调用的 nn 模块里的交叉熵损失函数,

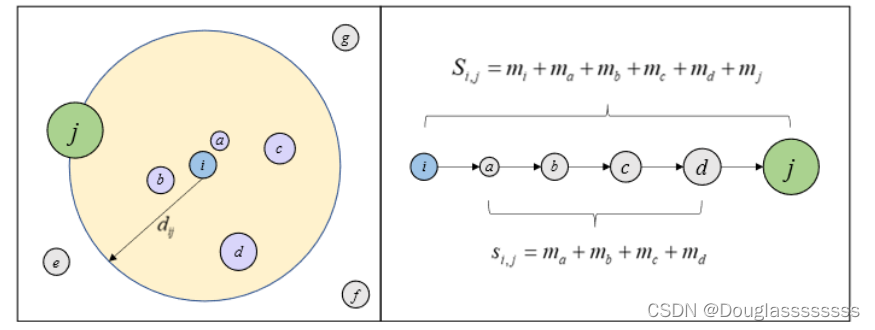

介绍了有关工作时间的确定方法以及事项的时间参数。

介绍了考研数学中重要定理及结论的证明过程

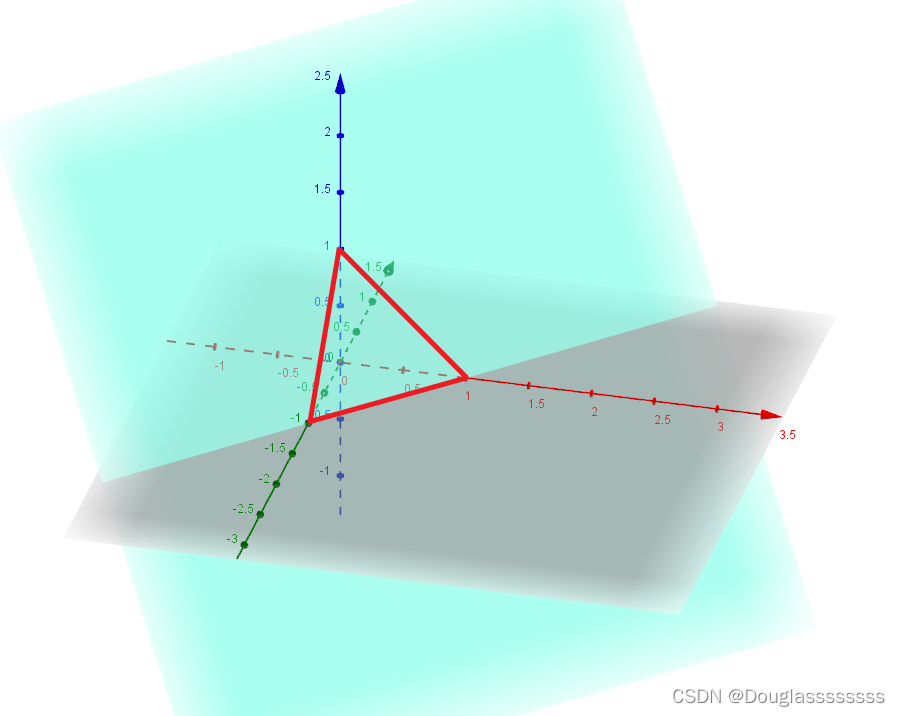

介绍了对坐标的曲面积分(第二类曲面积分)的相关内容,包括定义、性质、计算法以及与第一类曲面积分的关系,还介绍了场论的初步内容,包括梯度、旋度、散度、通量以及环流量的内容。

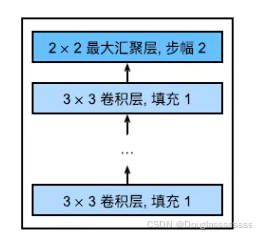

虽然 AlexNet 证明深层神经网络卓有成效,但它没有提供一个通用的模板来指导后续的研究人员设计新的网络。也就是说尽管我知道了更深更大的网络更有效,但是不清楚怎么让它更深更大,从而起到一个更好的效果。于是,研究人员开始从单个神经元的角度思考问题,发展到整个层,现在又转向块,重复层的模式。使用块的想法首先出现在牛津大学的视觉几何组的 VGG 网络中,通过使用循环和子程序,可以很容易地在任何现代深度

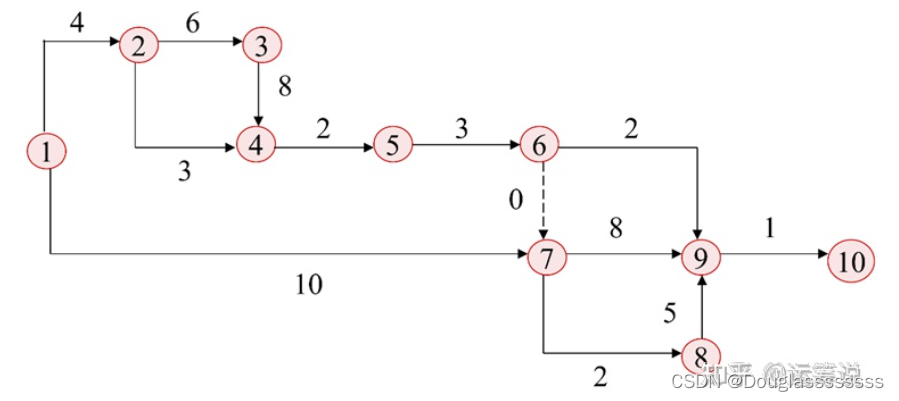

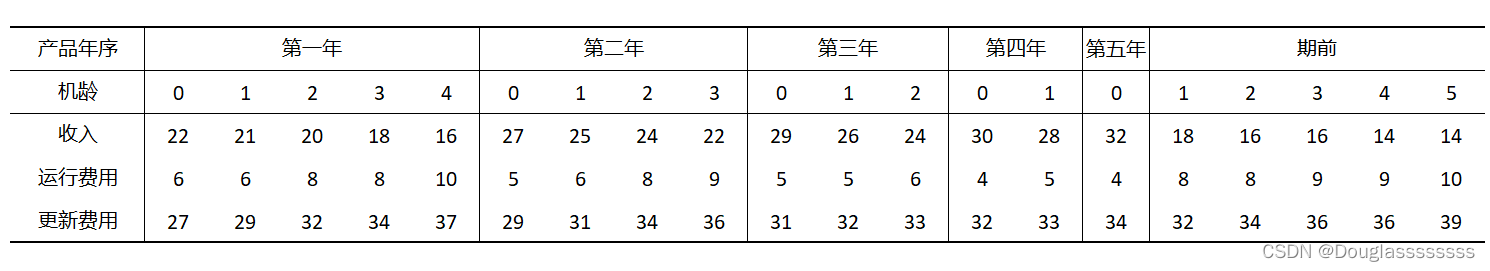

介绍了利用动态规划方法,求解设备更新问题的思路,以及一个详细的算例。

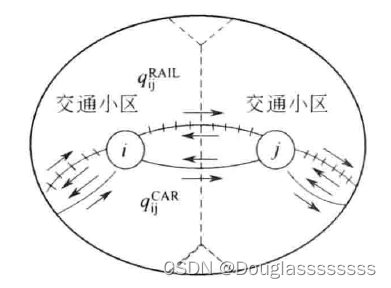

对交通方式选择的影响因素、方式划分的模型进行了介绍。

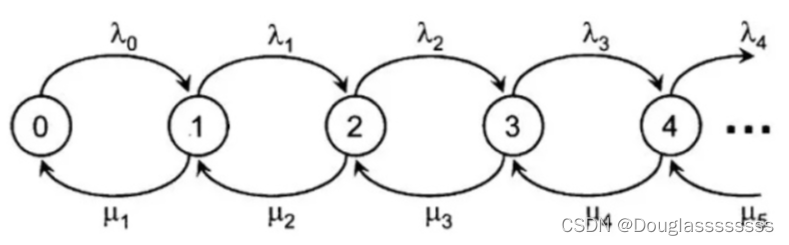

对标准的 M/M/1 排队系统进行了介绍,包括模型特征及分析以及各指标的计算公式。

对生产计划问题和不确定性的采购问题进行了动态规划建模和求解。

对交通分布的一些模型进行了介绍,包括增长系数法、重力模型法、介入机会模型和最大熵法。