简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

复旦大学与AGI-Eval社区联合发布《AgentEscapeBench》论文,通过270个密室逃脱游戏测试16个主流AI模型的长程推理能力。研究发现:1)Claude-Opus表现最稳健,25级难度仍保持60%成功率;2)GPT-5.4思路广但效率低,工具调用次数是Claude的2倍;3)模型性能随难度增加呈系统性衰退,工作记忆和逻辑一致性是主要瓶颈。该研究揭示了AI在陌生环境中的真实能力边界,

最近进入科技社区,大概率会被问到一句话:“你了吗?别误会,这可不是真去搞水产养殖,而是指给AI大模型装上“手脚”——这类智能体框架。它能让 AI 从只会“动嘴”出主意,变成能“动手”操作电脑、写周报、改bug的得力助手,。春节后热度不减,国内大厂和创业公司也纷纷入局,Kimi、腾讯、阿里、字节等都推出了自家的“Claw”产品。今天我们就来盘点一下市面上的“龙虾”到底有啥区别,看看哪只最适合你。

看似是大模型比拼《杀戮尖塔2》游戏能力,实则能直观暴露大模型的真实上限与短板。静态问答中,模型依靠知识与表达就能得分,但爬塔需要局势判断、资源管理、长线规划与试错复盘。这也拉开了模型差距:有的空谈逻辑却难以落地,有的稳步迭代、执行力与纪律性更强。现实里的编程、统筹、长期规划等复杂问题,更像持续闯关的爬塔,而非标准答案式问答。

看似是大模型比拼《杀戮尖塔2》游戏能力,实则能直观暴露大模型的真实上限与短板。静态问答中,模型依靠知识与表达就能得分,但爬塔需要局势判断、资源管理、长线规划与试错复盘。这也拉开了模型差距:有的空谈逻辑却难以落地,有的稳步迭代、执行力与纪律性更强。现实里的编程、统筹、长期规划等复杂问题,更像持续闯关的爬塔,而非标准答案式问答。

看似是大模型比拼《杀戮尖塔2》游戏能力,实则能直观暴露大模型的真实上限与短板。静态问答中,模型依靠知识与表达就能得分,但爬塔需要局势判断、资源管理、长线规划与试错复盘。这也拉开了模型差距:有的空谈逻辑却难以落地,有的稳步迭代、执行力与纪律性更强。现实里的编程、统筹、长期规划等复杂问题,更像持续闯关的爬塔,而非标准答案式问答。

本研究深入分析了当前大语言模型智能体评估中存在的困境,并提出了首个面向深度研究场景的综合评估基准——。通过基于真实用户需求构建的 100 项高质量任务,以及创新的RACE和FACT评估框架,研究人员系统性地揭示了当前顶尖智能体的能力图谱。评测结果表明,不同智能体在能力上存在显著的权衡,例如,Gemini在报告的信息丰富度上领先,而Perplexity和OpenAI的智能体则在引用精确度上更具优势,

Minimax(深度)擅长信息检索、软件开发、文件和数据处理类任务,在信息检索场景中,Minimax(深度)会主动增加信息来源链接,增强检索召回的置信度,在交付网页等Coding场景中,Minimax(深度)的网站架构更成熟,主动增加搜索、筛选等功能,并通过多次的有效测试和Debug来提高网站的可用性;Minimax(深度)在多模态展示测评中获 3 分评级,运用动态渲染与语义聚合技术,完成展品名称

评测的核心逻辑如图2所示:输入一段视频或图像序列,通过待测的隐式动作模型(Latent Action Model, LAM)提取出动作表征 z ,随后通过浅层探测头(probing)来验证 z 的质量。△图2:LARYBench整体流程动作的定义由细到粗分为三个层级:本体动作:机器人操作的控制信号,主流使用末端位姿,包括腕部3D坐标、3D旋转角及夹爪开闭等。原子语义动作:本体动作聚合为可用自然语言

为了帮助大家更顺畅地使用各类 Claw 工具,我们建立了 养虾交流群,群内会免费分享各款 Claw 工具的详细安装教程、实操技巧与最新资源。欢迎扫描下方二维码进群,和志同道合的伙伴一起交流学习,解锁 AI 高效办公新玩法!

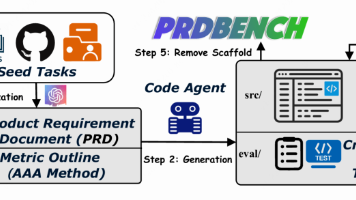

我们在数据集上评测了当前主流代码智能体,包括商业版(Claude Code、Gemini CLI、CodeX、Qwen Code)和基于 ADK 的最小化智能体(使用 Claude-4.5-Sonnet、Gemini-3-Pro、GPT-5.2、Qwen3-Coder 等作为骨干模型)。代码修改量方面,GPT-5.2 和 Gemini-3-Pro 改动较大(约 1500 行),而 Claude C