简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

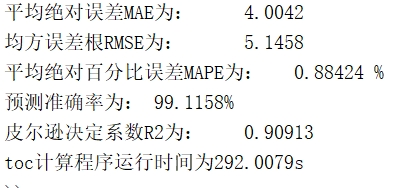

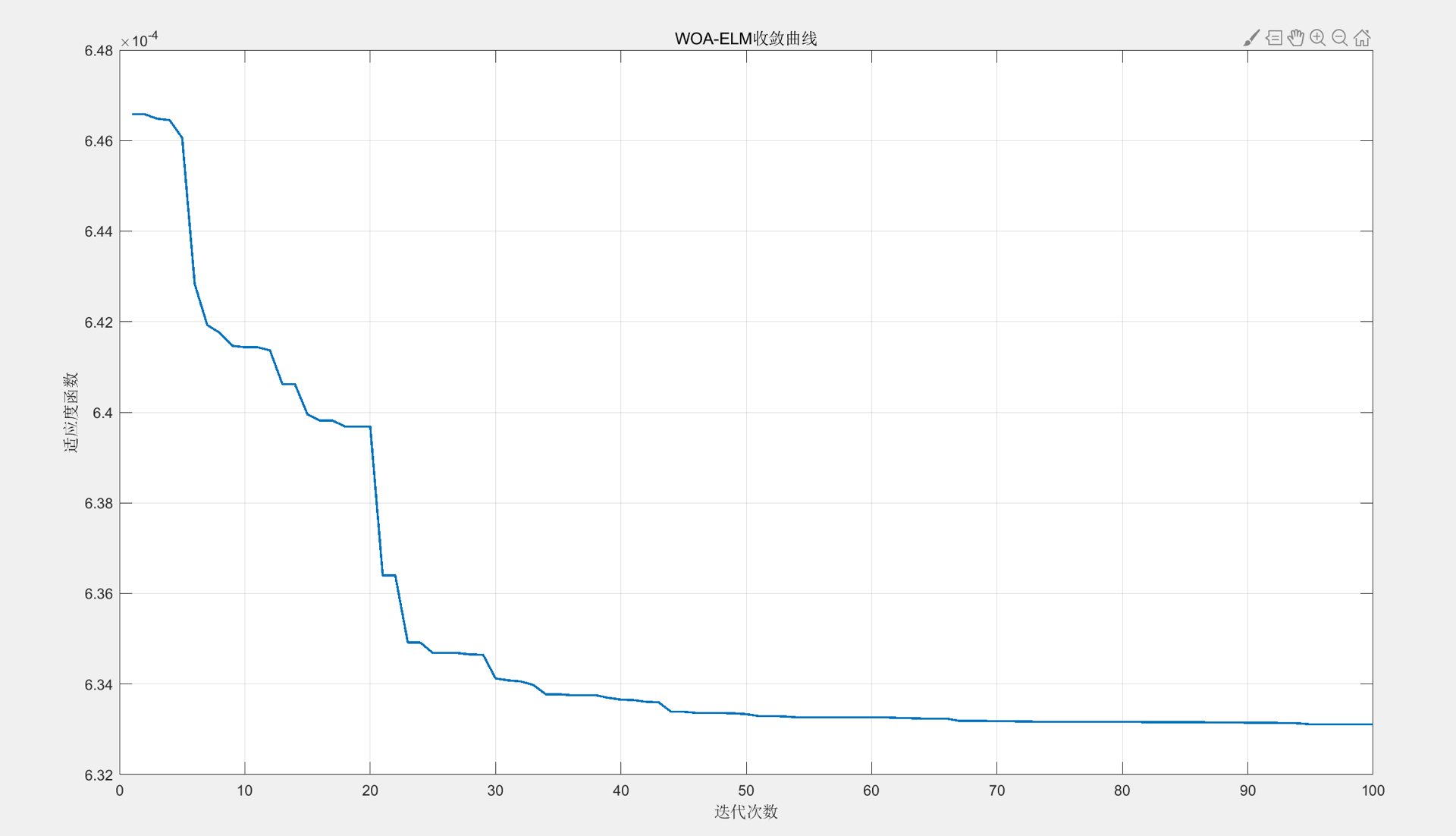

极限学习机是一种单隐层前馈神经网络,它在训练过程中只需要设置输入层与隐含层之间的连接权值和隐含层神经元的阈值,且这些参数可以随机生成。输出层的权值通过最小二乘法直接计算得到,这大大减少了训练时间。以下是简单的ELM代码示例(以Python为例,借助numpyclass ELM:return Y这里ELM类的init方法初始化了输入层大小、隐藏层大小和输出层大小,并随机生成输入层到隐藏层的权值W和隐

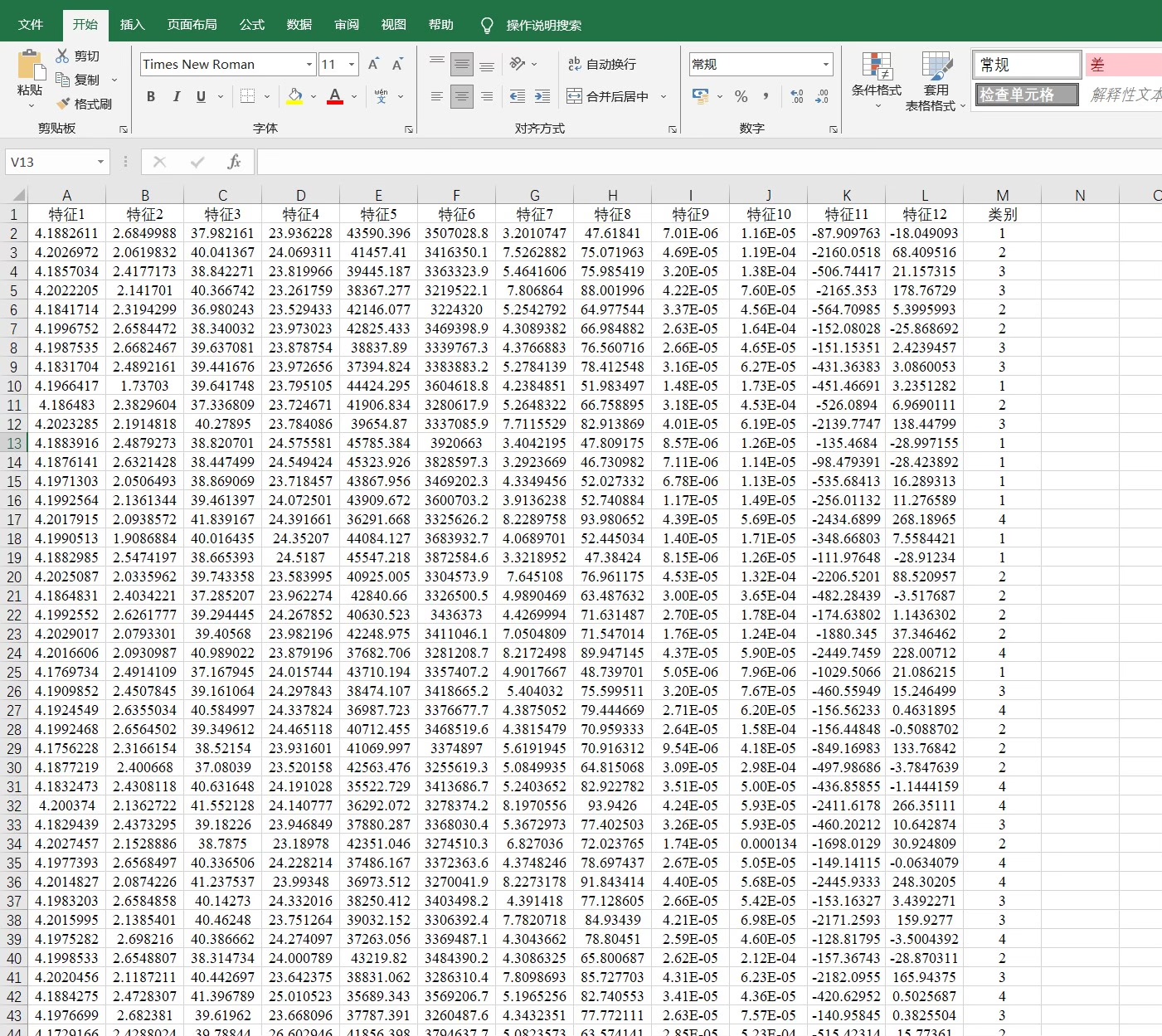

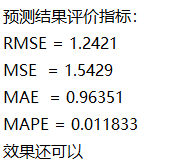

CNN-LSTM-Attention基于卷积-长短期记忆神经网络结合注意力机制的数据分类预测 Matlab语言程序已调试好,无需更改代码直接替换Excel即可运行1.多特征输入,LSTM也可以换成GRU、BiLSTM,Matlab版本要在2020B及以上。2.特点:[1]卷积神经网络 (CNN):捕捉数据中的局部模式和特征。[2]长短期记忆网络 (LSTM):处理数据捕捉长期依赖关系。[3]注意力

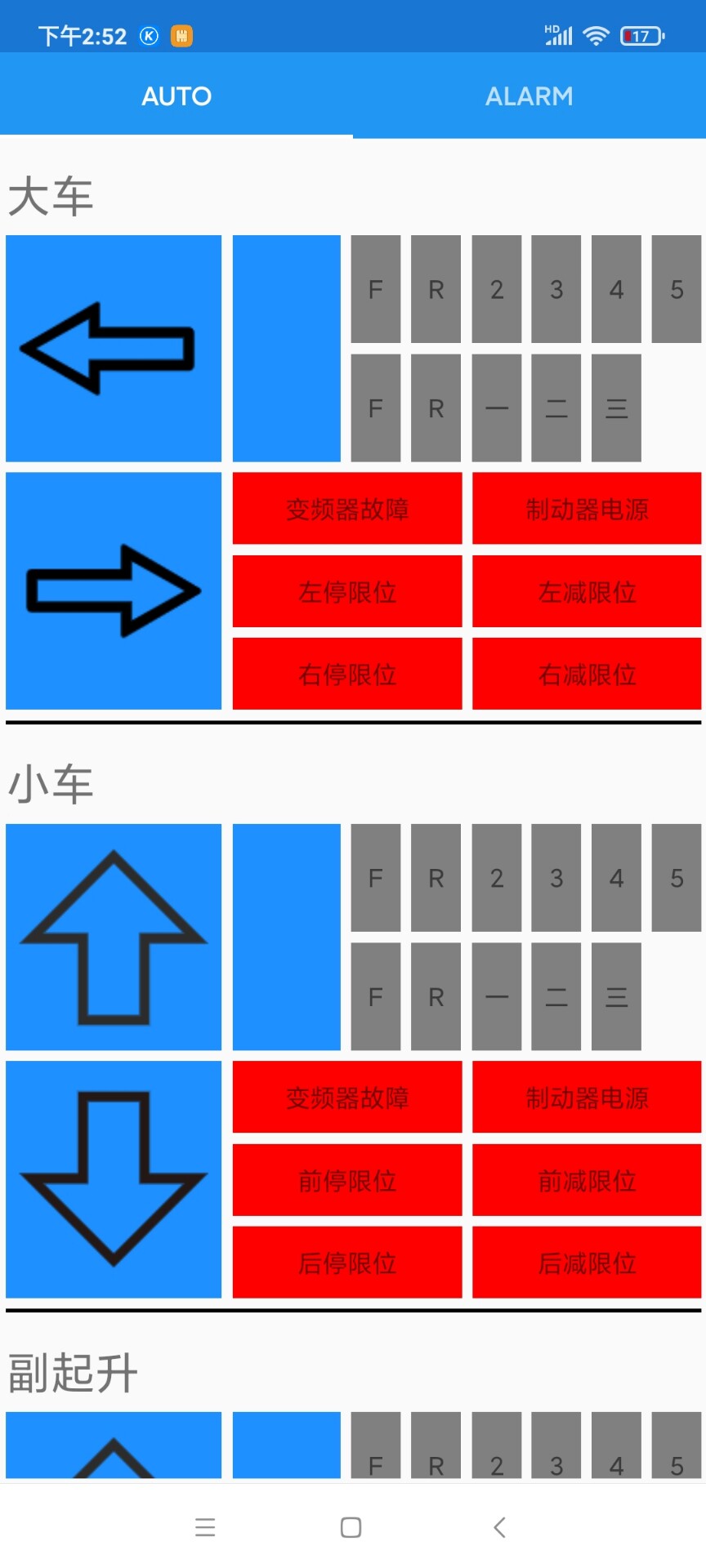

JXQZ.Android 是基于 Xamarin 技术栈开发的 Android 端应用模块,作为 C# 上位机 APP 的重要组成部分,主要用于配合监控西门子 PLC S7-1200 设备。该模块采用 Xamarin.Forms 框架实现跨平台 UI 适配,依托 Xamarin.Essentials 提供的设备功能接口,构建了具备工业设备监控核心能力的移动应用端,可实现设备状态展示、操作控制及异常

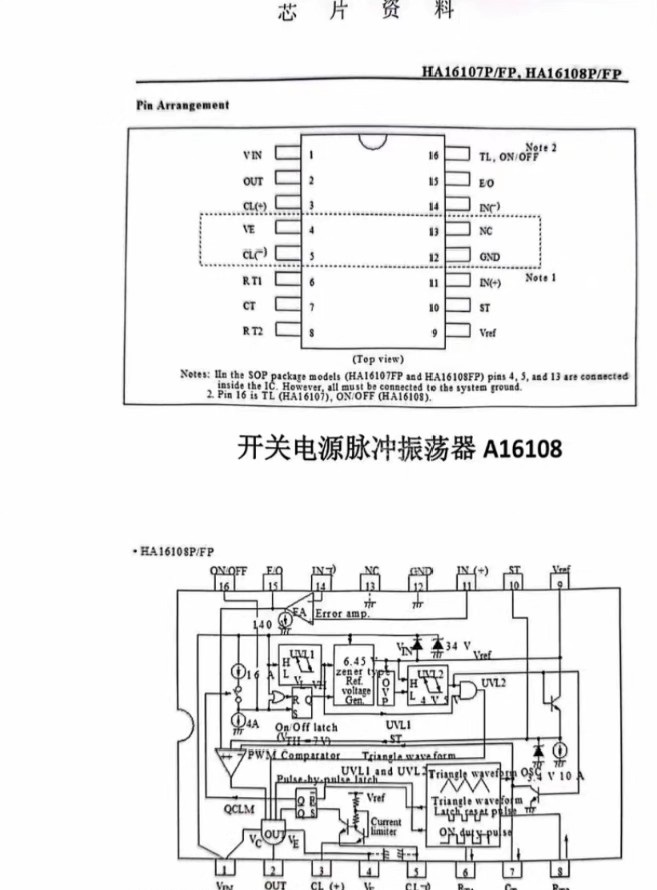

发那科驱动器原理图纸FANUC电路板维修图纸(最新图纸、带注释、带笔记、带讲解、带模块)发那科驱动器原理图纸FANUC电路板维修图纸(最新图纸、带注释、带笔记、带讲解、带模块)发那科驱动器原理图纸和FANUC电路板维修图纸均附有详细的注释和笔记。最新ban发那科电路板原理图纸,发那科驱动器图纸,带注释,笔记的,最新版本的。最新ban发那科电路板原理图纸,发那科驱动器图纸,带注释,笔记的,最新版本的

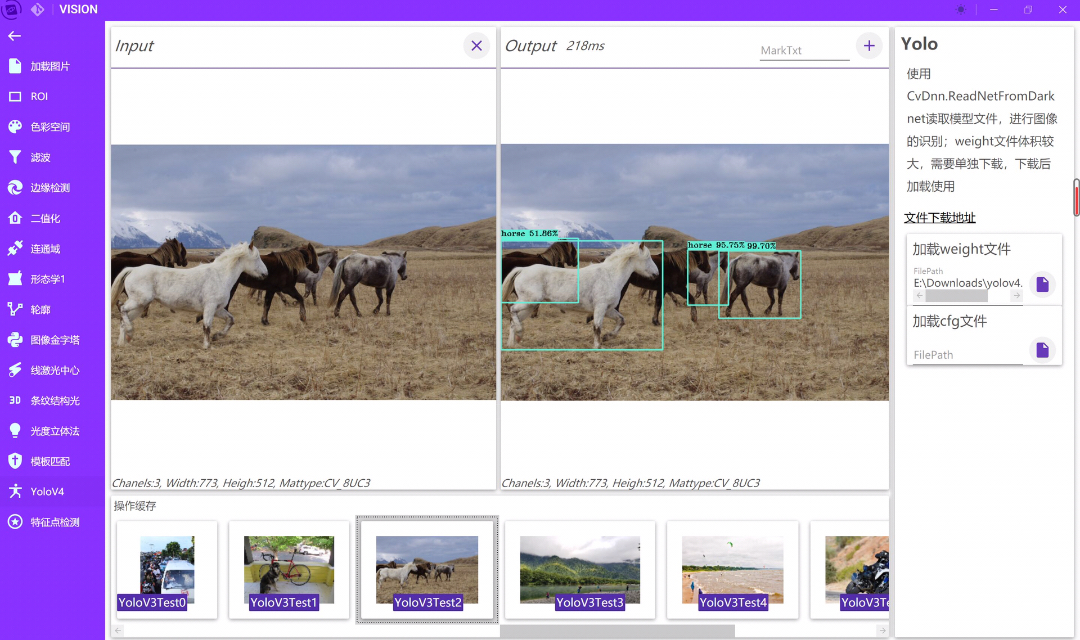

这是一个使用.net 6 基于wpf 、OpencvSharp(opencv的.net wrapper)、ReactiveUI等开发的自用工具,主要用来做ReactiveUI与OpencvSharp学习过程中的尝试以及opencv算子参数的调试等,该程序还可以显示3D点云数据(目前程序中的点云数据是由格雷码条纹拍摄的照片反算生成了,还可以导入标准的3d格式的文件stl、obj、objz、ply、3

电力系统状态估计是电网调度的"眼睛",今天咱们来扒一扒它的裤衩——哦不,是内核。防御招数也不是没有,比如上抗差估计或者数据驱动检测。这时候系统里每个母线的电压相角θ都算出来了,这就是咱们的"真理"。这波操作相当于把交流模型里那些cosθ≈1、sinθ≈θ的近似都用上了,误差肯定有,但架不住计算量小啊。电力系统状态估计,加权最小二乘直流状态估计,虚假数据注入攻击,基于matlab和matpower包

想深入交流参数调优技巧的可以私信,源码里还有加速计算的彩蛋没展开讲。这里有个小技巧:用sklearn的StandardScaler做标准化比手动计算均值方差方便得多,reshape(-1,1)保证维度不出错。这段代码的亮点在于把神经网络参数展开成一维向量作为麻雀位置,通过迭代寻找最优参数组合。注意view方法的使用,能快速重组参数矩阵。麻雀优化算法SSA优化BP做多特征输入单个因变量输出的分类模型

代码主要做的是一个分布式电源选址定容的问题,首先,构建了分布式电源选址定容问题的目标函数,包括网损最低以及运行成本最低,因此采用的是多目标模型,目标函数采用相关赋权值等方法转化为单目标,采用遗传算法进行求解,求解后运行可直接输出电源配置结果以及选址结果,并给出了每个节点的网损,配置前后的电压幅值,代码质量非常高;就像给算法装了ABS防抱死系统,既允许小幅越界探索,又能及时修正方向,实测约束违反次数

超参数搜索范围作用学习率(learning_rate)0.001~0.01(步长0.001)控制模型参数更新幅度隐含层神经元个数(numHiddenUnits)10~200(步长10)决定模型特征拟合能力GAPSO-LSTM结构% 输入层(特征维度=7/4/9)lstmLayer(numHiddenUnits);% LSTM隐含层(最优神经元个数)fullyConnectedLayer(numRe

这里有个骚操作:把节点数限制在5-15之间,学习率卡在0.01-0.1。电厂数据通常存在强耦合特征,节点太少抓不住规律,太多又容易把噪声当特征。代码文件里已经打包好数据预处理和可视化函数,改个文件路径就能跑。看预测结果对比图更直观——优化后的曲线终于不再像过山车,关键拐点捕捉准确率提升明显。GA遗传算法优化BP神经网络(GA-BPNN)回归预测MATLAB代码(有优化前后的对比)代码注释清楚。温馨