简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

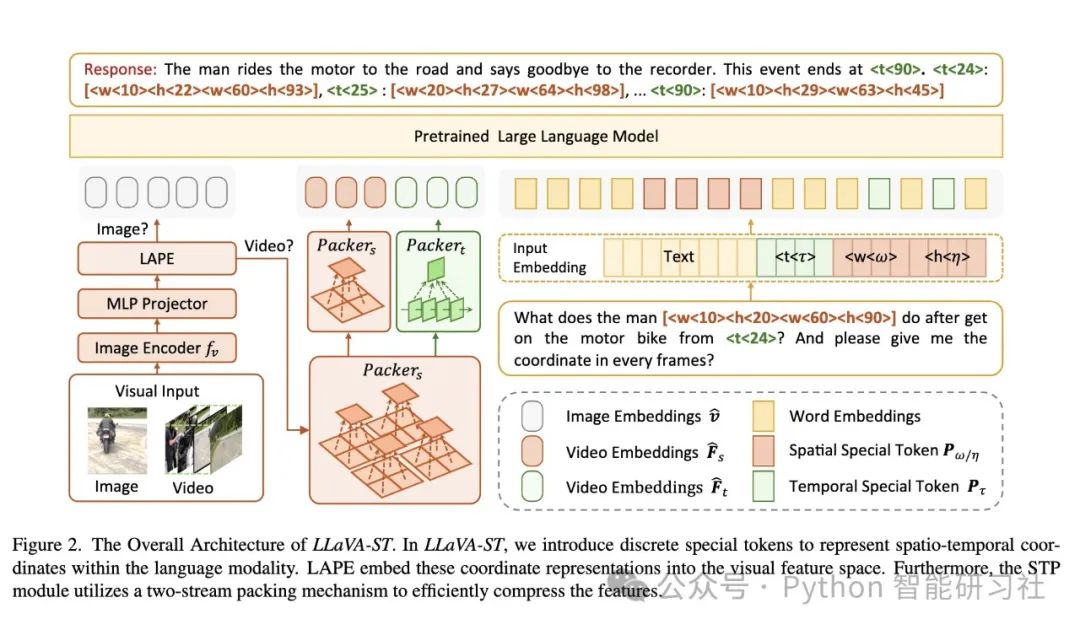

导读近日北航在论文《LLaVA-ST: A Multimodal Large Language Model for Fine-Grained Spatial-Temporal Understanding》介绍了新型多模态大语言模型LLaVA-ST,专门用于处理细粒度的时空理解任务,通过引入语言对齐的位置嵌入(LAPE)和时空打包器(STP),以及一个包含430 万样本的训练数据集ST-Align,

大语言模型(LLM)是一门博大精深的学科,涉及到高等数学、python编程、PyTorch/Tensorflow/Onnx等深度学习框架……然而奇妙的是,越是看上去难得要死、一辈子都学不完的技术,入门起来却越是容易。正如阿瑟·克拉克的名言:足够先进的科技看上去与魔法无异。大语言模型先进得如同魔法,我们这些麻瓜也许一辈子都没法完全理解它。但乐观地看,既然大语言模型是魔法,那我们就把它当魔法用好了,用

在会上,来自合合信息的丁凯博士在“垂直领域大模型论坛”作题为《文档图像大模型的思考与探索》的报告,分享了关于文档大模型的最新研究成果以及对未来的展望。他指出,尽管以Chat-GPT为代表的大语言模型和GPT4-V多模态大模型在文档领域取得了显著成果,但OCR文档图像识别等领域的核心问题仍然存在。如场景及版式的多样性、采集设备的差异性、用户需求的多样性、文档图像质量退化、文字检测及版面分析的困难、非

这是一篇由Weights & Biases发布的关于从头开始训练大语言模型(LLM)最佳实践的白皮书,主要内容包括模型训练的决策、硬件要求、数据处理、训练步骤、模型评估、风险应对以及后续优化等方面,旨在为从业者提供全面的指导。1. 构建与使用预训练模型的决策• 使用商业LLM API:如GPT - 3,技术门槛低,能快速应用于下游应用开发,但成本高,对数据敏感行业受限,灵活性差。

在这个日新月异的智能时代,人工智能(AI)已经从未来概念转变为推动各行各业发展的核心驱动力。作为连接技术与市场的桥梁,AI产品经理的角色愈发关键,他们不仅是技术的翻译者,更是创新的推动者。如果你正站在转型的十字路口,渴望踏入AI产品经理的行列,那么请跟随这篇指南,开启你的转型之旅。在人工智能的广阔蓝海中,转型为AI产品经理既是挑战也是机遇。通过不断学习、实践与创新,你将能够在这个充满无限可能的领域

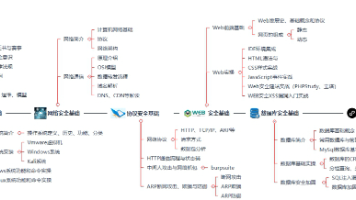

所提供的工具资料仅供学习之用。内容概要:包括 内网、操作系统、协议、渗透测试、安服、漏洞、注入、XSS、CSRF、SSRF、文件上传、文件下载、文件包含、XXE、逻辑漏洞、工具、SQLmap、NMAP、BP、MSF…书籍和学习文档资料是学习网络安全过程中必不可少的,我自己整理技术文档,包括我参加大型网安行动、CTF和挖SRC漏洞的经验和技术要点,电子书也有200多本,通过Whois查询可以查看域名

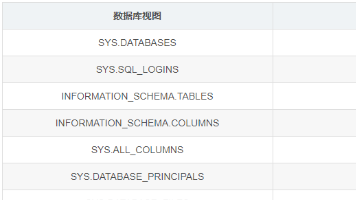

SQL注入攻击指的是通过构建特殊的输入作为参数传入Web应用程序,而这些输入大都是SQL语法里的一些组合,通过执行SQL语句进而执行攻击者所要的操作,其主要原因是程序没有细致地过滤用户输入的数据,致使非法数据侵入系统。可见该网络安全专业的技术性很强,具有鲜明的专业特点,是一门能够学到真正技术的工科类专业之一。内容概要:包括 内网、操作系统、协议、渗透测试、安服、漏洞、注入、XSS、CSRF、SSR

在当今人工智能技术日益成熟的背景下,大模型语言模型的应用越来越广泛。作为一名AI爱好者,我测试了五个平台的大模型,分别是ChatGPT、讯飞星火认知大模型、文心一言、昆仑天工和通义千问。通过对这五个平台的提问并得到其回答结果,我深刻感受到这些大模型的强大能力和潜力。首先,ChatGPT是一款备受瞩目的大模型语言模型,由OpenAI开发,可以生成高质量的自然语言文本,如新闻报道、科学论文、小说等。C

你已获取初始低权限访问(WebShell/钓鱼上线),身份为普通用户。提权 = 从游客权限 → 服务器最高控制权(SYSTEM/root)。

本文针对面临职业瓶颈的网络工程师,分析了转行原因(工作强度大、技术更新快、薪资瓶颈、兴趣转移),提出了6大转行方向:云计算、DevOps、网络安全、数据分析、产品经理等。文章详细规划了转行三阶段步骤(准备期、学习与实践期、求职落地期),并提供了应对年龄歧视、学习瓶颈等挑战的策略。强调转行是战略调整而非逃避,鼓励网络工程师利用自身技术优势,通过6-12个月系统规划实现职业转型。转行不是一时冲动,得先