简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

最近发现 MuMu 模拟器更了个狠活——最新版内置MuMu CLI,并开放了配合 Claude/Cursor 的 mumu-control skill,用自然语言就能直接操控模拟器!

我最近在对比多款数字人产品,发现一个很有意思的现象:很多数字人看着都能说话、有 3D 形象,但真正上手体验,交互质感天差地别。为什么同样是数字人,有的因为高延迟只能机械滞后播报,有的凭借低延迟做到实时共情沟通,今天我就以魔珐星云为例,聊聊两种数字人底层的本质区别。

在 2026 年只需要聚焦于核心业务逻辑和 Prompt 设计,善用 Dify 与 EdgeOne 这对黄金搭档,人人都可以是全栈超级个体DifyxEdgeOne最佳案例征集大赛

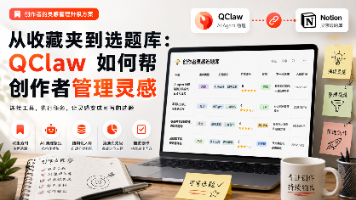

我收藏过很多好素材,但真正写文章时,最常发生的事不是没灵感,而是想不起自己收藏过什么。

在 2026 年只需要聚焦于核心业务逻辑和 Prompt 设计,善用 Dify 与 EdgeOne 这对黄金搭档,人人都可以是全栈超级个体DifyxEdgeOne最佳案例征集大赛

在 2026 年只需要聚焦于核心业务逻辑和 Prompt 设计,善用 Dify 与 EdgeOne 这对黄金搭档,人人都可以是全栈超级个体DifyxEdgeOne最佳案例征集大赛

最近试了一轮商汤开源的 SenseNova-U1。我一开始不是奔着“跑分”去的,而是想确认一件更实际的事:它到底能不能从在线体验过渡到本地部署,尤其是像我这种日常主力是 Mac 的开发环境,最后能不能把流程真实跑通。

最近试了一轮商汤开源的 SenseNova-U1。我一开始不是奔着“跑分”去的,而是想确认一件更实际的事:它到底能不能从在线体验过渡到本地部署,尤其是像我这种日常主力是 Mac 的开发环境,最后能不能把流程真实跑通。

最近试了一轮商汤开源的 SenseNova-U1。我一开始不是奔着“跑分”去的,而是想确认一件更实际的事:它到底能不能从在线体验过渡到本地部署,尤其是像我这种日常主力是 Mac 的开发环境,最后能不能把流程真实跑通。

我最近在对比多款数字人产品,发现一个很有意思的现象:很多数字人看着都能说话、有 3D 形象,但真正上手体验,交互质感天差地别。为什么同样是数字人,有的因为高延迟只能机械滞后播报,有的凭借低延迟做到实时共情沟通,今天我就以魔珐星云为例,聊聊两种数字人底层的本质区别。