简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

摘要 NVIDIA推出的GR00T N1是首个面向人形机器人的开放基础模型,采用Vision-Language-Action(VLA)架构,将视觉感知、自然语言理解和运动控制统一到端到端神经网络中。该模型借鉴人类双系统认知理论:System 2(10Hz运行的VLM模块)负责高层任务理解,System 1(120Hz运行的扩散Transformer)处理低层运动控制。核心组件包括自研的Eagle-

摘要 NVIDIA推出的GR00T N1是首个面向人形机器人的开放基础模型,采用Vision-Language-Action(VLA)架构,将视觉感知、自然语言理解和运动控制统一到端到端神经网络中。该模型借鉴人类双系统认知理论:System 2(10Hz运行的VLM模块)负责高层任务理解,System 1(120Hz运行的扩散Transformer)处理低层运动控制。核心组件包括自研的Eagle-

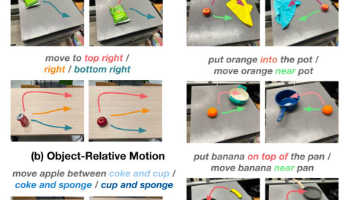

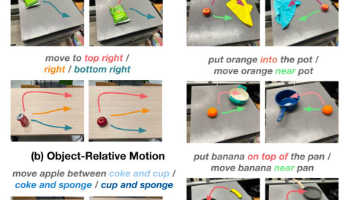

VLA(Vision-Language-Action)模型将视觉感知与语言指令直接映射为机器人动作,具备强大的多模态推理能力。然而,其巨大的计算开销在需要快速决策的实时机器人控制中构成严峻挑战。VLA-Cache是一种training-free 推理加速方法,通过跨帧自适应缓存与复用静态视觉 Token,消除冗余计算,在不修改模型结构、无需重新训练的前提下实现约1.7× CUDA 延迟加速和15%

本文系统解析了Transformer架构在不同领域的层级特征演化规律。在CNN中,Zeiler等人通过反卷积网络发现特征提取呈现清晰的层级结构:从浅层的边缘、纹理到深层的对象识别。BERT等语言模型同样展现出分层处理模式,底层关注词性、句法,高层处理语义和篇章信息。视觉Transformer(ViT)则表现出与CNN不同的特性,其各层表征相似度高且能保留空间信息。在多模态模型中,视觉和语言信息分三

本文提出VLA-Adapter,一种高效的视觉-语言-动作(VLA)小模型范式。研究表明,通过精心设计的Policy网络和Bridge Attention机制,仅0.5B参数的Qwen2.5骨干无需机器人数据预训练即可在LIBERO基准上达到97.3%平均成功率。核心创新包括:(1)系统分析两类条件特征(Raw Features和ActionQuery Features)对动作生成的影响;(2)轻

第一代(RT-1):从机器人数据学习,任务特定第二代(RT-2, RT-X):融合互联网数据,跨embodiment泛化第三代(OpenVLA, Octo):开源基础模型,模块化设计第四代(GR00T, π0.5):双系统架构,开放世界泛化未来方向(WorldVLA, CoA-VLA):物理推理、可供性理解VLA模型正将机器人从"工具"转变为"智能体"。从Google DeepMind的RT-2奠

第一代(RT-1):从机器人数据学习,任务特定第二代(RT-2, RT-X):融合互联网数据,跨embodiment泛化第三代(OpenVLA, Octo):开源基础模型,模块化设计第四代(GR00T, π0.5):双系统架构,开放世界泛化未来方向(WorldVLA, CoA-VLA):物理推理、可供性理解VLA模型正将机器人从"工具"转变为"智能体"。从Google DeepMind的RT-2奠