简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文介绍了使用Q-LoRA方法微调DeepSeek-R1-1.5B-Distill模型的金融领域实践。通过81条金融数据集进行50个epoch的8-bit量化训练,使用SwanLab监控训练过程。结果显示微调后模型回答更简洁专业,但对金融知识的理解仍受限于训练数据量。文章详细解析了黄金ETF、财务杠杆等金融术语,并对比了微调前后模型在REITs、CDS等概念解释上的差异。实验表明,小数据集更适合优

本文介绍了在AutoDL云平台上部署和微调Qwen2.5-7B大模型的全过程。首先在AutoDL购买GPU实例,然后通过Xshell和Xtfp工具上传数据集到指定目录。重点说明了如何修改dataset_info.json文件注册自定义数据集,包括定义数据集名称、文件路径和数据列映射关系。接着详细描述了通过WebUI界面进行模型微调的步骤:包括设置SSH连接、选择模型路径、配置Lora秩等参数,并解

文章摘要:本文系统介绍了大模型微调方法,包括全量参数微调、冻结微调和高效微调三大类。全量微调虽性能最优但资源消耗大;冻结微调通过固定底层参数实现高效训练;高效微调重点介绍了Adapter、Prefix/Prompt Tuning和LoRA等方法,其中LoRA通过低秩分解在效果、稳定性和资源消耗方面表现最佳。文章还探讨了QLoRA量化技术,通过4-bit量化和混合精度训练显著降低显存需求。这些方法为

大模型微调实践面临数据与算力双重挑战:1)数据瓶颈表现为原生数据存在隐私/清洗难题,衍生数据成为主流解决方案;2)微调本质是参数重分配,需平衡新能力获取与原有能力保留。关键实践要点包括:优先选择Chat/Instruct模型而非Base模型,按任务类型构建数据集(模式调整需少量数据,知识注入需大量专业数据),严格遵循Alpaca/ShareGPT格式规范。硬件配置需匹配模型规模(如7B模型需20G

摘要: LLaMA-Factory WebUI提供简易训练界面,支持主流模型的拖拉拽配置、多样化量化模式(如4bit/8bit)和训练可视化。核心功能包括模型选择(100+LLM)、微调方法(如LoRA)、量化设置及训练阶段切换。调参难点涉及量化类型(BitsAndBytes/HQQ/EETQ)、训练阶段(SFT/RewardModeling)、学习率调节器(Warmup/余弦衰减)、RoPE插值

本文详细介绍了LLaMAFactory面板的配置与使用流程,包括服务器连接、模型参数设置、训练启动和结果分析等关键环节。重点说明了模型路径配置、量化等级选择、梯度范数限制等参数设置要点,以及LoRA微调方法、DeepSpeed加速等优化技术。同时提供了训练监控、模型保存、推理验证等操作指南,并针对常见问题如显存不足、精度下降等给出了解决方案。通过完整的配置-训练-验证流程,帮助用户高效完成模型微调

摘要:AutoDL提供学术资源加速服务,解决GitHub和HuggingFace访问慢的问题。主流微调框架包括HuggingFace Transformers、PEFT、LLaMA-Factory等,其中LLaMA-Factory支持多种大语言模型,安装需Python 3.10、PyTorch 2.6.0等。硬件要求根据模型大小和微调方法不同,显存需求从6GB到120GB不等。课程以LLaMA-F

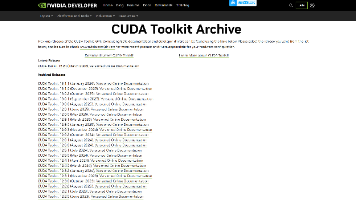

本文介绍了GPU工具包的安装与配置流程。首先通过nvidia-smi和nvcc-V命令检查CUDA驱动和编译器版本,确保版本匹配(CUDA版本需低于驱动版本)。Windows系统需从NVIDIA官网下载匹配版本的CUDA工具包,选择exe文件安装并解决Visual Studio依赖问题。配置cuDNN时需要注册账号,下载对应版本后将其文件复制到CUDA目录,并通过bandwidthTest.exe

本文介绍了GPU工具包的安装与配置流程。首先通过nvidia-smi和nvcc-V命令检查CUDA驱动和编译器版本,确保版本匹配(CUDA版本需低于驱动版本)。Windows系统需从NVIDIA官网下载匹配版本的CUDA工具包,选择exe文件安装并解决Visual Studio依赖问题。配置cuDNN时需要注册账号,下载对应版本后将其文件复制到CUDA目录,并通过bandwidthTest.exe

本文介绍了在AutoDL平台上租用GPU服务器运行Qwen2.5-7B模型的具体步骤。主要内容包括:1)注册AutoDL账号并完成实名认证;2)选择RTX4090等24GB显存显卡创建实例;3)通过Xshell等工具连接服务器;4)安装必要的Python库和环境配置;5)通过ModelScope或HF镜像下载Qwen2.5-7B模型;6)操作注意事项及关机重启流程。重点说明了如何将工作目录迁移到数