Embedding模型:AI如何“读懂”世界?大模型入门到精通,收藏这篇就足够了!

这篇文章,我们就用几个好懂的比喻,聊聊Embedding模型到底是怎么工作的,为什么它对AI那么重要。

你有没有想过,AI助手是怎么听懂我们的话,还能从海量信息里找到精准答案的?它不像我们一样一个字一个字地看,而是用一种更聪明的方法来“感知”语言。这个方法的核心,就是我们今天要聊的Embedding模型。

简单说,Embedding模型是个“翻译官”,但它翻译的不是语言,而是“意思”。它把人类的文字、句子,变成机器能懂的数学语言——向量。这个过程,就像是把每个词语和句子的“灵魂”抽出来,放到一个巨大的空间里,让机器能“看到”它们之间的关系。

这篇文章,我们就用几个好懂的比喻,聊聊Embedding模型到底是怎么工作的,为什么它对AI那么重要。

一、核心比喻:一座按“意思”分类的图书馆

想象一个特别的图书馆,里面的书不是按书名首字母或者分类号摆放的,而是按照书的“内在含义”来组织的。这就是Embedding模型为我们打造的“语义图书馆”。

1.1 “图书管理员”:Embedding模型

这个图书馆的管理员就是Embedding模型。它不关心书的标题是什么,只关心书里讲了什么。拿到一本书(也就是一段文字),它会先“读”懂内容,然后给它一个独特的“坐标”,这个坐标就是向量。

1.2 “书架”:一个多维度的“意义空间”

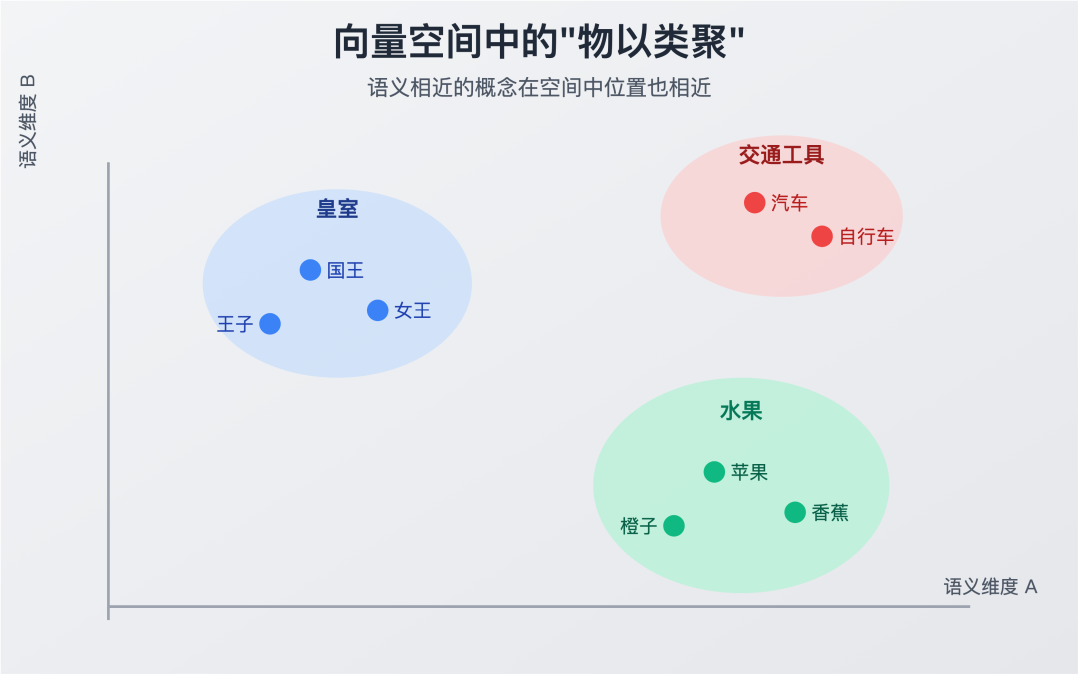

整个图书馆,就是一个由无数坐标构成的多维度空间。在这个空间里,书的摆放规则很简单:

- • 意思相近的,挨在一起:讲“苹果公司历史”的书,和讲“乔布斯传记”的书,会被放在很近的地方。它们在空间里的距离,代表了它们在意思上的亲近程度。

- • 风马牛不相及的,离得老远:一本讲“量子力学”的书,和一本“中世纪菜谱”,在馆里会隔着十万八千里。

语义邻近性

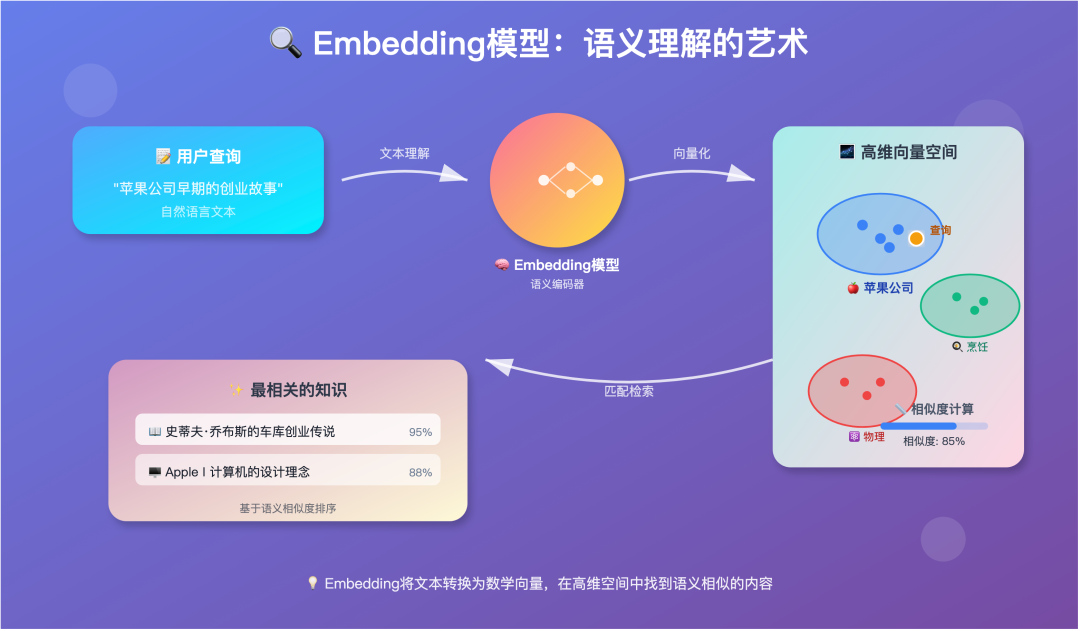

1.3 “找书”:一场“意义”的匹配

现在,你想找关于“苹果早期创业故事”的资料。你把这个想法告诉管理员(输入你的问题)。

管理员会做两件事:

-

- 理解你的想法:它先把你的问题也变成一个空间坐标,这个坐标代表了你的“寻书意图”。

-

- 寻找最“近”的书:然后,它就拿着这个坐标,在图书馆里找离它最近的那些书。距离越近,意思就越匹配。最后,它会把最相关的几本书(知识)递给你。

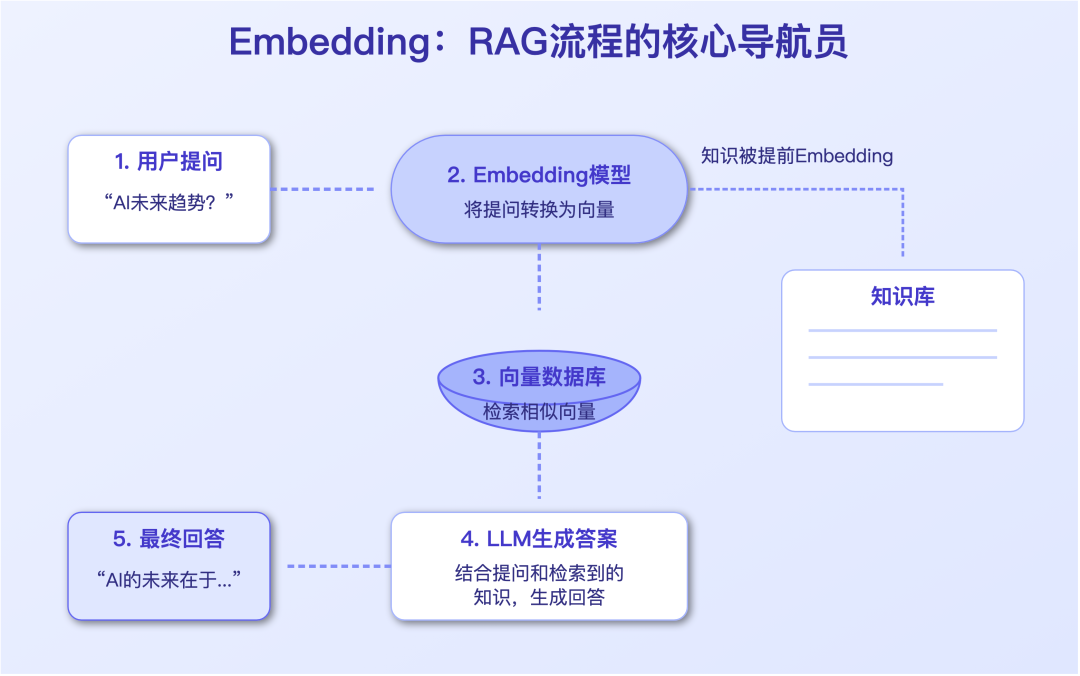

这就是Embedding模型在RAG(检索增强生成)系统里的核心工作。它把所有知识和问题都“坐标化”,让AI能高效地找到最相关的参考信息。

语义图书馆

二、模型的“成长”:从学徒到大厨

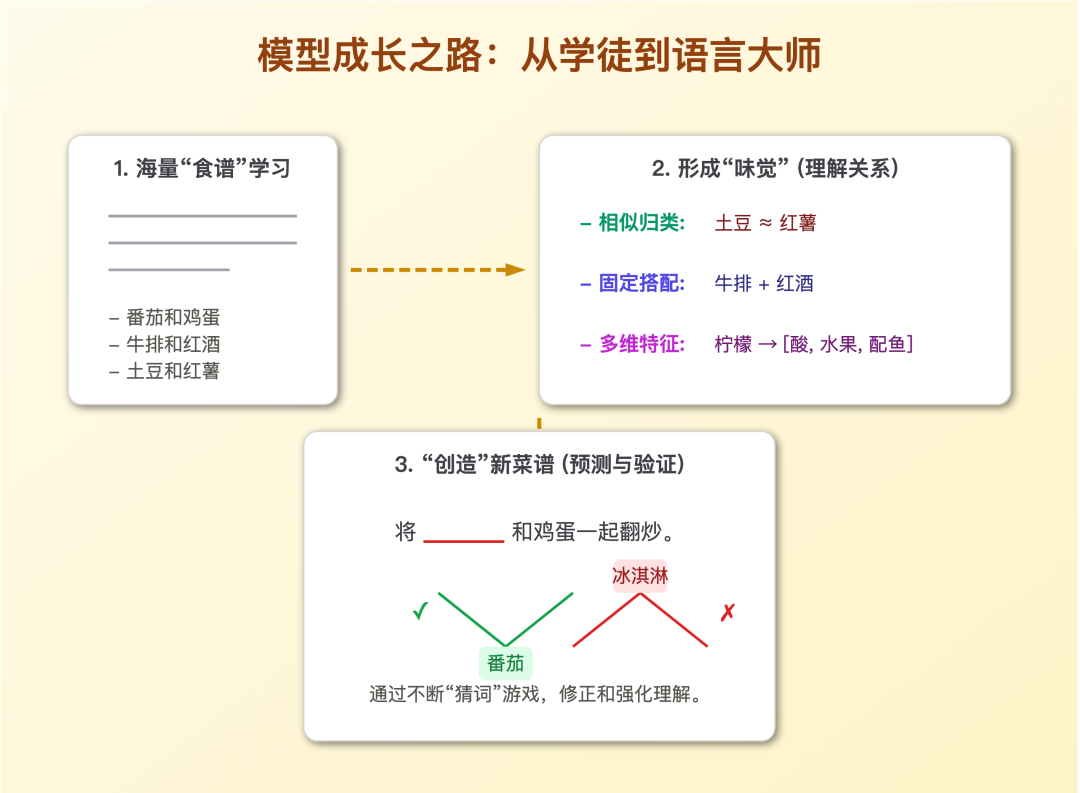

这么厉害的“图书管理员”,是怎么炼成的?它不是天生的大师,更像一个厨艺学徒,通过学习无数“菜谱”(海量文本数据)慢慢成长起来的。

2.1 尝遍百味:形成对词语的“味觉”

一开始,学徒只是死记硬背。他知道“番茄”和“鸡蛋”总是一起出现,但不知道为啥。见得多了,他脑子里就有了个模糊的印象:这两个词关系很“近”。

后来,他开始有了自己的“味觉”,能品出词语间的微妙关系:

- • 发现“亲戚”:他发现“土豆”和“红薯”都能做成薯条,口感也像,就把它们归为一类。这就是模型学会了找近义词。

- • 记住“CP”:他牢牢记住,“牛排”配“红酒”是经典,配“可乐”就差点意思。这就是模型理解了语言里的固定搭配。

- • 品出“层次感”:他知道“柠檬”不只是“酸”,还是“水果”,也常跟“鱼”搭档。这种多维度的理解,就像模型在一个立体的空间里给每个词定位,让它的“形象”更丰满。

厨师成长之路

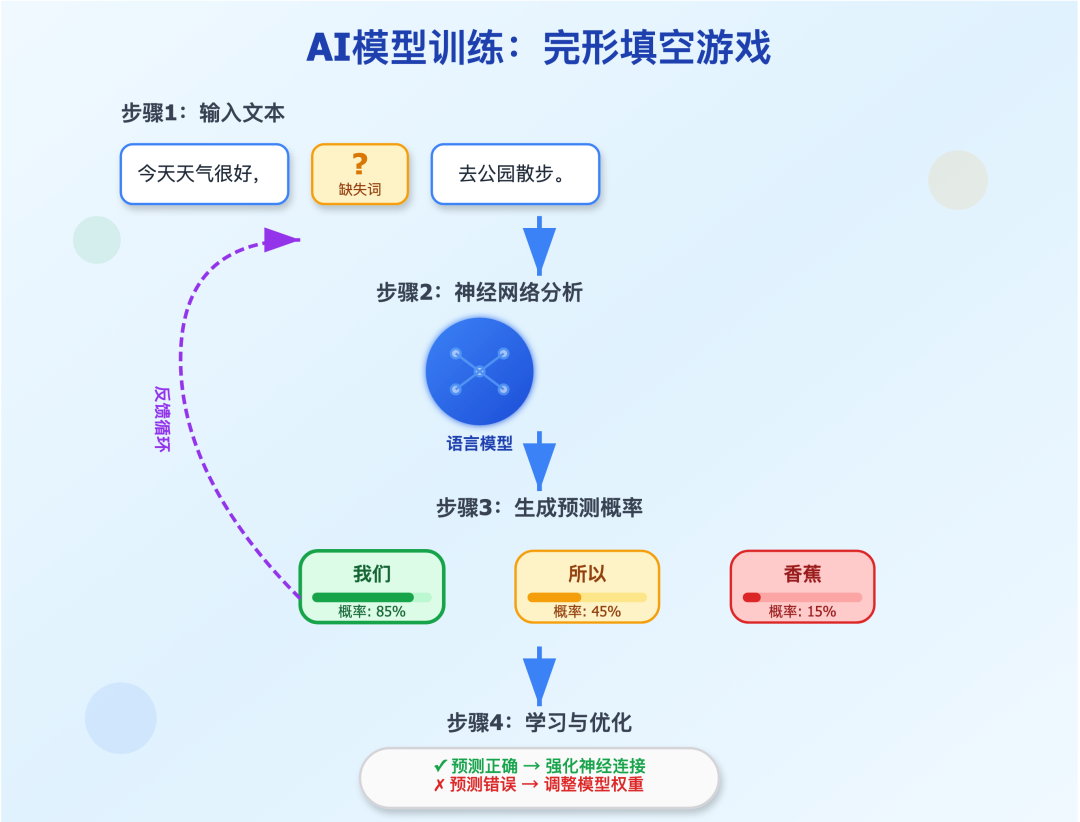

2.2 厨艺大比拼:在“完形填空”中精进

学徒要出师,得能自己“创作”。比如,看到菜谱上写着“将____和鸡蛋一起炒”,他能凭经验猜出,这里填“番茄”或“韭菜”最靠谱,填“冰淇淋”就离谱了。

这个“猜词”游戏,就是Embedding模型训练的核心。它在海量文本里做无数次“完形填空”,猜对了,就强化一下自己的理解;猜错了,就调整一下自己的“味觉”,直到对词语间的关系了如指掌。

就这样,一个普通的学徒,最终炼成了能洞察语言奥秘的“大厨”,他那座“语义图书馆”,也变得越来越有智慧。

预测游戏

结语:AI的“第六感”与“语感”

所以,AI是怎么“读懂”世界的?靠的就是Embedding模型这个“翻译官”,它给了AI一种近似于人类的“第六感”——对意义的直觉。

在RAG系统里,Embedding模型是外置的“超级导航员”,总能带着AI在海量知识库里找到最精准的参考资料。这解决了AI“记不住”海量事实的问题。

但一个更有趣的问题是:如果没有RAG这座“图书馆”,现代大模型(如GPT)自己的“大脑”又是如何思考的?

其实,Embedding同样是它们认知能力的核心,但扮演着一个更内在的角色——“语感神经网络”。

当你和AI对话时,它会把你的每一句话、甚至整个对话历史都实时地“Embedding化”,在它自己的高维空间里形成一个动态的“语境向量”。这个向量,就像是AI的“短期记忆”或“思路”,时刻捕捉着对话的重心和情感走向。

接下来,AI要生成下一个词时,它会:

-

- 感知当前“语境”:它会审视这个代表了上下文的“语境向量”。

-

- 预测最“和谐”的下一个词:它会在自己的词汇空间里,寻找那些与当前“语境向量”在意义上最连贯、最和谐的词语。它会选择概率最高的那个,然后生成出来。

-

- 更新“语境”:新生成的词又被吸收到“语境向量”里,成为下一步思考的基础。

这个过程,就像我们说话时会下意识地让上下文保持连贯一样。AI不是在机械地查字典,而是在一个由Embedding构建的“意义空间”里,凭借着对“语境”的感知,进行着流畅的“思维接力”。

因此,Embedding不仅是RAG的基石,更是现代大语言模型能够连贯思考、理解复杂对话的根本。它既是AI探索外部知识世界的“第六感”,也是其构建内部思想世界的“语感”。下次再与AI流畅对话时,不妨想想,是Embedding在背后为它的每一个词,都赋予了恰到好处的“灵魂”。

RAG工作流

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)