安装spark时输入spark-shell报错 “系统找不到指定的路径“

安装spark时输入spark-shell报错 “系统找不到指定的路径“

·

安装spark时输入spark-shell报错 “系统找不到指定的路径“

这个问题在网上大部分人都是说 Java_Home 配置的有问题,或者调节 Java_Home 和 Spark_Home 顺序来表示执行优先级,但是我试了各种方法之后都没有成功。

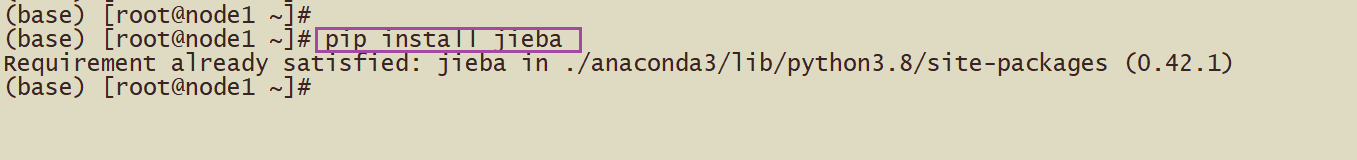

1、检查是不是已经安装了pyspark

大家可以检查一下是不是已经安装了pyspark,如果之前安装了pyspark,那么此时在cmd里运行spark-shell是会找不到指定路径的。

可以先将pyspark卸载掉,用

pip uninstall pyspark

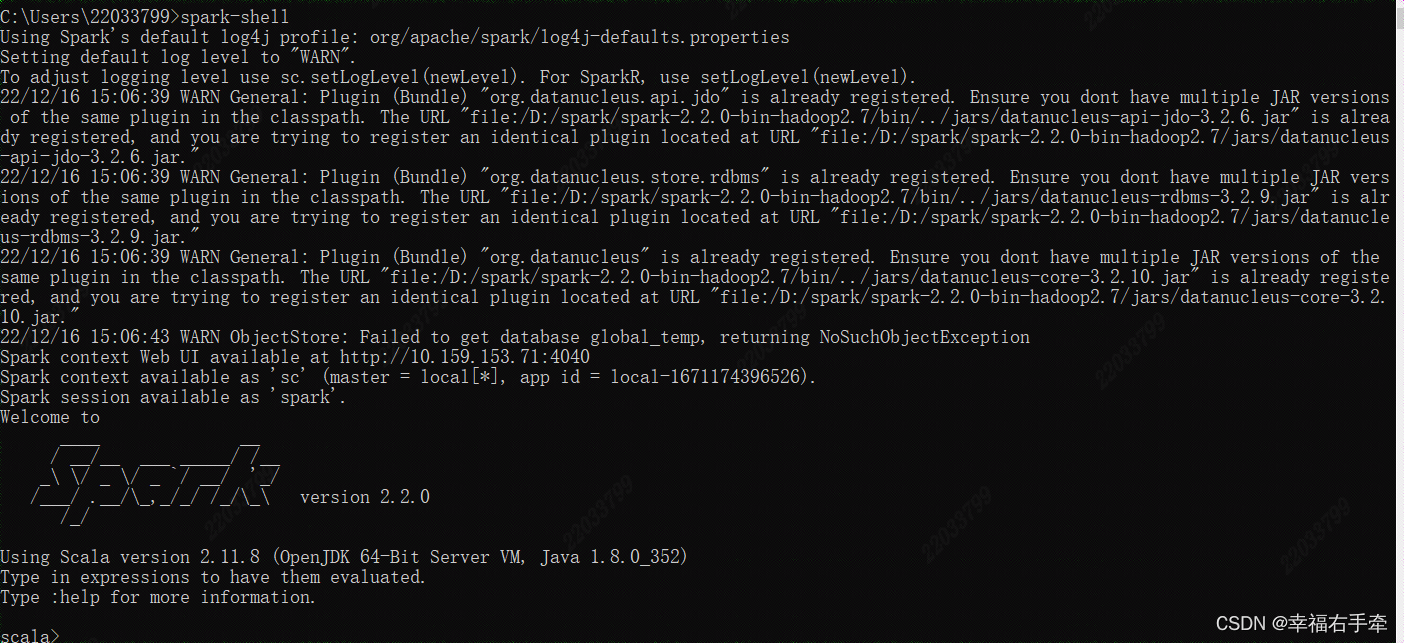

然后打开cmd输入spark-shell就可以出现。

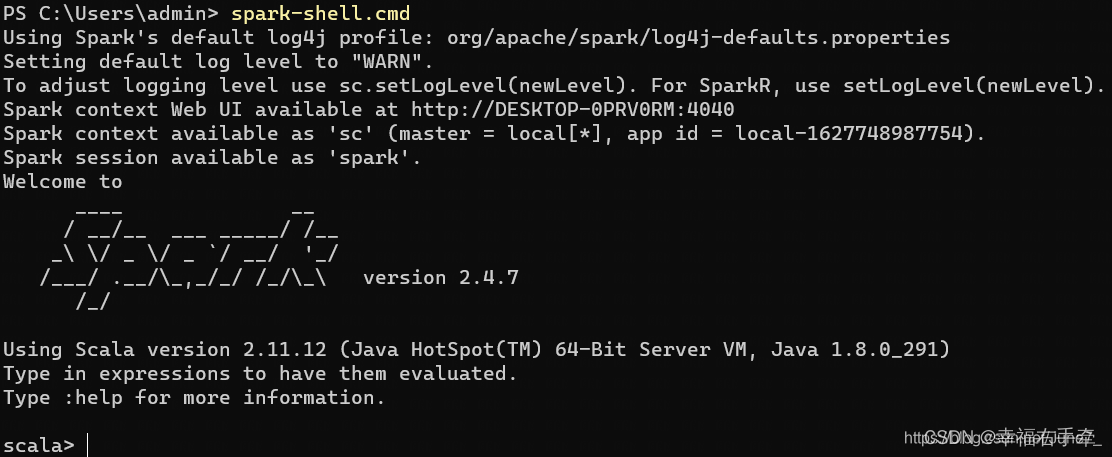

2、用spark-shell.cmd命令

如果不卸载pyspark,那么可以用spark-shell.cmd,也可以进入spark。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)