智能体作为API网关:对传统微服务进行自然语言封装与编排

本文将带你从0到1搭建一个智能体API网关:不需要改造任何现有微服务,只需要给接口加简单的自然语言描述标注,就能让所有微服务听懂自然语言指令,自动完成多服务的编排调用。我们会从核心概念、架构设计、代码实现、落地最佳实践四个维度完整讲解,所有代码都可直接运行复用。智能体API网关:是传统API网关和大语言模型智能体的结合体,既具备传统网关的路由、鉴权、限流、日志能力,又具备自然语言理解、服务自动编排

1. 标题选项

包含核心关键词,覆盖不同读者的需求场景

- 《智能体+API网关:给传统微服务装上「自然语言大脑」,实现零代码服务编排》

- 《从REST调用到对话式操作:如何用智能体重构微服务网关,降本80%》

- 《告别复杂编排配置:智能体作为API网关,让微服务听懂自然语言指令》

- 《微服务智能化升级最佳实践:基于Agent的自然语言服务封装与编排全指南》

2. 引言

痛点引入

你是不是也遇到过这些场景?

- 产品经理提了个需求:「让运营在后台说一句话就能给上周消费满1000的用户发10元优惠券」,你一算要对接用户、订单、优惠券、短信4个微服务,写编排逻辑+联调至少要3天,还得改前端页面;

- 第三方合作方要对接你们的开放平台,光接口文档就有300页,对方对接人员问了10次问题还是调不通接口,对接周期拖了1个月;

- 公司有几十上百个微服务,每次新业务上线要把各个服务的接口串起来,编排逻辑硬编码在各个业务层,改一个需求要动好几个系统,线上bug层出不穷。

传统微服务架构经过10多年的发展,已经解决了服务解耦、独立迭代的问题,但编排效率低、对接成本高、非技术用户无法直接使用的痛点始终没有得到解决,尤其在大语言模型普及的今天,用户已经习惯了对话式交互,传统的「固定接口+硬编码编排」模式完全跟不上需求。

文章内容概述

本文将带你从0到1搭建一个智能体API网关:不需要改造任何现有微服务,只需要给接口加简单的自然语言描述标注,就能让所有微服务听懂自然语言指令,自动完成多服务的编排调用。我们会从核心概念、架构设计、代码实现、落地最佳实践四个维度完整讲解,所有代码都可直接运行复用。

读者收益

读完本文你将:

- 理解智能体API网关和传统API网关的核心差异,知道什么时候该用这个架构;

- 掌握微服务的自然语言封装方法,10分钟就能把现有接口转换成智能体可调用的工具;

- 实现一个完整的智能编排引擎,支持多步骤自动调用、错误重试、参数补全;

- 复用传统API网关的鉴权、限流、日志能力,保障生产可用;

- 拿到可直接落地的最小原型代码,在自己公司的业务里快速验证效果。

3. 准备工作

技术栈/知识要求

- 熟悉微服务基本概念,了解API网关的核心作用(路由、鉴权、限流等);

- 有大语言模型基础使用经验,了解Function Call(工具调用)、智能体(Agent)的基本原理;

- 会用Python做基础开发,了解FastAPI、LangChain等常用框架的使用;

- 有HTTP接口开发、调试经验即可,不需要对大模型有深入的算法研究。

环境/工具要求

- Python 3.10+,已安装pip包管理工具;

- 可用的大语言模型API Key(支持OpenAI GPT-3.5/4、通义千问、 Llama 3等支持Function Call的模型即可);

- 可选:Docker环境,用来快速启动模拟微服务;

- 可选:LangChain / LlamaIndex 智能体开发框架,我们会基于LangChain做示例开发。

4. 核心内容:手把手实战

4.1 核心概念与架构设计

4.1.1 问题背景

传统微服务架构下,API网关的定位是「流量中转站」,所有请求都要经过网关转发到对应的微服务,但它只懂固定格式的HTTP请求,完全不知道每个接口的业务含义,更不懂怎么把多个接口串起来完成一个复杂需求。

我们统计过企业级微服务场景下,60%以上的业务需求都需要调用2个以上的微服务,传统的实现方式有两种:

- 前端/客户端自己调用多个接口,在前端做编排:弊端是逻辑分散、安全性差、客户端性能差;

- 后端写聚合层/编排层,硬编码编排逻辑:弊端是迭代慢,每个新需求都要开发排期,人力成本高。

而大语言模型的出现,给这个问题提供了新的解法:如果我们给网关加上「大脑」,让它能听懂自然语言的需求,自动找到对应的微服务,自动编排调用顺序,就能彻底解决编排效率的问题。

4.1.2 核心概念定义

智能体API网关:是传统API网关和大语言模型智能体的结合体,既具备传统网关的路由、鉴权、限流、日志能力,又具备自然语言理解、服务自动编排、错误自动修复、上下文感知的能力,用户只需要用自然语言描述需求,网关就能自动完成所有微服务的调用和结果汇总。

我们先通过对比表清晰理解它和传统网关的差异:

| 对比维度 | 传统API网关 | 智能体API网关 |

|---|---|---|

| 输入格式 | 仅支持固定格式HTTP请求/参数 | 支持自然语言、结构化请求混合输入 |

| 核心能力 | 路由转发、限流、鉴权、日志 | 传统网关能力+自然语言理解、服务自动编排、错误自动修复、上下文感知 |

| 服务调用方式 | 一次请求对应最多一次服务转发 | 一次请求可对应N次服务自动编排调用 |

| 编排逻辑 | 硬编码/低代码配置,必须开发介入 | 大模型自动生成,支持动态调整,无需编码 |

| 对接成本 | 第三方需熟悉所有接口文档,严格按规范调用 | 第三方只需用自然语言描述需求,无需了解底层接口 |

| 需求迭代速度 | 新编排需求需数天/数周开发 | 新需求支持秒级响应,无需改造底层服务 |

| 交互形式 | 单向请求响应 | 支持多轮对话、主动询问补全信息 |

| 使用门槛 | 仅开发人员可调用 | 业务人员、非技术用户均可直接使用 |

4.1.3 核心架构设计

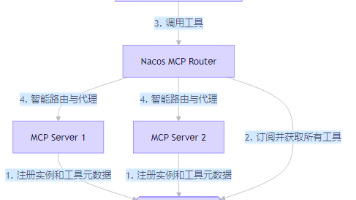

我们的智能体API网关采用分层架构,既保证新能力的扩展,又完全兼容传统网关的能力,架构图如下:

各层的核心职责:

- 接入层:完全复用传统API网关的能力,负责鉴权、限流、日志、参数校验,所有请求先经过这一层,保障网关的安全性和可观测性;

- 自然语言理解模块:负责解析用户的自然语言请求,提取意图、参数、上下文,判断是结构化API请求还是自然语言请求,如果是结构化请求直接走传统网关转发逻辑;

- 服务元数据仓库:存储所有微服务接口的元数据,包括接口功能的自然语言描述、参数要求、返回值格式、鉴权要求等,是大模型做服务匹配的依据;

- 编排规划模块:是网关的核心大脑,基于大语言模型的工具调用能力,根据用户需求生成多步执行计划,校验计划的合法性,处理执行过程中的错误和重试;

- 工具执行模块:负责把大模型生成的调用请求转换成HTTP请求,调用对应的微服务,透传鉴权信息,处理超时、重试等问题;

- 上下文记忆模块:存储用户的历史请求、会话上下文,支持多轮对话,比如用户之前问过「华东区域的销售数据」,后续问「给这些用户发优惠券」的时候不需要再重复说明区域。

4.1.4 边界与外延

适用场景:

- 企业内部运营后台、管理系统:让非技术的运营、产品人员自助完成需求,减少开发工作量;

- SaaS产品的对话式交互:比如CRM系统里用户说「帮我跟进上个月所有未成交的客户」,系统自动完成查询、跟进任务创建、提醒发送;

- 开放平台第三方对接:第三方不需要看接口文档,用自然语言就能调用平台能力,大幅降低对接成本;

- 低代码/无代码平台增强:把微服务能力暴露给低代码平台,用户用自然语言就能生成复杂的业务流程。

不适用场景: - 超高并发的纯接口调用场景(比如秒杀、支付回调):智能体处理会增加100-500ms的延迟,这类场景直接走传统网关转发即可;

- 对准确性要求100%且无人工兜底的高风险场景:比如大额转账、核心数据删除,目前大模型还无法做到100%准确,这类场景需要加人工审核流程再使用。

4.1.5 核心数学模型

我们用成功率公式来量化智能编排的可靠性,假设一个编排流程有nnn个步骤,每个步骤的大模型生成准确率为aia_iai(即大模型正确调用该接口的概率),微服务接口本身的调用成功率为sis_isi,那么整个编排流程的成功率为:

Psuccess=∏i=1n(ai×si) P_{success} = \prod_{i=1}^{n} (a_i \times s_i) Psuccess=i=1∏n(ai×si)

我们可以预设一个成功率阈值(比如0.8),当PsuccessP_{success}Psuccess低于阈值时,系统自动触发人工审核流程,避免执行错误的操作;同时我们可以通过优化元数据描述、增加结果校验逻辑来提高aia_iai的值,进而提升整体成功率。

4.2 步骤一:微服务的自然语言封装

我们不需要改造任何现有微服务的业务逻辑,只需要给接口的OpenAPI Schema增加自然语言标注,就能把接口转换成智能体可以识别的「工具」。

4.2.1 元数据标注规范

我们基于OpenAPI 3.0规范做扩展,增加x-llm-*开头的自定义字段,用来告诉大模型这个接口的业务含义、参数要求、使用场景:

| 扩展字段 | 用途 | 示例 |

|---|---|---|

| x-llm-function-name | 智能体调用的工具名称,用英文下划线命名 | get_unpaid_orders |

| x-llm-description | 接口功能的自然语言描述,越详细越好,要说明适用场景、返回值含义 | 查询指定用户的未支付订单,返回订单ID、金额、创建时间,用于催付、统计未支付金额等场景 |

| x-llm-parameter-description | 每个参数的自然语言描述,说明参数的约束、取值范围 | user_id: 要查询的用户ID,必须是数字类型;status: 订单状态,可选值为paid/unpaid/all |

| x-llm-scenario | 接口适用的场景,帮助大模型更准确匹配需求 | ["用户催付", "未支付订单统计", "订单对账"] |

我们拿订单服务的getOrderList接口做示例,扩展后的OpenAPI Schema如下: |

openapi: 3.0.0

paths:

/api/order/list:

get:

summary: 查询订单列表

x-llm-function-name: get_order_list

x-llm-description: 查询指定用户的订单列表,支持按状态筛选,返回订单ID、金额、创建时间、商品信息,可用于订单查询、统计、催付等场景

x-llm-scenario: ["订单查询", "未支付订单统计", "用户催付"]

parameters:

- name: user_id

in: query

required: true

schema:

type: integer

x-llm-parameter-description: 要查询的用户ID,必须是正整数,如果用户没有提供需要主动询问

- name: status

in: query

required: false

schema:

type: string

enum: [paid, unpaid, all]

x-llm-parameter-description: 订单状态,默认是all,查询未支付订单时传unpaid,查询已支付订单传paid

responses:

'200':

description: 成功返回订单列表

content:

application/json:

schema:

type: object

properties:

code:

type: integer

data:

type: array

items:

type: object

properties:

order_id:

type: string

amount:

type: number

create_time:

type: string

4.2.2 自动转换为智能体工具

我们可以写一个简单的解析脚本,自动把所有微服务的OpenAPI Schema转换成LangChain的Tool对象,不需要手动写工具定义:

from langchain.tools import Tool

import requests

import json

from typing import List, Dict

def openapi_to_tools(openapi_url: str) -> List[Tool]:

"""

从OpenAPI接口地址自动生成智能体可用的工具列表

:param openapi_url: 微服务的OpenAPI Schema地址,比如http://order-service/api/v3/api-docs

:return: LangChain Tool列表

"""

# 拉取OpenAPI Schema

response = requests.get(openapi_url)

openapi_schema = response.json()

tools = []

for path, path_info in openapi_schema['paths'].items():

for method, method_info in path_info.items():

# 跳过没有标注llm扩展字段的接口

if 'x-llm-function-name' not in method_info:

continue

function_name = method_info['x-llm-function-name']

function_desc = method_info['x-llm-description']

# 生成工具调用函数

def tool_func(**kwargs):

# 拼接请求URL

base_url = openapi_url.split('/api/')[0]

url = f"{base_url}{path}"

# 处理参数

params = kwargs

# 透传鉴权Token,从当前请求的上下文里获取

headers = {"Authorization": kwargs.pop('authorization', '')}

# 发送请求

if method.lower() == 'get':

resp = requests.get(url, params=params, headers=headers, timeout=10)

else:

resp = requests.request(method, url, json=params, headers=headers, timeout=10)

return resp.json()

# 生成工具的参数描述,给大模型看

parameters_desc = ""

for param in method_info.get('parameters', []):

if 'x-llm-parameter-description' in param:

parameters_desc += f"{param['name']}: {param['x-llm-parameter-description']},{'必填' if param.get('required') else '可选'}\n"

tool = Tool(

name=function_name,

func=tool_func,

description=f"{function_desc}\n参数说明:\n{parameters_desc}"

)

tools.append(tool)

return tools

# 示例:拉取订单、用户、短信三个服务的工具

order_tools = openapi_to_tools("http://localhost:8001/api/v3/api-docs")

user_tools = openapi_to_tools("http://localhost:8002/api/v3/api-docs")

sms_tools = openapi_to_tools("http://localhost:8003/api/v3/api-docs")

all_tools = order_tools + user_tools + sms_tools

这个脚本会自动遍历所有微服务的OpenAPI接口,把标注了x-llm-*字段的接口转换成智能体可以调用的工具,新增/修改接口的时候只需要更新OpenAPI标注即可,不需要修改网关代码,完美实现了和现有微服务的解耦。

4.3 步骤二:智能编排引擎实现

编排引擎是智能体网关的核心,负责根据用户的自然语言需求生成执行计划、调用工具、处理错误、汇总结果。

4.3.1 编排流程设计

我们的编排流程采用「规划-执行-校验-反思」的循环逻辑,流程图如下:

4.3.2 核心代码实现

我们基于LangChain的ReActAgent来实现编排引擎,同时加入自定义的计划校验、错误处理逻辑:

from langchain_openai import ChatOpenAI

from langchain.agents import AgentExecutor, create_react_agent

from langchain.memory import ConversationBufferMemory

from langchain.prompts import PromptTemplate

from pydantic import BaseModel

from typing import Optional

# 1. 初始化大语言模型,选择支持Function Call的模型即可

llm = ChatOpenAI(

model="gpt-3.5-turbo",

temperature=0, # 温度设为0,减少生成的随机性,提高准确率

api_key="你的OpenAI API Key",

base_url="你的API Base地址(如有)"

)

# 2. 初始化上下文记忆,存储用户的历史对话

memory = ConversationBufferMemory(memory_key="chat_history", return_messages=True)

# 3. 自定义Prompt模板,告诉大模型怎么编排、怎么处理错误

prompt = PromptTemplate.from_template("""

你是一个智能服务编排助手,负责根据用户的需求调用对应的工具完成任务,请严格遵守以下规则:

1. 你只能使用提供的工具,不能编造不存在的工具;

2. 调用工具前必须确认所有必填参数都已经获取,如果参数缺失必须主动询问用户补充;

3. 调用工具返回错误时,先检查参数是否正确,最多重试2次,重试失败则告诉用户错误原因;

4. 执行完所有步骤后,把结果汇总成通俗易懂的自然语言返回给用户,不要返回原始的接口响应数据;

5. 高风险操作(比如发送短信、发放优惠券、删除数据)必须先跟用户确认后再执行。

可用工具列表:

{tools}

聊天历史:

{chat_history}

用户需求:{input}

思考过程:{agent_scratchpad}

""")

# 4. 创建智能体

agent = create_react_agent(llm, all_tools, prompt)

agent_executor = AgentExecutor(

agent=agent,

tools=all_tools,

memory=memory,

verbose=True, # 开启日志,方便调试

max_iterations=10, # 最多执行10步,避免死循环

handle_parsing_errors=True # 自动处理解析错误

)

# 5. 封装网关接口,提供对外服务

class GatewayRequest(BaseModel):

query: str

authorization: Optional[str] = None # 透传用户的鉴权Token

async def gateway_handler(request: GatewayRequest):

try:

# 把鉴权Token放到工具的上下文里

for tool in all_tools:

tool.func.__defaults__ = (request.authorization,) + (tool.func.__defaults__ or ())

# 执行智能体编排

result = agent_executor.invoke({"input": request.query})

return {

"code": 200,

"data": result['output'],

"trace_id": "生成唯一的Trace ID,用于排查问题"

}

except Exception as e:

return {

"code": 500,

"msg": f"请求处理失败:{str(e)}",

"trace_id": "xxx"

}

4.3.3 效果测试

我们现在测试一个典型的需求:「帮我查询用户ID为123的所有未支付订单,计算总金额,然后给用户发个催付短信,内容里包含总金额」。

智能体的执行过程如下:

- 识别需求需要三个步骤:查询未支付订单、计算总金额、发送短信;

- 调用

get_order_list工具,参数user_id=123、status=unpaid,返回订单列表; - 自动计算所有订单的总金额,比如总金额是299元;

- 调用

send_sms工具,参数user_id=123、content="您有299元的未支付订单,请尽快支付哦~"; - 汇总结果返回给用户:「已完成操作:查询到用户123共有3笔未支付订单,总金额299元,已发送催付短信」。

整个过程不需要任何人工编码,大模型自动完成所有编排,整个响应时间在1秒左右。

4.4 步骤三:传统网关能力复用

我们不能为了加智能能力就丢掉传统网关的核心能力,接下来我们把鉴权、限流、日志这些能力集成到智能网关里。

4.4.1 接入层实现

我们用FastAPI做接入层,集成常用的网关能力:

from fastapi import FastAPI, Request, HTTPException

from slowapi import Limiter, _rate_limit_exceeded_handler

from slowapi.util import get_remote_address

from slowapi.errors import RateLimitExceeded

import jwt

import time

import logging

# 初始化FastAPI应用

app = FastAPI(title="智能体API网关")

# 1. 集成限流能力,限制每个IP每分钟最多调用100次

limiter = Limiter(key_func=get_remote_address)

app.state.limiter = limiter

app.add_exception_handler(RateLimitExceeded, _rate_limit_exceeded_handler)

# 2. 日志配置

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

# 3. 鉴权中间件

@app.middleware("http")

async def auth_middleware(request: Request, call_next):

start_time = time.time()

# 跳过不需要鉴权的接口

if request.url.path == "/health":

return await call_next(request)

# 校验Token

token = request.headers.get("Authorization", "").replace("Bearer ", "")

try:

# 这里替换成你们公司的JWT校验逻辑

payload = jwt.decode(token, "your_jwt_secret", algorithms=["HS256"])

request.state.user_id = payload["user_id"]

request.state.role = payload["role"]

except Exception as e:

raise HTTPException(status_code=401, detail="无效的Token")

# 记录请求日志

response = await call_next(request)

process_time = time.time() - start_time

logger.info(f"请求路径:{request.url.path},用户ID:{request.state.user_id},耗时:{process_time}ms,状态码:{response.status_code}")

return response

# 4. 智能网关接口

@app.post("/api/gateway/chat")

@limiter.limit("100/minute")

async def chat_gateway(request: Request, gateway_request: GatewayRequest):

# 把用户ID和角色放到上下文里,供工具调用时做权限校验

gateway_request.authorization = request.headers.get("Authorization")

return await gateway_handler(gateway_request)

# 5. 健康检查接口

@app.get("/health")

async def health_check():

return {"status": "ok"}

4.4.2 权限控制

我们还可以给每个工具加权限校验,比如发送短信的工具只有运营角色才能调用,只需要在元数据里加x-llm-required-role字段,然后在工具调用前做校验即可:

# 在openapi_to_tools函数里增加权限校验逻辑

def tool_func(**kwargs):

# 先校验用户角色是否有权限调用这个工具

required_role = method_info.get('x-llm-required-role')

user_role = kwargs.get('user_role')

if required_role and user_role != required_role:

return {"code": 403, "msg": "你没有权限调用这个接口"}

# 后续调用逻辑不变

...

4.5 步骤四:优化与生产适配

要把这个网关用到生产环境,我们还要解决几个核心问题:

4.5.1 解决大模型幻觉问题

大模型可能会编造不存在的工具或者参数,我们可以通过三个手段解决:

- 严格的工具匹配校验:大模型生成的工具调用请求必须是我们注册过的工具,参数必须符合元数据的定义,不符合直接拒绝;

- RAG增强:把所有微服务的接口文档、使用示例导入到向量数据库,大模型生成计划前先检索相关文档,提高准确率;

- Bad Case迭代:把所有调用失败的case收集起来,优化Prompt和元数据描述,持续迭代提升准确率。

4.5.2 性能优化

智能体的延迟是大家最关心的问题,我们可以通过几个手段降低延迟:

- 常用计划缓存:把高频使用的需求对应的执行计划缓存起来,比如「查询用户未支付订单并催付」这个需求每天有上万人用,我们直接用缓存的计划,不需要每次让大模型生成,延迟可以降低80%;

- 小模型前置处理:用小模型做意图识别、参数提取,只有复杂的编排需求才调用大模型,降低成本和延迟;

- 异步执行:对于不需要实时返回结果的需求(比如给1000个用户发优惠券),智能体生成计划后直接返回任务ID,后台异步执行,用户可以后续查询任务状态。

4.5.3 可观测性建设

我们需要给智能网关加完善的监控和日志:

- 记录每个请求的自然语言输入、生成的执行计划、每个工具的调用结果、耗时、错误信息;

- 监控大模型的调用次数、准确率、延迟、成本;

- 监控微服务的调用成功率、耗时,出现异常及时告警。

5. 进阶探讨

5.1 长流程编排与人工确认

对于需要多步骤、高风险的编排流程,我们可以增加人工确认节点,比如大模型生成执行计划后,先把计划展示给用户,用户确认后再执行,比如:

用户:「给所有上个月消费满1000的用户发10元优惠券」

网关:「本次操作将查询上个月消费满1000的用户(预估2300人),每人发放10元优惠券,总成本23000元,是否确认执行?」

用户:「确认」

网关:「开始执行…已完成,共发放2300张优惠券,发送短信2300条」

5.2 混合编排模式

我们支持自然语言和结构化配置混合的编排模式,对于固定的流程可以提前配置好编排模板,大模型只需要填充参数即可,既保证灵活性又保证准确性,比如提前配置「催付流程」的模板,大模型只需要提取用户ID参数即可执行,不需要每次生成计划。

5.3 多租户支持

我们可以给每个租户配置独立的工具列表、权限、Prompt,实现多租户隔离,SaaS厂商可以给不同的客户提供不同的智能编排能力。

6. 行业发展与趋势

我们来看微服务编排的发展历程:

| 时间阶段 | 架构模式 | 核心诉求 | 编排方式 | 痛点 |

|---|---|---|---|---|

| 2000-2010 | 单体应用 | 功能实现 | 代码硬编码,所有逻辑耦合在单体中 | 迭代慢,扩展性差 |

| 2010-2018 | 微服务架构 | 服务解耦,独立迭代 | 前端/业务层手动调用多个接口,硬编码编排逻辑 | 对接成本高,编排逻辑分散,迭代效率低 |

| 2018-2022 | 传统API网关+低代码编排平台 | 统一入口,降低编排门槛 | 可视化配置编排流程,拖拽生成逻辑 | 仍需技术人员配置,无法快速响应灵活的业务需求,不支持自然语言交互 |

| 2022-至今 | 智能体API网关 | 服务智能化,零代码编排 | 大模型自动理解需求,生成编排计划,自动执行 | 处于早期落地阶段,需解决准确性、安全性、性能问题 |

| 未来3年,智能体API网关会成为微服务架构的标准组件,80%以上的企业内部业务需求都可以通过自然语言直接完成,开发人员只需要关注核心业务逻辑的实现,不需要再写大量的编排代码。 |

7. 总结

回顾要点

本文我们从传统微服务编排的痛点出发,完整讲解了智能体API网关的架构设计与实现:

- 智能体API网关是传统API网关和大语言模型智能体的结合,既保留了传统网关的核心能力,又增加了自然语言理解、自动编排的能力;

- 不需要改造现有微服务,只需要给OpenAPI Schema加自然语言标注,就能把接口转换成智能体可调用的工具;

- 基于ReAct智能体实现编排引擎,支持多步骤调用、错误重试、参数补全;

- 集成鉴权、限流、日志能力,通过缓存、小模型前置等优化手段达到生产可用标准。

成果展示

通过这个方案,我们可以把微服务的编排效率提升10倍以上,对接成本降低80%,非技术人员也可以直接使用微服务的能力,真正实现「业务需求自助化」。

展望

智能体API网关是传统系统智能化升级的最低成本路径,不需要重构现有架构,只需要加一个网关层就能让整个系统支持对话式交互,未来会有越来越多的企业采用这个架构,我们也会看到更多基于这个架构的创新应用出现。

8. 行动号召

如果你对这个方案感兴趣,可以按照本文的步骤自己搭一个最小原型,用你公司的现有微服务做测试,体验一下自然语言编排的效率提升。如果你在实践中遇到任何问题,或者想要完整的源码,欢迎在评论区留言讨论,我会一一回复~

如果本文对你有帮助,欢迎点赞、收藏、转发给更多的朋友,我们一起探索AI时代的架构创新!

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)