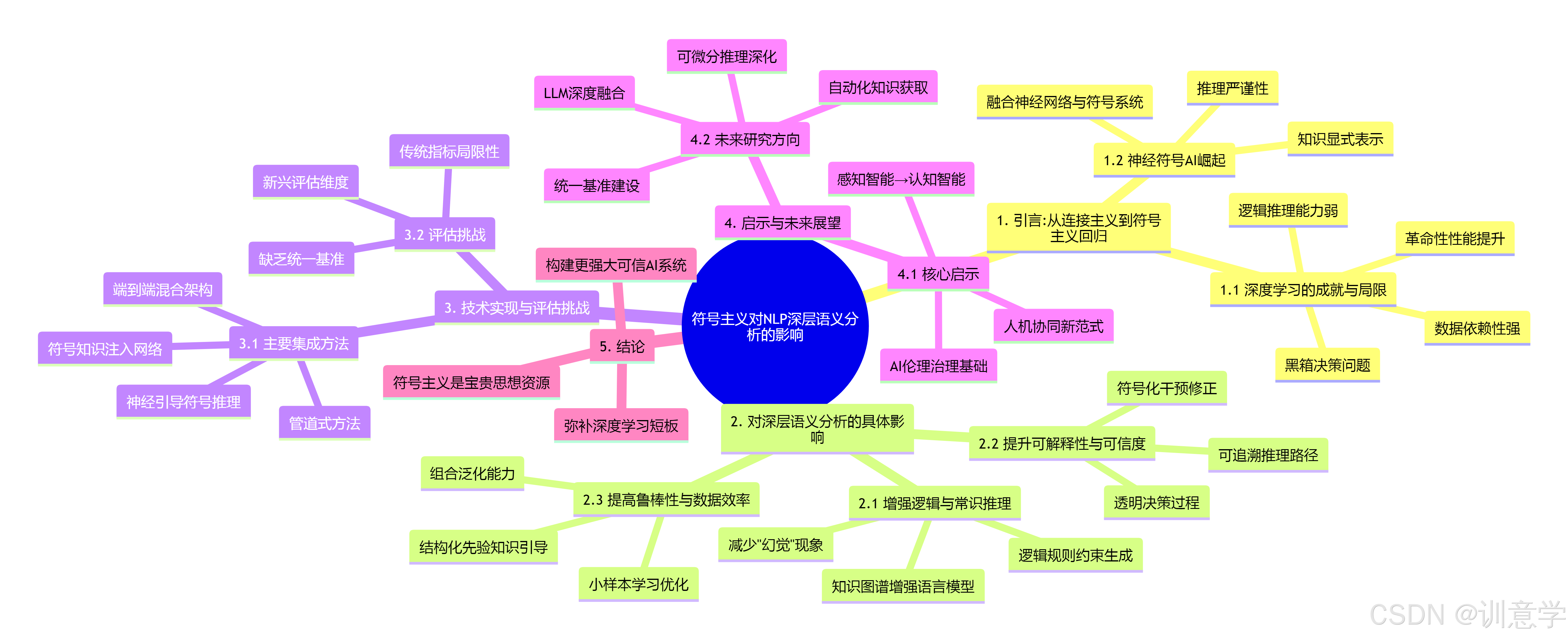

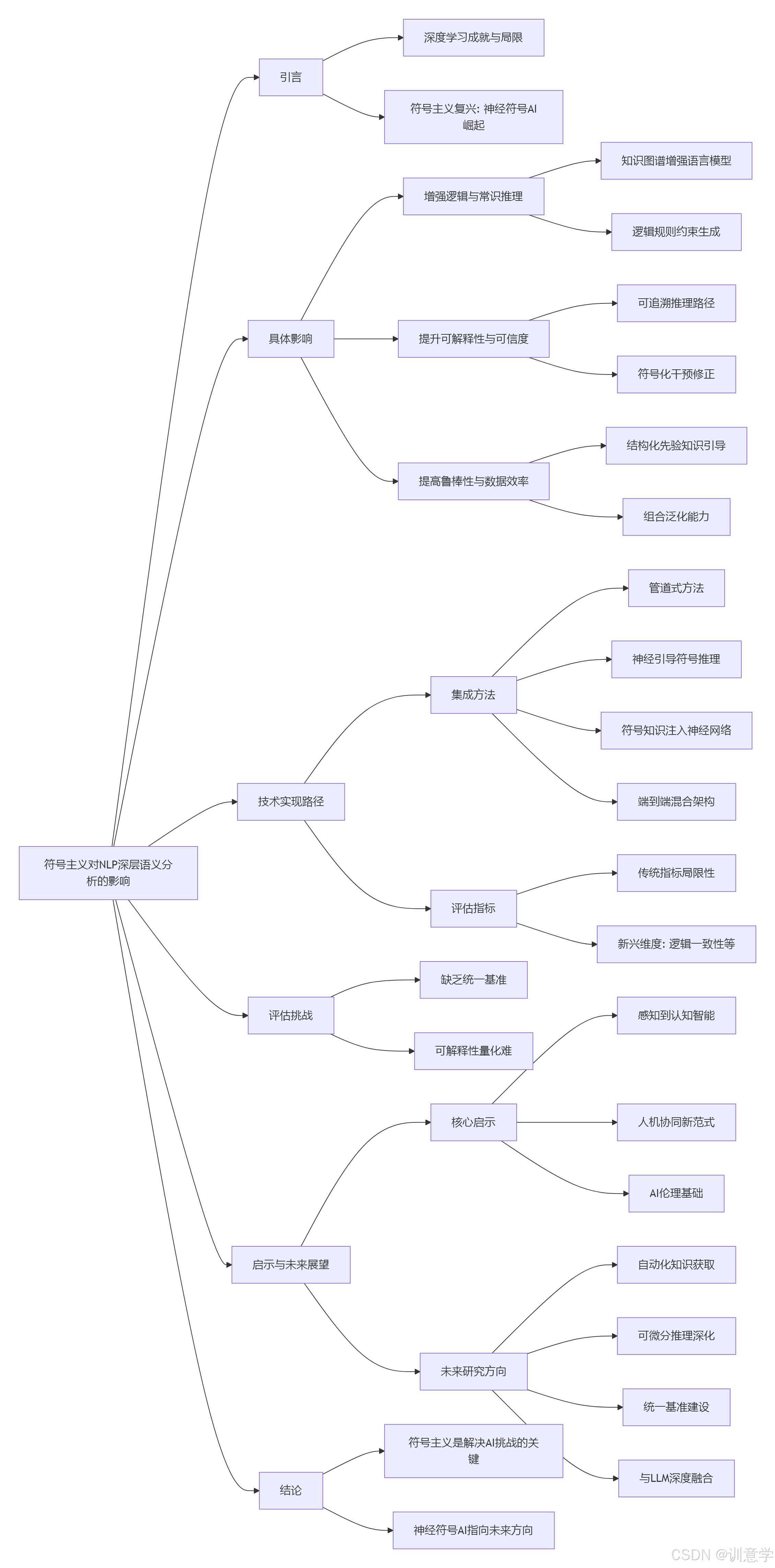

符号主义对人工智能自然语言处理中深层语义分析的影响与启示

摘要:随着深度学习在NLP领域取得巨大成功,大型语言模型(LLMs)等连接主义方法成为主流,但其在逻辑推理、可解释性等方面的固有缺陷日益凸显。在此背景下,符号主义以神经符号人工智能(Neuro-Symbolic AI)的新形态回归,旨在融合神经网络的感知能力与符号系统的推理能力。本报告探讨符号主义对NLP深层语义分析的影响,分析其如何通过增强逻辑推理、提升可解释性、提高鲁棒性等弥补现有技术不足,并

摘要

随着深度学习在自然语言处理(NLP)领域取得巨大成功,以大型语言模型(LLMs)为代表的连接主义方法已成为主流。然而,这些模型在逻辑推理、可解释性、常识运用和事实一致性方面的固有缺陷也日益凸显 。在此背景下,作为人工智能的经典范式,符号主义(Symbolic AI)正以一种新的融合形态——神经符号人工智能(Neuro-Symbolic AI)——重新回到学术界和工业界的视野中心 。本报告旨在深入探讨符号主义对NLP深层语义分析的影响,分析其如何弥补现有技术的不足,并展望其未来的发展方向与启示。

1. 引言:从连接主义的辉煌到符号主义的回归

1.1. 深度学习在NLP中的成就与局限

过去十年,以Transformer架构为基础的预训练语言模型(如BERT、GPT系列)彻底改变了自然语言处理领域 。这些模型通过在海量文本数据上进行自监督学习,能够捕捉语言的复杂统计规律,在机器翻译、文本生成、情感分析等诸多任务上取得了前所未有的性能 。这种依赖神经网络和数据驱动的方法被称为“连接主义”或“子符号主义”。

然而,它们的成功也伴随着明显的局限性。首先,这些模型本质上是复杂的模式匹配器,缺乏真正的逻辑推理能力,难以处理需要多步推导或依赖结构化知识的复杂问题 。其次,它们的决策过程如同一个“黑箱”,缺乏透明度和可解释性,这在金融、医疗、法律等高风险领域是致命的弱点 。最后,它们对数据质量和数量高度依赖,容易受数据偏见影响,并且在处理分布外(out-of-distribution)样本时表现脆弱,泛化能力有限 。

1.2. 符号主义的复兴:神经符号AI的崛起

符号主义是人工智能的奠基范式之一,其核心思想是智能源于对符号的操作和逻辑推理 。在其发展的早期阶段(约20世纪50至80年代),符号主义通过专家系统、知识表示(如语义网络、本体论)和逻辑编程在NLP领域留下了深刻的印记,例如SHRDLU系统 。尽管纯符号主义方法因其规则的僵化和对语言模糊性处理的困难而一度式微 但其核心思想——知识的显式表示与推理的严谨性——正是当前深度学习模型所欠缺的。

为了融合两大范式的优点,神经符号人工智能(Neuro-Symbolic AI, NSAI)应运而生。NSAI旨在将神经网络强大的感知和学习能力与符号系统清晰的知识表示和逻辑推理能力相结合,构建更强大、更可靠、更可解释的AI系统 。这标志着符号主义不再是历史的尘埃,而是推动下一代NLP技术发展的关键力量。

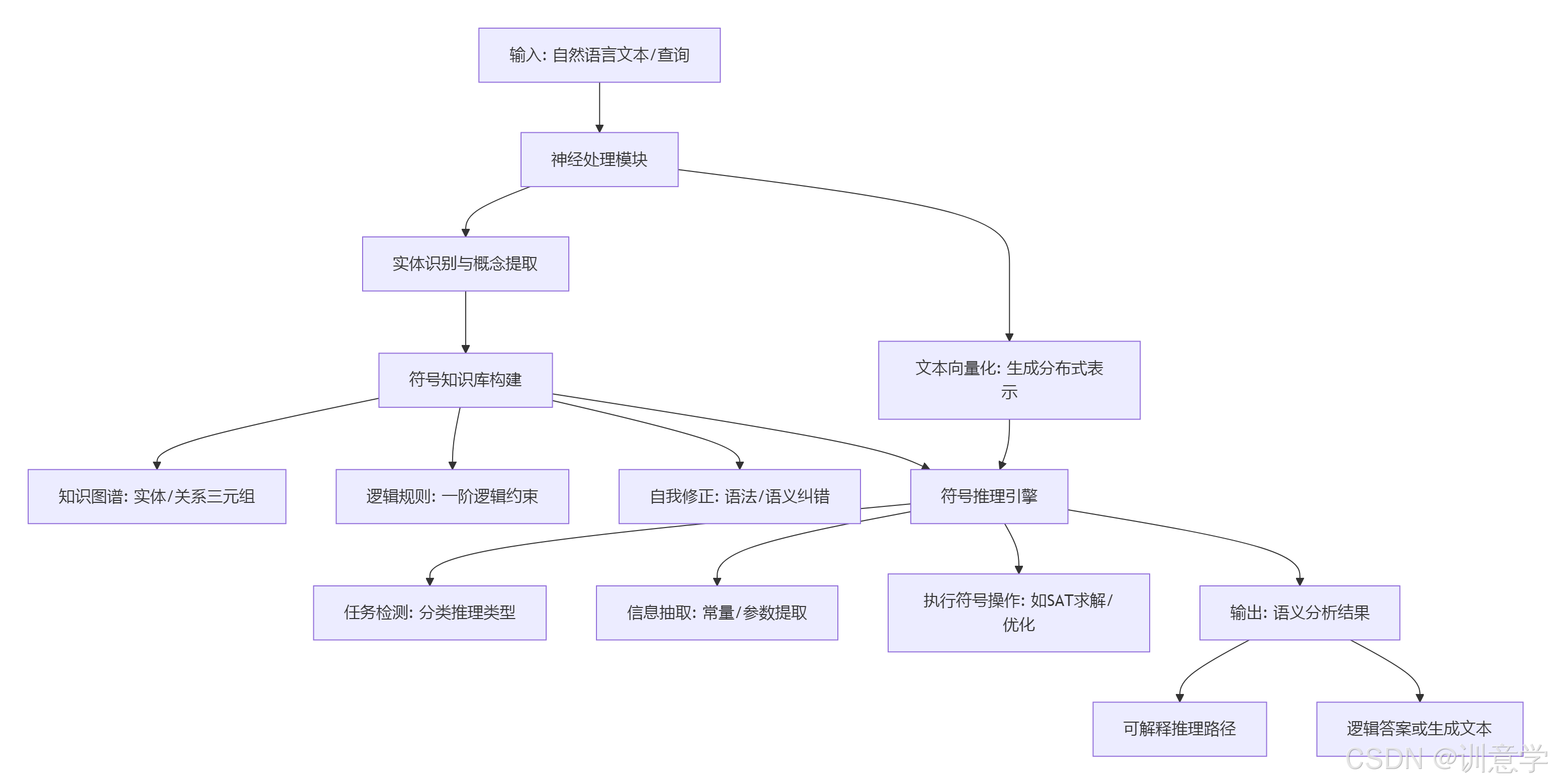

2. 符号主义对深层语义分析的具体影响

深层语义分析不仅要求模型理解字面含义,更要求其掌握句子背后的逻辑关系、常识背景和语用推理。符号主义通过与深度学习模型的集成,从以下几个核心方面显著增强了NLP系统的深层语义分析能力。

2.1. 增强逻辑与常识推理能力

当前的大型语言模型在回答需要事实性知识和逻辑推理的问题时,常常出现“幻觉”(hallucination)或事实性错误。这是因为它们的知识存储在隐式的网络权重中,难以进行精确、可靠的推理。

符号主义通过引入显式的知识结构(如知识图谱、本体论)和推理引擎,为此提供了解决方案 。具体实现方式包括:

- 知识图谱增强的语言模型: 将知识图谱中的实体和关系作为外部知识源,注入到语言模型的表示学习中。模型在进行语义理解时,可以直接查询和利用这些结构化的事实信息,从而提高问答、关系抽取等任务的准确性 。例如,回答“发现镭的科学家的丈夫是谁?”这类问题时,模型不再仅仅依赖文本共现,而是可以通过知识图谱中“居里夫人 -> 发现 -> 镭”和“居里夫人 -> 配偶 -> 皮埃尔·居里”这样的路径进行精确推理。

- 逻辑规则约束的生成与理解: 将一阶逻辑、时序逻辑或常识性规则嵌入到神经网络的训练或推理过程中 。这可以确保模型生成的内容在逻辑上是一致的,或者在理解文本时能够识别出不合逻辑的部分。符号推理在需要深层次语言理解、逻辑一致性和上下文推理的任务中至关重要 。

2.2. 提升模型的可解释性与可信度

可解释性是实现可信AI(Trustworthy AI)的基石。符号主义的引入,为“黑箱”般的神经网络打开了一扇窗。

- 可追溯的推理路径: 当一个神经符号系统做出决策时,其符号部分可以提供一个清晰、人类可读的推理链条 。例如,在一个医疗诊断系统中,模型不仅给出“患者可能患有某种疾病”的结论,还能展示其依据的规则:“因为患者[症状A]和[检查结果B],根据[医学指南规则C],所以推断出此结论”。这种透明度对于建立用户信任和进行错误分析至关重要 。

- 符号化干预与修正: 通过显式的符号表示,开发者和领域专家可以更容易地审查、修正甚至直接编辑模型的“知识库”或“规则集”,从而快速修复模型的缺陷,而无需重新进行代价高昂的大规模训练。

2.3. 提高模型的鲁棒性与数据效率

深度学习模型通常需要海量数据才能学习到有效的模式,并且容易学习到数据集中的虚假相关性(spurious correlations)。

- 结构化先验知识引导学习: 符号知识为模型提供了关于世界如何运作的强大先验。这种结构化的知识可以引导神经网络学习更具泛化能力的特征,减少对数据的依赖,从而在小样本学习(few-shot learning)场景下表现更佳 。

- 组合泛化(Compositional Generalization): 人类语言具有强大的组合性,我们可以理解和创造从未见过的句子。符号系统天然擅长处理这种组合结构。神经符号模型通过学习原子概念的符号表示,并依据规则将它们组合起来,能够更好地泛化到新的、更复杂的语言结构中,提高了模型的系统性泛化能力 。

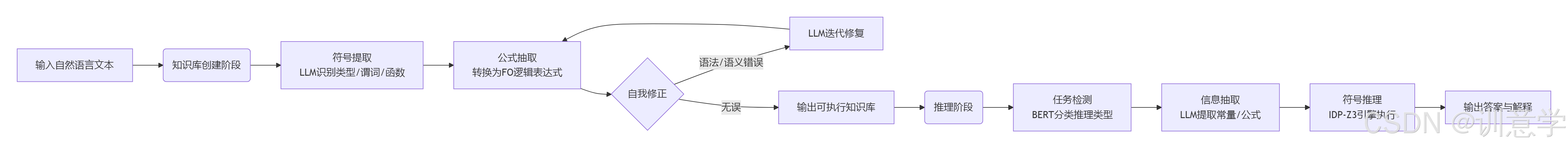

3. 技术实现路径与评估挑战

将符号主义与深度学习模型集成并非易事,目前学界已探索出多种技术路径。

3.1. 主要的集成方法

根据符号与神经组件的耦合紧密程度,集成方法大致可分为:

- 管道式(Pipeline)方法: 神经模块(如实体识别)的输出作为符号模块(如逻辑推理器)的输入,二者串行工作。这种方法实现简单,但可能存在误差累积问题 。

- 神经模块引导符号推理: 神经网络用于学习符号规则或在庞大的符号空间中进行启发式搜索,以提高传统符号推理器的效率。

- 符号知识注入神经网络: 这是目前最主流的方向。通过各种技术将符号知识(如图结构、逻辑约束)编码到神经网络的架构、损失函数或输入表示中。例如,逻辑张量网络(Logic Tensor Networks, LTN)尝试将模糊逻辑进行可微化,使其能与梯度下降算法无缝集成 。

- 端到端混合架构: 设计统一的神经符号架构,其中包含负责感知的神经层和负责抽象推理的符号层,两者共同训练,协同工作 。

3.2. 评估指标与基准的挑战

如何科学地评估神经符号系统的性能是一个严峻的挑战。

- 传统NLP指标的局限性: 准确率(Accuracy)、F1分数、BLEU等传统指标可以衡量任务的最终表现,但无法评估推理过程的正确性或模型的可解释性 。

- 新兴的评估维度: 研究人员开始引入新的评估指标,如逻辑一致性(logical consistency)、推理速度(inference speed)、规则泛化能力(rule generalization)以及可解释性评分(interpretability score)等 。

- 缺乏统一基准: 当前神经符号领域极度缺乏标准化的基准数据集和评估协议,导致不同研究之间的成果难以公平比较,这严重阻碍了该领域的健康发展 。

尽管如此,一些初步的量化结果已经展示了神经符号方法的潜力。例如,有研究显示,混合系统在特定任务上的准确率(如95.1%)显著高于纯深度学习模型(88.2%)和纯符号AI系统(74.5%) 。在逻辑推理任务中,混合模型也展现出更高的准确率(89.4%)和一致性(96.5%) 。

4. 启示与未来展望

符号主义对NLP深层语义分析的影响远不止于技术层面的改进,它为人工智能的未来发展路径提供了深刻的启示。

4.1. 核心启示

- 从“感知智能”到“认知智能”: 深度学习解决了AI的感知问题,而符号主义是实现更高层次认知能力(如推理、规划、因果分析)的关键。两者的结合是通往通用人工智能(AGI)的必由之路。

- 人机协同的新范式: 可解释的神经符号系统使AI不再是一个决策的“黑盒”,而是一个可以与人类专家进行交互、解释其推理过程并接受反馈的合作伙伴,这在医疗、科研等领域具有革命性意义 。

- AI伦理与治理的基础: 通过将伦理准则和社会规范编码为可验证的符号规则,可以从根本上构建更公平、更负责任的AI系统,确保其行为符合人类价值观 。

4.2. 未来研究方向

展望未来,神经符号NLP领域的研究将聚焦于以下几个关键方向:

- 自动化知识获取与学习: 开发能够从非结构化文本中自动学习、构建和更新符号知识(如规则和知识图谱)的端到端模型,摆脱对人工构建知识库的依赖。

- 可微分推理的深化: 探索更强大、更高效的可微分逻辑和概率推理框架,使其能够处理更复杂的逻辑表达并扩展到大规模问题上。

- 统一基准与平台的建设: 学术界和产业界需要合作建立一套公认的、具有挑战性的基准测试集和开源平台,以推动该领域的可复现研究和公平比较 。

- 与大型语言模型的深度融合: 研究如何将符号推理能力更原生、更动态地集成到GPT-4等大型语言模型的内部结构中,而不是仅仅将其作为外部工具调用,以实现真正的“思考”能力。

5. 结论

符号主义并非过时的技术,而是在新时代背景下,解决当前人工智能核心挑战的宝贵思想资源。通过与深度学习的创新性融合,符号主义正在深刻地影响和重塑自然语言处理中的深层语义分析。它通过引入显式的知识表示和严谨的逻辑推理,有效弥补了主流深度学习模型在可解释性、鲁棒性和推理能力上的短板。尽管在集成方法和评估体系上仍面临诸多挑战,但神经符号AI所指明的方向——一个结合了数据驱动学习和知识驱动推理的未来——无疑是构建更强大、更可信、更接近人类智慧的AI系统的关键所在。

更多推荐

已为社区贡献34条内容

已为社区贡献34条内容

所有评论(0)