【大模型开发必备】使用FastAPI构建DeepSeek和Qwen聚合服务,全程干货,小白也能轻松学会!!

本文详细介绍了如何使用FastAPI框架构建大模型聚合服务,通过集成DeepSeek和Qwen两大主流大模型实现统一API调用。内容涵盖FastAPI框架优势、API Key获取、环境变量配置、依赖库安装及核心代码实现,帮助开发者高效构建自己的大语言模型服务,提升开发效率和应用灵活性。

前言

今天主要给大家介绍一下如何使用 FastAPI 集成 DeepSeek 和 Qwen 大模型服务。

01 FastAPI 简介

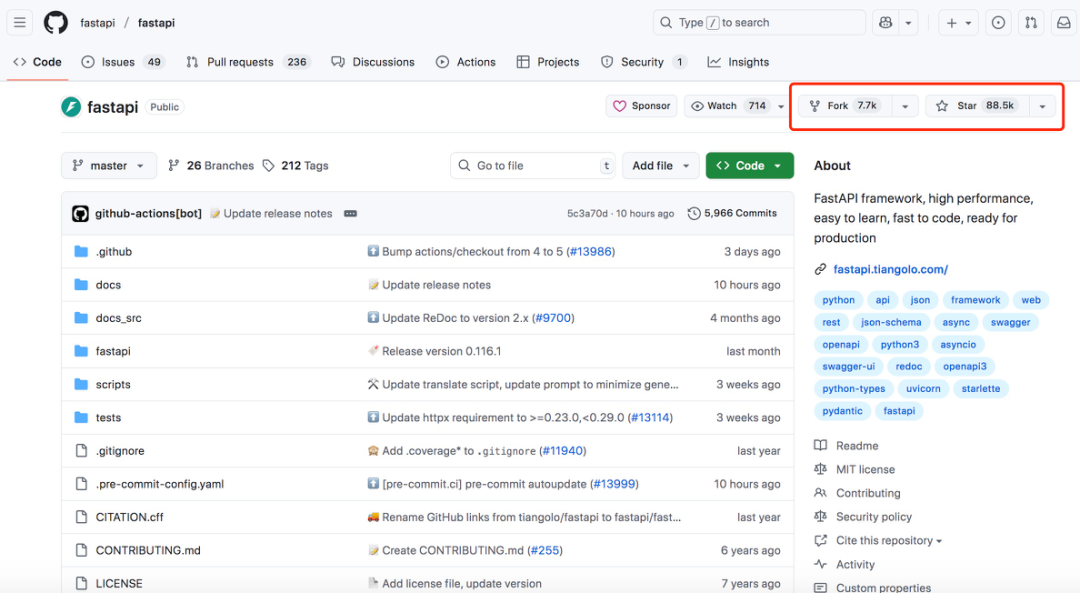

FastAPI 是一个用于构建 API 的现代、快速(高性能)的 web 框架,使用 Python 并基于标准的 Python 类型提示。

FastAPI 有如下关键特性:

- 快速:可与 NodeJS 和 Go 并肩的极高性能(归功于 Starlette 和 Pydantic)。最快的 Python web 框架之一。

- 高效编码:提高功能开发速度约 200% 至 300%。

- 更少 bug:减少约 40% 的人为(开发者)导致错误。

- 智能:极佳的编辑器支持。处处皆可自动补全,减少调试时间。

- 简单:设计的易于使用和学习,阅读文档的时间更短。

- 简短:使代码重复最小化。通过不同的参数声明实现丰富功能。bug 更少。

- 健壮:生产可用级别的代码。还有自动生成的交互式文档。

- 标准化:基于(并完全兼容)API 的相关开放标准:OpenAPI (以前被称为 Swagger) 和 JSON Schema。

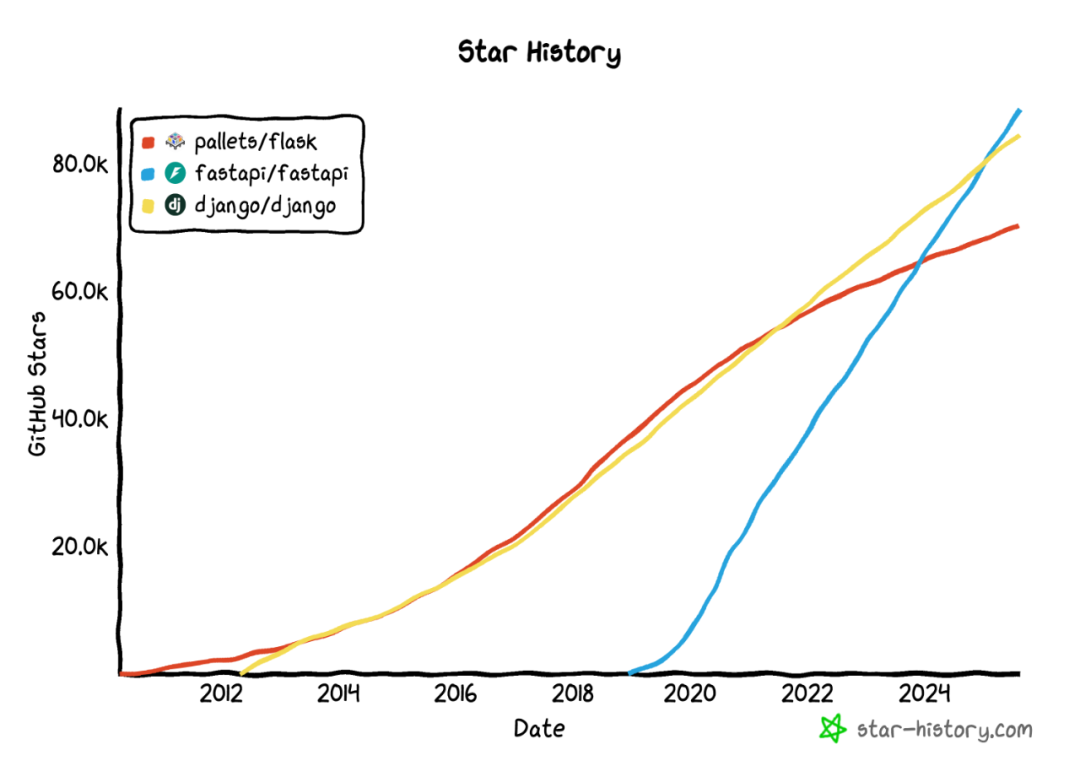

FastAPI 在 GitHub 的 Star 历史图上已超过老牌的 Python Web 框架(如:Flask、Django),而且还继续保持着良好的发展趋势。

02 使用 FastAPI 集成 DeepSeek 和 Qwen 大模型服务

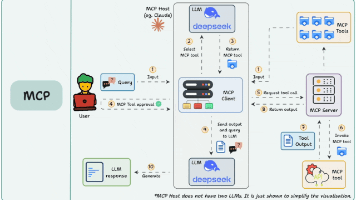

在实际开发工作中,我们的服务常常会遇到需要调用不同的大语言模型服务(如:DeepSeek、Qwen),我们可以使用 FastAPI 去集成那些大语言模型服务,将其做成大语言模型的聚合服务。

为方便起见,本文对接的是官网的 DeepSeek 和 Qwen 大模型服务。

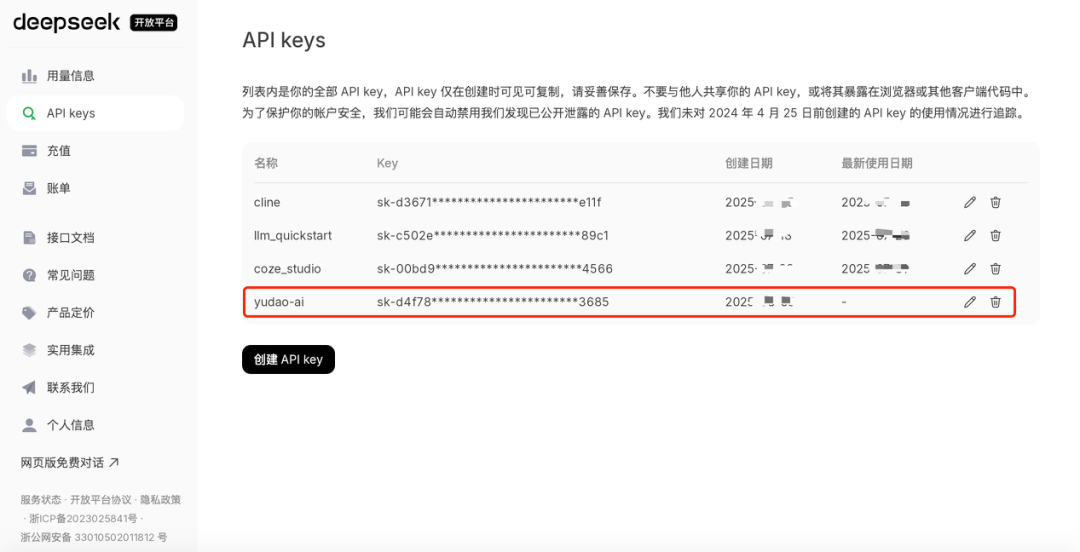

我们可以先到 DeepSeek 的开发平台去创建和获取 DeepSeek 的 API Key。

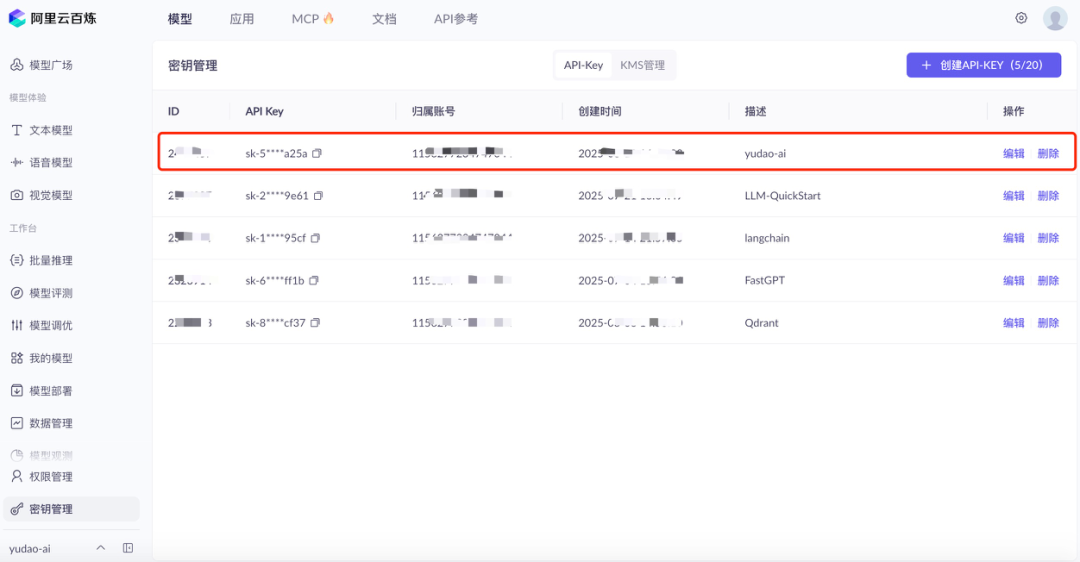

然后到阿里云百炼平台去创建和获取 Qwen 的 API Key。

依赖文件(requirements.txt):

fastapi==0.116.1

uvicorn==0.35.0

openai==1.100.1

dashscope==1.24.1

python-dotenv==1.1.1

Python 版本为 3.10 及以上。

安装依赖的 Python 库:

pip install -r requirements.txt

将 DeepSeek 和 Qwen 的相关信息配置到系统环境变量中。

# DeepSeek 配置

DEEPSEEK_API_KEY = "sk-your-deepseek-key"

DEEPSEEK_BASE_URL = "https://api.deepseek.com"

# Qwen 配置

DASHSCOPE_API_KEY = "sk-your-qwen-key"

DASHSCOPE_API_BASE_URL = "https://dashscope.aliyuncs.com/compatible-mode/v1"

主体代码(llm_app.py):

import os

import uvicorn

from fastapi import FastAPI, HTTPException

from pydantic import BaseModel

from dotenv import load_dotenv

from openai import OpenAI as DeepSeekClient

from dashscope import Generation as QwenClient

# 加载环境变量

load_dotenv()

app = FastAPI()

# 配置模型参数

MODEL_CONFIG = {

"deepseek": {

"client": DeepSeekClient(

api_key=os.getenv("DEEPSEEK_API_KEY"),

base_url=os.getenv("DEEPSEEK_BASE_URL")

),

"model_name": "deepseek-chat"

},

"qwen": {

"client": QwenClient,

"model_name": "qwen-plus"

}

}

# 统一请求格式(兼容OpenAI)

classChatRequest(BaseModel):

model: str # deepseek 或 qwen

messages: list

temperature: float = 0.7

max_tokens: int = 1024

# 统一响应格式

classChatResponse(BaseModel):

model: str

content: str

@app.post("/v1/chat")

asyncdefchat_completion(request: ChatRequest):

model_type = request.model.lower()

if model_type notin MODEL_CONFIG:

raise HTTPException(400, f"Unsupported model: {model_type}")

try:

if model_type == "deepseek":

response = MODEL_CONFIG["deepseek"]["client"].chat.completions.create(

model=MODEL_CONFIG["deepseek"]["model_name"],

messages=request.messages,

temperature=request.temperature,

max_tokens=request.max_tokens

)

content = response.choices[0].message.content

elif model_type == "qwen":

response = QwenClient.call(

model=MODEL_CONFIG["qwen"]["model_name"],

messages=request.messages,

temperature=request.temperature,

max_tokens=request.max_tokens,

result_format='message'

)

content = response.output.choices[0].message.content

return ChatResponse(model=model_type, content=content)

except Exception as e:

raise HTTPException(500, f"API Error: {str(e)}")

if __name__ == "__main__":

uvicorn.run(app, host="0.0.0.0", port=8090)

启动应用:

uvicorn llm_app:app --host 0.0.0.0 --port 8090 --workers 4

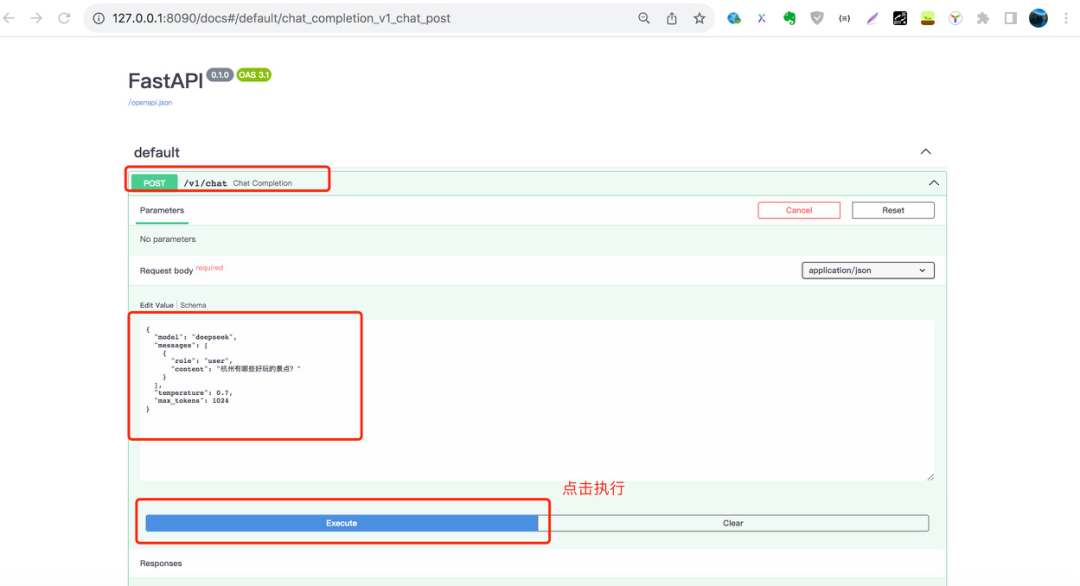

03 使用聚合服务

通过 API 接口调用聚合服务:

结语

相信你现在已经知道如何使用 FastAPI 集成大语言模型服务。建议你不妨亲自动手去实践,结合自己的需求去集成自己的大语言模型服务。

最后

为什么要学AI大模型

当下,⼈⼯智能市场迎来了爆发期,并逐渐进⼊以⼈⼯通⽤智能(AGI)为主导的新时代。企业纷纷官宣“ AI+ ”战略,为新兴技术⼈才创造丰富的就业机会,⼈才缺⼝将达 400 万!

DeepSeek问世以来,生成式AI和大模型技术爆发式增长,让很多岗位重新成了炙手可热的新星,岗位薪资远超很多后端岗位,在程序员中稳居前列。

与此同时AI与各行各业深度融合,飞速发展,成为炙手可热的新风口,企业非常需要了解AI、懂AI、会用AI的员工,纷纷开出高薪招聘AI大模型相关岗位。

最近很多程序员朋友都已经学习或者准备学习 AI 大模型,后台也经常会有小伙伴咨询学习路线和学习资料,我特别拜托北京清华大学学士和美国加州理工学院博士学位的鲁为民老师给大家这里给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料,这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

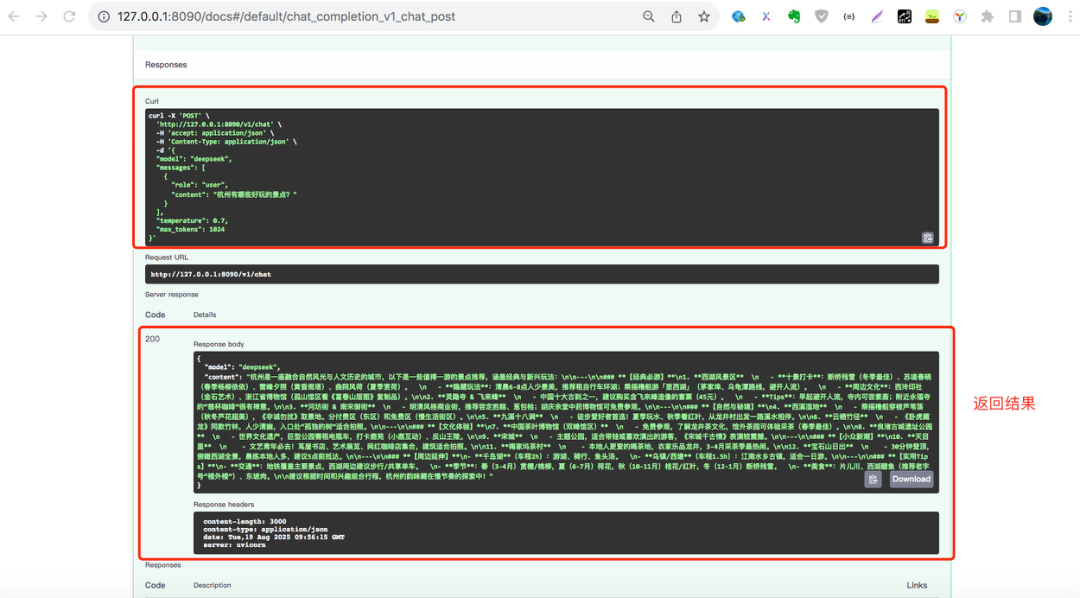

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)