2B小模型吊打7B大模型!视觉感知令牌:让多模态大模型自主控制视觉感知的突破技术

本文提出视觉感知令牌(VPT)概念,使多模态大语言模型能自主生成令牌触发和控制视觉感知动作。创新性地采用网格单元索引而非精确坐标描述区域,简化训练过程。设计区域选择和视觉重编码两种令牌,构建829k样本数据集训练。实验表明,引入VPT显著提升模型在空间推理和细粒度视觉问答任务上的性能,2B模型甚至超越7B模型,展现良好泛化能力。

创新点

- 提出了视觉感知令牌的概念,使 MLLM 能够自主生成这些令牌来触发和控制额外的视觉感知动作。这种设计类似于自然语言生成,但这些令牌并不对应自然语言中的具体单词或字符,而是专门用于触发视觉感知过程并传递控制信息。

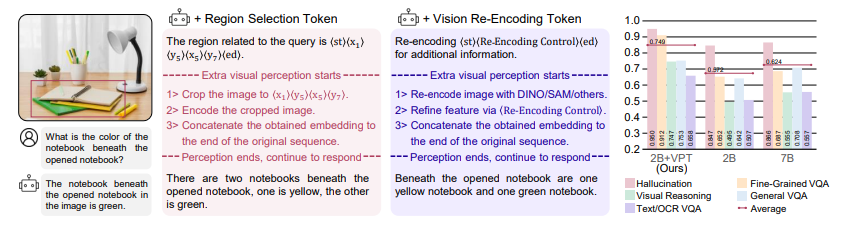

- 与以往直接使用精确像素坐标描述区域的方法不同,本文采用将图像划分为网格单元,并使用网格单元的索引来描述区域的近似位置。这种设计简化了训练过程,避免了 MLLM 在自然语言空间中生成有效边界框的困难。

方法

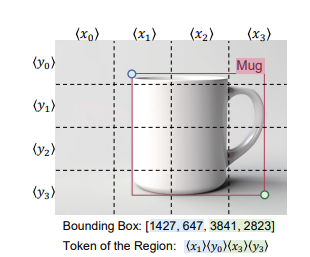

本文通过引入视觉感知令牌(Visual Perception Token)来增强多模态大语言模型(MLLM)自主控制视觉感知过程的能力。作者设计了两种令牌:区域选择令牌用于裁剪图像中的特定区域并重新编码,增强对关键区域的感知;视觉重编码令牌则通过额外的视觉编码器重新编码图像,并将特征与原始特征结合,实现对视觉感知的细粒度控制。为训练模型使用这些令牌,作者构建了包含829k样本的数据集,涵盖多种视觉问答任务。实验表明,引入视觉感知令牌显著提升了模型在空间推理和细粒度视觉问答等任务上的性能,2B模型甚至超越了7B模型。

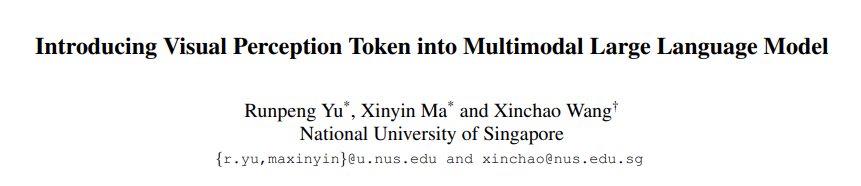

视觉感知令牌辅助 MLLM 的工作原理及性能表现

本图展示了配备视觉感知令牌的多模态大语言模型(MLLM)在视觉问答(VQA)任务中的响应过程。图中通过区域选择令牌(Region Selection Token)和视觉重编码令牌(Vision Re-Encoding Token)触发额外的视觉感知动作,如裁剪图像特定区域并重新编码,从而增强模型对视觉信息的理解和利用。b 则呈现了 2B 模型在引入视觉感知令牌后,在不同 VQA 任务上的平均性能表现,结果表明引入视觉感知令牌显著提升了模型性能,甚至超过了 7B 参数模型。

区域选择令牌与精确边界框的关系

本图展示了区域选择令牌如何描述图像中特定区域的位置。与精确的像素坐标边界框不同,区域选择令牌通过将图像划分为网格单元,并使用网格单元的索引来近似表示区域的位置。图中以 4×4 网格为例,说明了如何通过区域选择令牌标识出包含目标区域的网格单元,从而实现对目标区域的定位和裁剪,这种设计简化了训练过程,避免了 MLLM 在自然语言空间中生成有效边界框的困难。

视觉感知令牌生成及视觉感知过程控制示意图

本图详细描绘了视觉感知令牌在 MLLM 中的生成过程以及如何用于控制视觉感知过程。图中展示了标准的 MLLM 生成过程与引入视觉感知令牌后的生成过程对比。当 MLLM 输出区域选择令牌时,会根据令牌指示的区域裁剪图像并重新输入视觉编码器;当输出视觉重编码令牌时,会使用额外的视觉编码器(如 DINO)对图像进行重新编码,并通过投影器将得到的视觉特征与令牌的隐藏状态结合后输入到语言模型中。这种设计使 MLLM 能够自主控制视觉感知过程,提升对视觉信息的理解和利用效率。

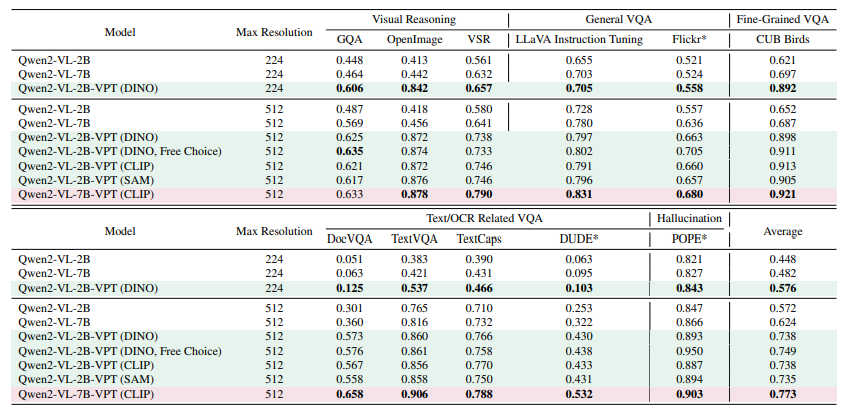

实验

本表展示了引入视觉感知令牌(VPT)后多模态大语言模型(MLLM)在视觉问答(VQA)任务上的性能提升。表格对比了基础的 2B 和 7B 模型(Qwen2-VL-2B 和 Qwen2-VL-7B)与引入 VPT 后的模型(Qwen2-VL-2B-VPT 和 Qwen2-VL-7B-VPT)在不同任务上的表现。结果显示,2B-VPT 模型在视觉推理和细粒度视觉问答任务上性能显著提升,甚至超过 7B 模型。例如,视觉推理任务中,2B-VPT 模型比 7B 模型高出 0.161;细粒度视觉问答任务中高出 0.207。此外,2B-VPT 模型在不同分辨率图像输入下均表现优异,低分辨率下平均提升 0.094,高分辨率下提升 0.084。在零样本设置下,2B-VPT 模型在未参与训练的测试集上也展现出良好的泛化能力,性能超过或匹配 7B 模型。

最后

为什么要学AI大模型

当下,⼈⼯智能市场迎来了爆发期,并逐渐进⼊以⼈⼯通⽤智能(AGI)为主导的新时代。企业纷纷官宣“ AI+ ”战略,为新兴技术⼈才创造丰富的就业机会,⼈才缺⼝将达 400 万!

DeepSeek问世以来,生成式AI和大模型技术爆发式增长,让很多岗位重新成了炙手可热的新星,岗位薪资远超很多后端岗位,在程序员中稳居前列。

与此同时AI与各行各业深度融合,飞速发展,成为炙手可热的新风口,企业非常需要了解AI、懂AI、会用AI的员工,纷纷开出高薪招聘AI大模型相关岗位。

最近很多程序员朋友都已经学习或者准备学习 AI 大模型,后台也经常会有小伙伴咨询学习路线和学习资料,我特别拜托北京清华大学学士和美国加州理工学院博士学位的鲁为民老师给大家这里给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料,这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献44条内容

已为社区贡献44条内容

所有评论(0)