OLLAMA+WebU|使用Snap在云服务器配置OLLAMA与WebUI

针对服务器配置OLLAMA速度慢,本文采取一种新的配置方式,并把端口映射到公网IP上,可以轻松实现OLLAMA+Open-WebUI的大模型部署

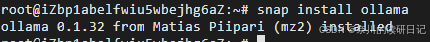

SNAP安装OLLAMA

查阅相关资料,基本上在linux安装OLLAMA的方法都是:

curl -fsSL https://ollama.com/install.sh | sh但尝试很多次,下载都有问题,apt的源也都是国内源,目前采用snap下载,快一些

snap install ollama

输入ollama --version检查安装情况,显示版本号后说明安装好了

OLLAMA网络配置

在以往的安装方法中,使用Curl会产生一个.service文件,但是使用Snap安装的OLLAMA不会有这个文件,需要手动配置服务

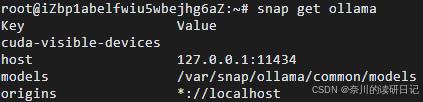

查看Snap中,OLLAMA相关的配置

snap get ollama

可以看到OLLAMA目前运行的host是在本地,修改host到0.0.0.0端口上

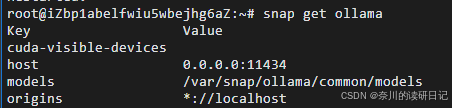

snap set ollama host=0.0.0.0:11434 snap restart ollama再次查看ollama的配置snap get ollama

目前已经映射到0.0.0.0的ip上,在自己电脑上用服务器公网ip访问,yourip:11434

拉取千问模型做测试,测试用,所以拉取小模型,想要更小的可以拉取:

ollama pull qwen:0.5b

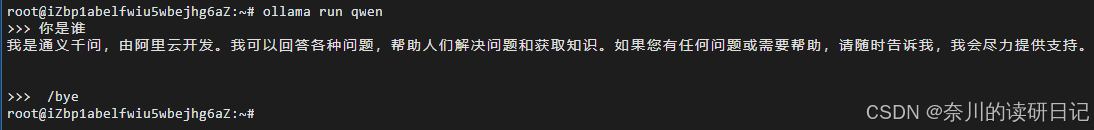

ollama pull qwen等待拉取后,运行模型

ollama run qwen想结束对话就输入”/bye“

这个时候OLLAMA的公网ip访问已经成功配置,下面配置WebUI链接到OLLAMA

这个帖子主要讲针对传统安装方式过慢,采用一个新的安装方式,使用教程大家自行搜索学习

Open-WebUI安装

Docker安装

Open-WebUI安装需要用到docker,安装教程:最详细的ubuntu 安装 docker教程 - 知乎 (zhihu.com)

WebUI安装

这个命令已经是国内源了,安装嘎嘎快,并配置了自动启动等等功能,以及端口映射,映射到3000端口,可通过公网IP访问

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.nju.edu.cn/open-webui/open-webui:main安装并运行好之后,在浏览器中输入:公网ip:3000

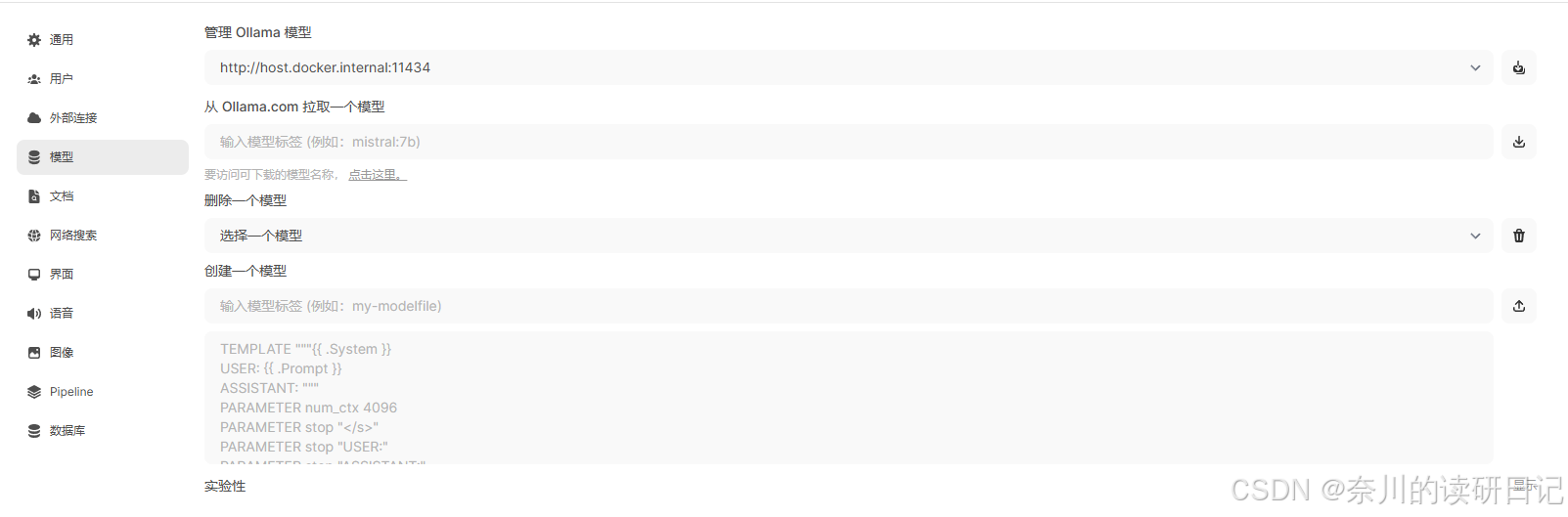

进行注册之后可进到WebUI页面,此时刚刚在OLLAMA中拉取的qwen模型已经可以在WebUI中使用

通过管理员面板可以看到OLLAMA的链接情况,到此完成整个Linux服务器配置

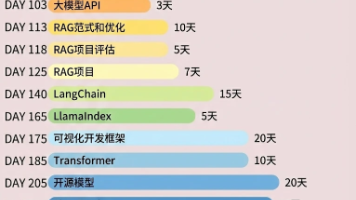

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)