收藏必备!AI大模型核心概念轻松入门,小白也能秒懂(附实例+比喻)

本文用大白话+比喻,梳理了LLM、Token、Prompt、Context等AI大模型常见术语,并解释了Memory、Function Calling、MCP等关键概念。文章还介绍了LangChain、Workflow、RAG、Embedding、Agent、Subagent、Skills等实用技术,最后提及了Temperature、幻觉、思维链、提示词工程、API、知识截止日期和多模态等细节。通

一聊 AI 就蹦出一串英文:LLM、token、prompt、context、agent、MCP、embedding、幻觉……听着头大对不对?别慌,其实都是人起的名字,搞清楚一次就不怕了。这篇把最常见的十几个词捋一遍,用大白话 + 一句话定义 + 一点小比喻,看完你也能跟人掰扯两句,顺便少踩点坑。

一、先搞清「谁在干活、怎么算钱」

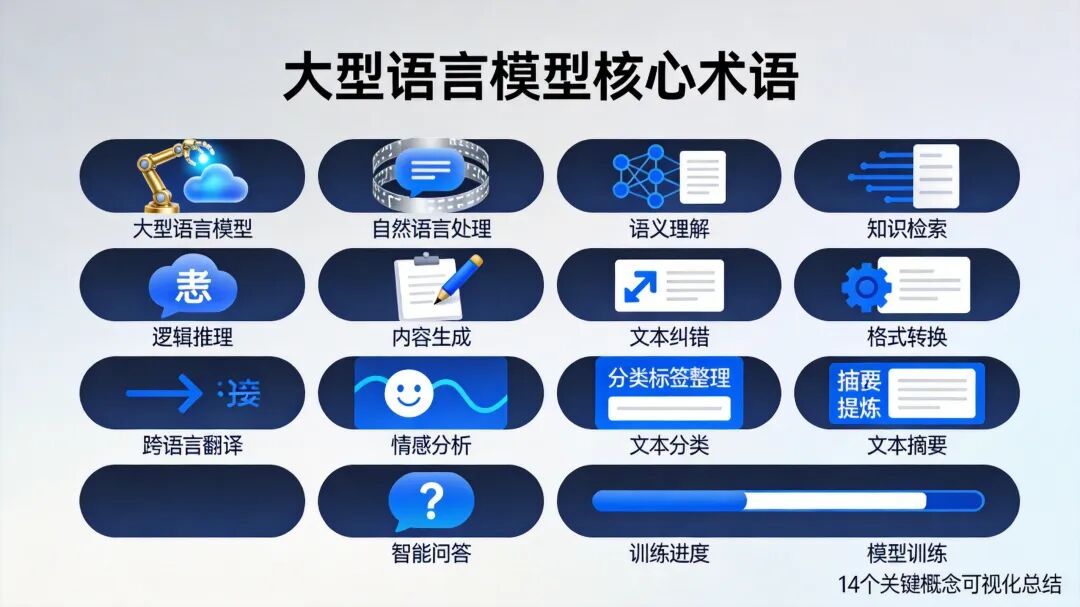

LLM:Large Language Model,大语言模型。就是你平时用的 ChatGPT、Claude、通义、文心背后那坨「会读会写」的模型。叫「大」是因为参数量巨大,能处理自然语言。你可以把它想成:一个被喂了海量文本、专门练「接话」的超级选手——你给上半句,它接下半句,接得多了就像在「聊天」了。

Token:模型眼里的一段段「小碎块」。英文大概一个词算一两个 token,中文一个字往往也是一两个 token。你输入多少字、模型吐出多少字,最后都按 token 数算钱。所以「省 token」= 省字数、省成本。为啥不直接按字数算?因为不同语言、不同写法,拆成 token 的个数不一样,用 token 更公平、也更好算力。

Prompt:你这次给 AI 下的指令。比如「用三百字介绍北京」——这句就是 prompt。写好 prompt 等于把需求说清楚,模型才不跑偏。很多人觉得「提示词」很玄学,其实说白了就是:你跟模型说的那句话。说清楚了,它才少瞎编。

Context:上下文,就是模型「此刻能看到的全部内容」。一般包括之前的对话记录加上你刚发的那句。模型没有真正的记性,每次回复都是把这一段整包内容重新读一遍再算出来的。context 越长,能记住的越多,但太长了会贵,而且中间容易忘。有人把这叫「三明治效应」:两头记得牢,中间糊。所以长对话里重要的事,不妨隔几轮再提一嘴,给它「敲黑板」。

二、记性、动手能力和「通用插头」

Memory:在 AI 产品里常说「记忆」。多数时候分两种——短期记忆就是当前这次对话的 context,关掉就没了,像你电脑的内存,一关机就清空;长期记忆是跨会话、存进数据库或向量库的东西,下次还能调出来用,像给你的 AI 配了块硬盘。想要它「记得你上次说过喜欢川菜」,就得靠长期记忆。

Function Calling:让模型不仅能回你一句话,还能「替你去执行一段代码或调一个接口」。比如你说「查一下北京明天天气」,模型就调天气 API 把结果塞进回复里。这是各家模型自己提供的能力,属于「单点能力」——好用,但每家写法不太一样。

MCP:Model Context Protocol,模型上下文协议,是 Anthropic 推的一个开放协议。你可以把它想成「通用插头」:不管接数据库、本地文件还是别的服务,只要按 MCP 规范来,AI 就能用同一套方式去调。Function Calling 是某一家模型的「专用口」,MCP 是大家都能用的「标准口」。Agent 负责想「要干啥」,MCP 负责「怎么连、怎么调」。以后你听到「接了个 MCP 服务」,意思就是:给 AI 插了个标准化的外挂。

三、链条、流水线和「开卷考试」

LangChain:一个开源框架,专门把「读文档→切块→转成向量→存起来→检索→拼进 prompt→调 LLM」这一串步骤串成一条链。做 RAG(见下)、做小助手、做知识库问答,很多人拿它当脚手架,省得自己从零写。名字里的 Chain 就是「链」:一步接一步,像流水线。

Workflow:工作流,就是「先做 A、再做 B、再根据结果做 C」的流程。在 AI 场景里常指:多轮调用模型、穿插查库、调 API 的流水线。低代码平台里拖的那一串节点,本质上也是在配 workflow。说白了就是:给 AI 干活定个「工序表」。

RAG:Retrieval-Augmented Generation,检索增强生成。简单说就是:先从不属于模型训练数据的「知识库」里搜出相关片段,再和问题一起塞给模型生成答案。相当于让模型「开卷考试」——不用把海量资料都背进参数里,用到时再查就行。这样既能用到最新、最私有的资料,又不用动不动就重新训模型,所以企业里用得特别多。

Embedding:嵌入,也叫「向量化」。把一段文字变成一长串数字(向量),语义相近的文字,对应的向量在数学上会挨得近。这样就能「按意思找意思」而不是死磕关键词——比如你搜「怎么省钱」,也能匹配到「省钱技巧」「省钱攻略」。RAG 里「从知识库搜相关段落」那一步,背后多半就是 embedding + 向量检索。

四、Agent 一家:会干活的 AI

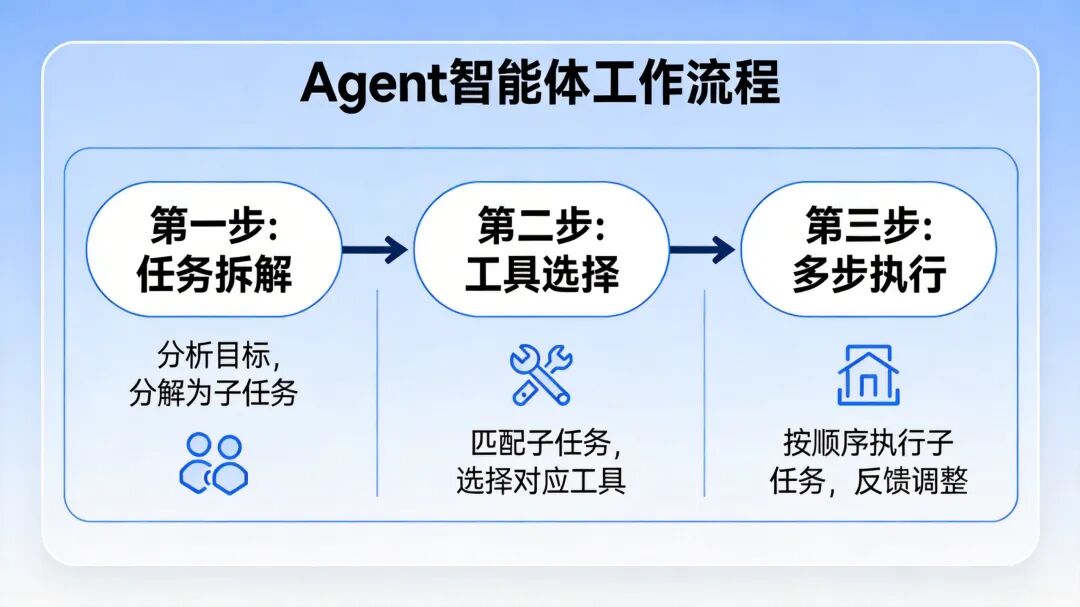

Agent:不只会聊、还会「动手」的 AI 系统。它会自己拆任务、选工具、多步执行,直到达成目标。比如你让它「整理本周邮件并标出重点」,它可能先去读邮件、再调日历、再写摘要。和「你问一句它答一句」的聊天机器人不一样,Agent 是能跑流程、能调接口的「数字打工人」。

Subagent:子智能体。一个大 Agent 把复杂任务拆成好几块,其中某一块交给一个专门的小 Agent 去干,这个小家伙就是 subagent。比如主 Agent 管「写报告」,底下有个 subagent 专门「查数据」,另一个专门「画图」。分工明确,主 Agent 当项目经理。

Skills:在 Cursor、某些 Agent 产品里,skills 指的是一套预设好的「技能」或「行为规则」。比如「按我们公司的规范做 Code Review」「按某模板写周报」。装上某个 skill,Agent 就在对应场景里按这套规则来,不用每次重新教。相当于给 Agent 装了个「技能包」。

五、那些让你又爱又恨的「小细节」

Temperature:温度。听起来像物理课?其实是调模型「有多随机」的旋钮。温度低(接近 0):回答更稳、更确定,适合查事实、算数、客服话术;温度高(接近 1 或 2):回答更放飞、更有创意,适合写文案、头脑风暴。所以别怪模型有时「一本正经胡说」。先把温度调低试试,再在 prompt 里加一句「不知道就说不知道」。

幻觉(Hallucination) :模型一本正经地胡说八道。编个不存在的书名、给你造一段「专家说」、把张三的事安到李四头上……都是幻觉。因为模型本质是「按概率接字」,它不真「知道」对错,只是挑概率高的词往下接,接多了就可能跑偏。怎么办?关键信息别偷懒,自己核实一遍;能用 RAG 的用 RAG,让模型少「自由发挥」;提示词里加一句「不确定就说不知道」也有帮助。

思维链(CoT,Chain-of-Thought) :让模型「先想再说」。不是直接丢答案,而是先写出推理步骤,比如「第一步……第二步……所以答案是……」。这样复杂题(数学、逻辑、多步推理)准确率会明显上去,因为模型被迫「动脑子」而不是蒙一个。你只要在 prompt 里加一句「请一步步思考」,就算最简版的 CoT。

提示词工程(Prompt Engineering) :说白了就是「怎么把需求说清楚、让模型少跑偏」的一门手艺。不是越长的 prompt 越好,也不是有万能模板,关键是:目标明确、约束清楚、必要时给示例。很多人以为玄学,其实就三点:说清要啥、说清不要啥、复杂任务给个样例。

六、接出去、接进来:API 和多模态

API:Application Programming Interface,应用程序接口。就是「别人把模型能力封装成一堆接口,你按格式发请求、它按格式回结果」。你用的各种 AI 应用,背后多半在调 OpenAI、Claude、通义之类的 API。按调用次数或 token 数计费,开发者不用自己训模型,接上线就能用。

知识截止日期:模型训练用的数据有截止时间,过了那天的事它「不知道」。所以问「昨天某明星离婚了吗」可能答错或说不知道。要最新信息,就得靠联网搜索、RAG 拉实时数据,或者选标注了「支持联网」的产品。别指望裸模型当实时新闻源。

多模态(Multimodal) :不只会处理文字,还能看图、听声、甚至看视频。你发一张图问「这是啥菜」,模型能认出来并回答,这就是多模态。现在很多模型都支持「图+文」输入,做产品介绍、文档理解、设计评审啥的特别方便。

七、小结:一张「人设表」对上号

LLM 是干活的脑子,token 是算钱和计数的单位,prompt 是你下的单,context 是它眼前能看到的全部。Memory 分短期(当次对话)和长期(持久化);Function Calling 让模型能调接口,MCP 是统一的「插头」标准。LangChain 是串 RAG/工作流的框架,workflow 是步骤编排,RAG 是开卷考试,embedding 是把文字变成「按意思找意思」的向量。Agent 是会规划、会动手的 AI,subagent 是它手下的专项小兵,skills 是技能包。Temperature 管「多随机」,幻觉是胡说八道,思维链是「先想再说」,提示词工程是把需求说清楚的手艺。API 是接模型能力的接口,知识截止日期提醒你它「不知道昨天的事」,多模态是能看图听声。把这些名字和角色对上号,再听到就不会发怵了,该省 token 省 token,该查证查证,该调温度调温度——你就算入门了。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

【附赠一节免费的直播讲座,技术大佬带你学习大模型的相关知识、学习思路、就业前景以及怎么结合当前的工作发展方向等,欢迎大家~】

更多推荐

已为社区贡献39条内容

已为社区贡献39条内容

所有评论(0)