从零开始手写微调代码:如何用本地deepseek模型在自己构建的数据集进行微调,大模型入门到精通,收藏这篇就足够了!

从零开始手写微调代码:如何用本地deepseek模型在自己构建的数据集进行微调,大模型入门到精通,收藏这篇就足够了!

最近翻阅了各种视频资料,文档,关于如何使用自己构建的数据集进行微调的教程质量参差不齐,有的相当简略,有的需要colab或者租用云服务器或者使用一些集成的框架,对于我这种知识面不够的小白相当不友好,最后终于找到一个相对没那么复杂,比较灵活的方式对本地的deepseek模型进行微调的教程。

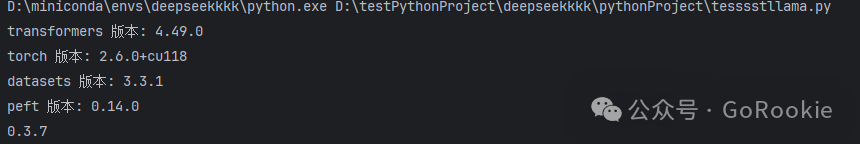

首先通过conda创建虚拟环境,并且在pycharm能够激活与使用,并且安装相应的依赖,最后一个是llama的版本,就涉及到部署模型了,这里先不展开讲(注意:我在这里安装的torch版本是gpu版本):

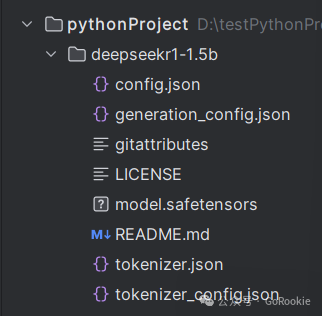

然后,将deepseek模型的所有文件放到当前目录下,我这里是从hugface下载的:

之后开始加载模型和分词器,因为我显存不够用,只能选择cpu了,或者可以选择狂降低:

# 加载模型和分词器

model_name = "deepseekr1-1.5b"

tokenizer = AutoTokenizer.from_pretrained(model_name)

# 检查 CUDA 是否可用

device = "cuda" if torch.cuda.is_available() else "cpu"

model = AutoModelForCausalLM.from_pretrained(model_name)

# 如果使用 CUDA,转换模型为 float16 精度

if device == "cuda":

model = model.half()

# 释放未使用的缓存

torch.cuda.empty_cache()

print(f"————模型加载成功-------")

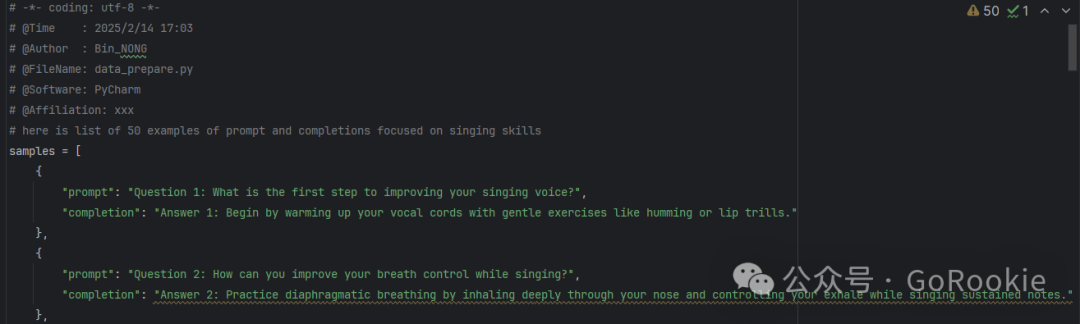

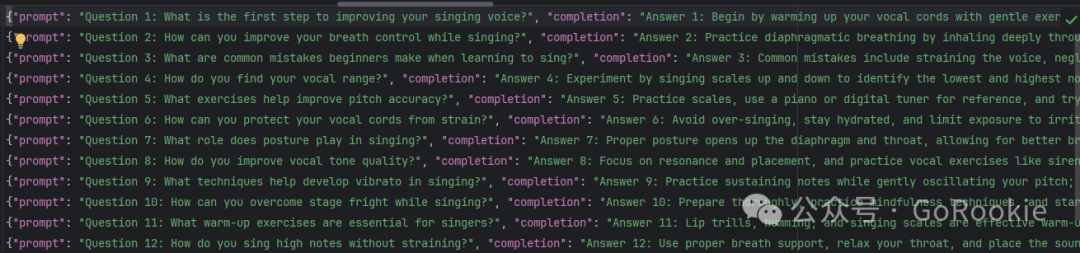

接下来到处理数据集的部分,在这里选择用ai生成了数据样本,包括prompt和completion,在这里我只截取了部分内容,因为我对数据集的构建方式还了解不够深入,只能参考较为简单的构建方式了,将这个数据集写在一个.py文件下,这样才能进行数据集的构建,通过脚本的方式:

构建数据集的代码如下,在这里通过dataset的split方法将数据集进行了分割,同时将数据集处理成jsonl格式:

with open("datasets.jsonl","w",encoding="utf-8") as f:

for s in samples:

json_line = json.dumps(s, ensure_ascii=False)

f.write(json_line + "\n")

else:

print("prepare data is finished!")

dataset = load_dataset("json", data_files={"train": "datasets.jsonl"},split="train")

print("数据量:",len(dataset))

train_test_split = dataset.train_test_split(test_size=0.1)

train_dataset = train_test_split["train"]

eval_dataset = train_test_split["test"]

print(f"train_dataset: {len(train_dataset)}")

print(f"eval_dataset: {len(eval_dataset)}")

print("完成数据准备!")

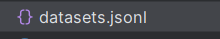

处理好的数据集是这样的形式:

接着将数据集token化,对数据进行微调前的最后准备,关于token的超参可以根据自己的配置来进行设置,我的电脑实在是不行,所以只能设置得一点:

def tokenize_function(examples):

texts = [f"{prompt}\n{completion}"for prompt, completion in zip(examples["prompt"], examples["completion"])]

tokens = tokenizer(texts, padding="max_length", truncation=True, max_length=128)

tokens["labels"] = tokens["input_ids"].copy()

return tokens

tokenized_train_dataset = train_dataset.map(tokenize_function,batched=True)

tokenized_eval_dataset = eval_dataset.map(tokenize_function,batched=True)

# print("完成tokening",tokenized_train_dataset[0])

接着再进行量化和lora微调的设置,以及训练超参数的设置,由于我想要快速看到结果,所以并没有选择太多轮的训练,同时照顾硬件配置,也将梯度设置和batch设置得很小:

# 量化设置

quantization_config = BitsAndBytesConfig(

load_in_8bit=True,

)

model = AutoModelForCausalLM.from_pretrained(

model_name,

quantization_config=quantization_config,

device_map="auto",

)

print("完成量化")

lora_config = LoraConfig(

r=8,lora_alpha=16,lora_dropout=0.05,task_type=TaskType.CAUSAL_LM

)

model = get_peft_model(model,lora_config)

model.print_trainable_parameters()

print("完成lora")

traning_args = TrainingArguments(

output_dir="./fine_tune_models",

num_train_epochs=5, # 尝试减少训练轮数

per_device_train_batch_size=1,

gradient_accumulation_steps=2,

learning_rate=2e-4,

logging_steps=10,

eval_strategy="steps",

eval_steps=5,

fp16=True,

save_steps=100,

logging_dir="./logs",

run_name="deepseekr1-1.5b-lora"

)

print("训练参数设置完成")

trainer = Trainer(

model=model,

args=traning_args,

train_dataset=tokenized_train_dataset,

eval_dataset=tokenized_eval_dataset,

)

print("开始训练")

trainer.train()

print("训练完成")

model.save_pretrained("./fine_tune_models")

最后进行模型的合并与保存:

print("开始训练")

trainer.train()

print("训练完成")

model.save_pretrained("./fine_tune_models")

save_path = "./saved_models"

model.save_pretrained(save_path)

tokenizer.save_pretrained(save_path)

print("模型保存成功")

final_save_path = "./final_save_path"

base_model = AutoModelForCausalLM.from_pretrained(model_name)

model = PeftModel.from_pretrained(base_model, save_path)

model = model.merge_and_unload()

model.save_pretrained(final_save_path)

tokenizer.save_pretrained(final_save_path)

print("模型合并保存成功")

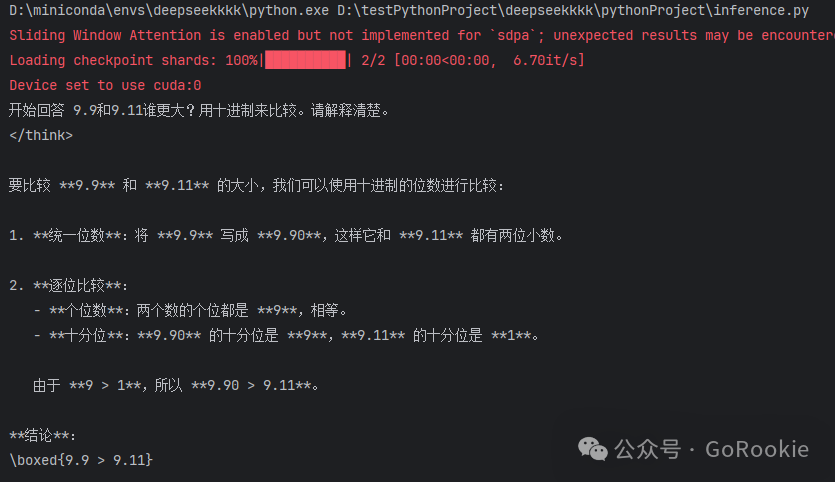

最后写一段简单的代码进行推理测试:

from transformers import AutoModelForCausalLM,AutoTokenizer

final_save_path="./final_save_path"

model = AutoModelForCausalLM.from_pretrained(final_save_path)

tokenizer = AutoTokenizer.from_pretrained(final_save_path)

from transformers import pipeline

# 转换模型为 float16 精度

model = model.half().half()

pipe = pipeline("text-generation",model=model,tokenizer=tokenizer)

prompt = "9.9和9.11谁更大"

generated_texts = pipe(prompt,max_length=512,num_return_sequences=1, truncation=True)

print("开始回答",generated_texts[0]["generated_text"])

运行之后,就可以得到模型推理的结果,

代码还有很多能够优化的地方,总之整个简单的流程就这样,之后还会更新训练完成的模型部署的文章。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献293条内容

已为社区贡献293条内容

所有评论(0)