大模型时代,强化学习如何成为AI的「智慧大脑」?大模型入门到精通,收藏这篇就足够了!

在人工智能飞速发展的今天,大语言模型(Large Language Model, LLM)已经展现出令人惊叹的能力。

在人工智能飞速发展的今天,大语言模型(Large Language Model, LLM)已经展现出令人惊叹的能力。但许多人不知道的是,这些模型之所以如此"智能",强化学习(Reinforcement Learning, RL)技术起到了至关重要的作用。

今天,我们将深入技术细节,探讨强化学习如何让大模型从简单的"文本生成器"蜕变为真正的"思考者"。

为什么大模型需要强化学习?

01

大模型通过海量数据预训练后,虽然掌握了丰富的语言知识,但仍面临四大核心挑战:

- 事实准确性低:容易产生"幻觉",生成错误信息

- 逻辑一致性差:长文本生成中自相矛盾

- 价值观对齐难:可能生成有害或偏见内容

- 指令遵循弱:难以准确执行复杂指令

传统的监督微调(Supervised Fine-Tuning, SFT)虽然有效,但需要大量高质量标注数据,成本极高。而强化学习提供了一种更高效的解决方案:通过反馈信号来优化模型行为。

RLHF:基于人类反馈的强化学习

02

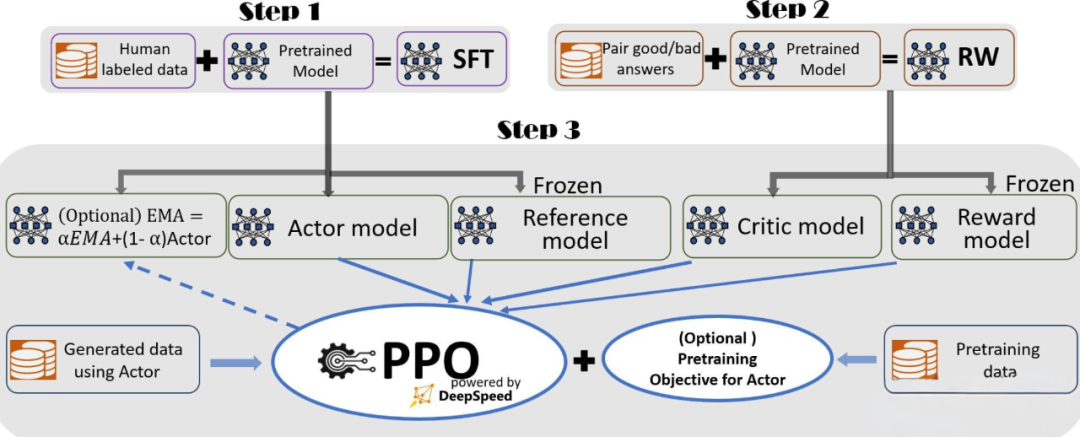

2.1 技术框架三阶段

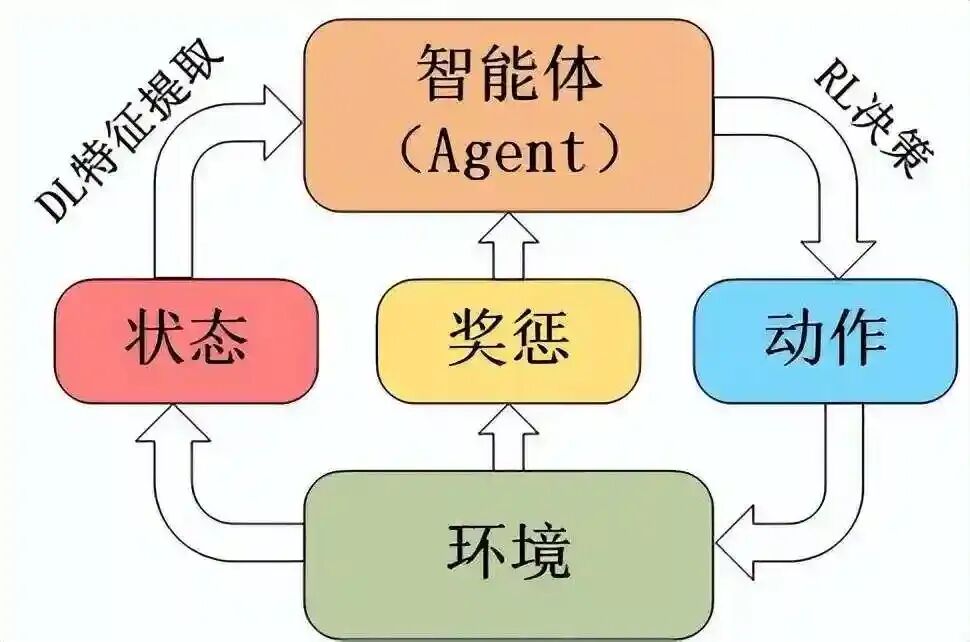

RLHF(Reinforcement Learning from Human Feedback)是目前最主流的技术路线,包含三个关键阶段:

第一阶段:有监督微调(SFT)

-

使用高质量问答对微调基础模型

-

目标是让模型初步掌握指令理解和遵循能力

-

通常需要1-10万条高质量标注数据

第二阶段:奖励模型训练(Reward Model, RM)

-

训练一个专门的奖励模型来模拟人类偏好

-

通过人类对多个回答的排序来学习评分标准

-

关键洞察:相对排名比绝对评分更可靠

第三阶段:强化学习优化(PPO)

-

使用近端策略优化(Proximal Policy Optimization, PPO)算法

-

以奖励模型的评分作为优化信号

-

通过KL散度约束防止模型过度偏离原始分布

2.2 PPO算法在大模型中的适配创新

传统的PPO算法直接应用于文本生成面临三大挑战:

classPPOTrainer:

def__init__(self, model, ref_model, reward_model, kl_coef=0.1):

self.model = model

self.ref_model = ref_model # 参考模型(SFT阶段结果)

self.reward_model = reward_model

self.kl_coef = kl_coef # KL惩罚系数

defcompute_advantages(self, rewards, values):

"""计算优势函数,评估动作的相对好坏"""

# 使用GAE(Generalized Advantage Estimation)算法

advantages = []

last_advantage = 0

for t in reversed(range(len(rewards))):

delta = rewards[t] + self.gamma * values[t+1] - values[t]

advantage = delta + self.gamma * self.lam * last_advantage

advantages.insert(0, advantage)

last_advantage = advantage

return advantages

defppo_loss(self, old_logprobs, new_logprobs, advantages):

"""PPO核心损失函数,包含裁剪机制"""

ratio = torch.exp(new_logprobs - old_logprobs)

surr1 = ratio * advantages

surr2 = torch.clamp(ratio, 1.0 - self.clip_epsilon,

1.0 + self.clip_epsilon) * advantages

return -torch.min(surr1, surr2).mean()

defkl_penalty(self, logits, ref_logits):

"""KL散度惩罚项,防止模型偏离太远"""

p = F.softmax(logits, dim=-1)

q = F.softmax(ref_logits, dim=-1)

return F.kl_div(torch.log(p), q, reduction='batchmean')

实际应用中的创新点:

-

动态KL系数调整:根据训练进度自动调整KL惩罚权重

-

价值函数预训练:提前训练价值函数网络提高稳定性

-

混合损失函数:结合PPO损失和语言建模损失

行业应用案例深度分析

03

3.1 ChatGPT的成功实践

# ChatGPT训练流程伪代码

deftrain_chatgpt():

# 第一阶段:有监督微调

sft_model = supervised_finetune(base_model, human_demonstrations)

# 第二阶段:奖励模型训练

reward_model = train_reward_model(comparison_data)

# 第三阶段:PPO优化

for iteration in range(num_iterations):

# 生成响应

responses = generate_responses(sft_model, prompts)

# 计算奖励(包含KL惩罚)

rewards = reward_model(responses) - kl_penalty(responses, sft_model)

# PPO更新

ppo_update(sft_model, rewards)

关键成功因素:

-

高质量的人类反馈数据收集流程

-

精心设计的奖励函数包含多个维度

-

多轮迭代的RLHF过程(通常3-4轮)

3.2 企业级应用:Anthropic的Constitutional AI

Anthropic提出了RLAIF(Reinforcement Learning from AI Feedback)方案:

classConstitutionalAI:

def__init__(self, constitution):

self.constitution = constitution # 宪法原则集合

self.critic_model = self.train_critic(constitution)

deftrain_critic(self, constitution):

"""训练基于宪法原则的批评模型"""

# 使用宪法原则生成训练数据

training_data = []

for principle in constitution:

examples = self.generate_examples(principle)

training_data.extend(examples)

return train_model(training_data)

defai_feedback(self, text):

"""基于宪法原则的AI反馈"""

scores = {}

for principle in self.constitution:

score = self.critic_model.evaluate(text, principle)

scores[principle] = score

return self.aggregate_scores(scores)

宪法原则示例:

-

“帮助性:回答应当有帮助且切题”

-

“安全性:避免有害或歧视性内容”

-

“真实性:不编造虚假信息”

-

“简洁性:避免不必要的冗长”

技术对比与选型建议

04

4.1 主流技术方案对比

| 技术方案 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|

| RLHF | 效果最好,人类偏好最直接 | 成本高,需要大量人工标注 | 对质量要求极高的场景 |

| RLAIF | 可扩展性强,成本较低 | 宪法原则设计复杂 | 企业级应用,有明确规则需求 |

| DPO | 训练稳定,无需奖励模型 | 对偏好数据质量要求高 | 研究环境,资源有限的情况 |

4.2 算法性能对比实验

根据实验数据(使用LLaMA-7B基础模型):

# 不同算法的性能对比数据

results = {

'SFT-only': {'helpfulness': 72, 'safety': 65, 'consistency': 68},

'RLHF': {'helpfulness': 85, 'safety': 82, 'consistency': 79},

'RLAIF': {'helpfulness': 83, 'safety': 88, 'consistency': 81},

'DPO': {'helpfulness': 84, 'safety': 80, 'consistency': 83}

}

# 训练效率对比

training_efficiency = {

'RLHF': {'time': '120小时', 'GPU内存': '80GB', '人工参与': '高'},

'RLAIF': {'time': '80小时', 'GPU内存': '60GB', '人工参与': '中'},

'DPO': {'time': '60小时', 'GPU内存': '40GB', '人工参与': '低'}

}

实战指南与最佳实践

05

5.1 入门实践建议

对于刚入门的团队:

# 简易RLHF实现示例

defsimple_rlhf_workflow():

# 1. 从高质量数据开始

sft_data = load_high_quality_dialogues()

# 2. 训练基础SFT模型

base_model = AutoModelForCausalLM.from_pretrained("Llama-7B")

sft_trainer = SFTTrainer(model=base_model, dataset=sft_data)

sft_model = sft_trainer.train()

# 3. 收集偏好数据(可从现有数据模拟开始)

preference_data = collect_preference_data(sft_model)

# 4. 训练奖励模型

reward_trainer = RewardTrainer()

reward_model = reward_trainer.train(preference_data)

# 5. PPO微调

ppo_trainer = PPOTrainer(sft_model, reward_model)

final_model = ppo_trainer.train()

return final_model

5.2 避免常见陷阱

- 奖励黑客问题:

defdetect_reward_hacking(rewards, metrics):

"""检测奖励黑客现象"""

if rewards.mean() > 0.9and metrics['diversity'] < 0.3:

returnTrue# 可能发生了奖励黑客

returnFalse

- 分布偏移处理:

defmitigate_distribution_shift():

# 定期在新鲜数据上评估

# 使用动态正则化强度

# 实施早期停止策略

未来发展方向与技术演进

06

6.1 技术趋势预测

- 多模态强化学习:将RL扩展到视觉-语言联合模型

- 在线学习系统:让模型在真实交互中持续优化

- 理论突破:深度理解RL对齐机制的数学基础

- 个性化对齐:根据不同用户偏好定制模型行为

6.2 新兴研究方向

classFutureResearchDirections:

def__init__(self):

self.directions = [

"基于课程学习的RLHF渐进式训练",

"多目标强化学习的Pareto优化",

"分布式RLHF训练框架",

"强化学习与模型编辑的结合",

"基于因果推断的奖励建模"

]

defprioritize_directions(self, impact, feasibility):

"""优先排序研究方向"""

return sorted(self.directions,

key=lambda x: impact[x] * feasibility[x],

reverse=True)

总结与展望

07

技术要点回顾

-

RLHF是目前最成熟的大模型对齐技术,但成本较高

-

RLAIF提供了可扩展的替代方案,适合企业级应用

-

DPO简化了训练流程,但对数据质量要求极高

-

多目标平衡和奖励黑客问题是实际应用中的主要挑战

实践建议

对于不同规模团队的推荐方案:

| 团队规模 | 推荐方案 | 预期效果 | 资源需求 |

|---|---|---|---|

| 初创团队 | DPO或简化版RLHF | 中等效果,快速迭代 | 低-中 |

| 中型企业 | 标准RLHF流程 | 良好效果,可控成本 | 中等 |

| 大型企业 | 多轮RLHF+RLAIF混合 | 最佳效果,全面能力 | 高 |

未来展望

强化学习不仅让大模型更"有用",更重要的是让它们更"可用"和"可靠"。随着技术的不断发展,我们预见:

- 训练效率提升:新的算法将大幅降低RLHF的计算成本

- 安全性增强:更好的价值观对齐技术将减少模型风险行为

- 个性化发展:模型将能够适应不同用户的偏好和需求

- 多模态扩展:RL技术将扩展到视频、音频等多模态领域

最终建议:对于大多数应用场景,建议从简化版RLHF开始,逐步迭代优化。重点关注数据质量和评估体系的建设,这往往比算法选择更重要。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献223条内容

已为社区贡献223条内容

所有评论(0)