大模型微调实战教程(二):LLaMA-Factory 实战,从零开始构建微调数据集与模型评估体系

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

在前面的文章中,我们详细探讨了 LLaMA-Factory 的各项核心配置参数。本文将在此基础上,深入实践如何构建自定义的微调数据集,并进一步探究 LLaMA-Factory 中的模型评估策略。这篇文章,作者将结合实际操作,构建微调数据集与模型评估体系。

一、利用 Easy Dataset 构建高质量微调数据集

构建高质量的微调数据集是提升模型性能的关键一步。LLaMA-Factory 官方推荐了 Easy Dataset 和 GraphGen 两款工具。考虑到 Easy Dataset 的本土化优势及其日益活跃的社区生态,我们选择 Easy Dataset 作为本次数据集构建的工具。

1. Easy Dataset 简介与工具选择

Easy Dataset 是一款由国内开发者构建的 LLM 数据生成工具,它通过 LLM 生成问答对来构建数据集。相比之下,GraphGen 则结合了 LLM 和知识图谱。在实际应用中,Easy Dataset 的便捷性和良好的社区支持使其成为更优选择。

Easy Dataset 项目地址: https://github.com/ConardLi/easy-dataset

Easy Dataset 文档地址: https://docs.easy-dataset.com

2. 工具下载与启动

Easy Dataset 提供了多种部署方式,包括安装包下载、Docker 部署和源码运行。对于非开发者,直接下载安装包即可快速上手。对于开发者,推荐使用源码运行方式,具体步骤如下:

- 克隆仓库:

git clone https://github.com/ConardLi/easy-dataset.git

cd easy-dataset2. 安装依赖:

pnpm i3. 启动服务:

pnpm build

pnpm start服务启动后,在浏览器中访问 http://localhost:1717 即可进入项目主页。

3. 数据集构建流程详解

启动 Easy Dataset 后,即可开始构建您的专属数据集:

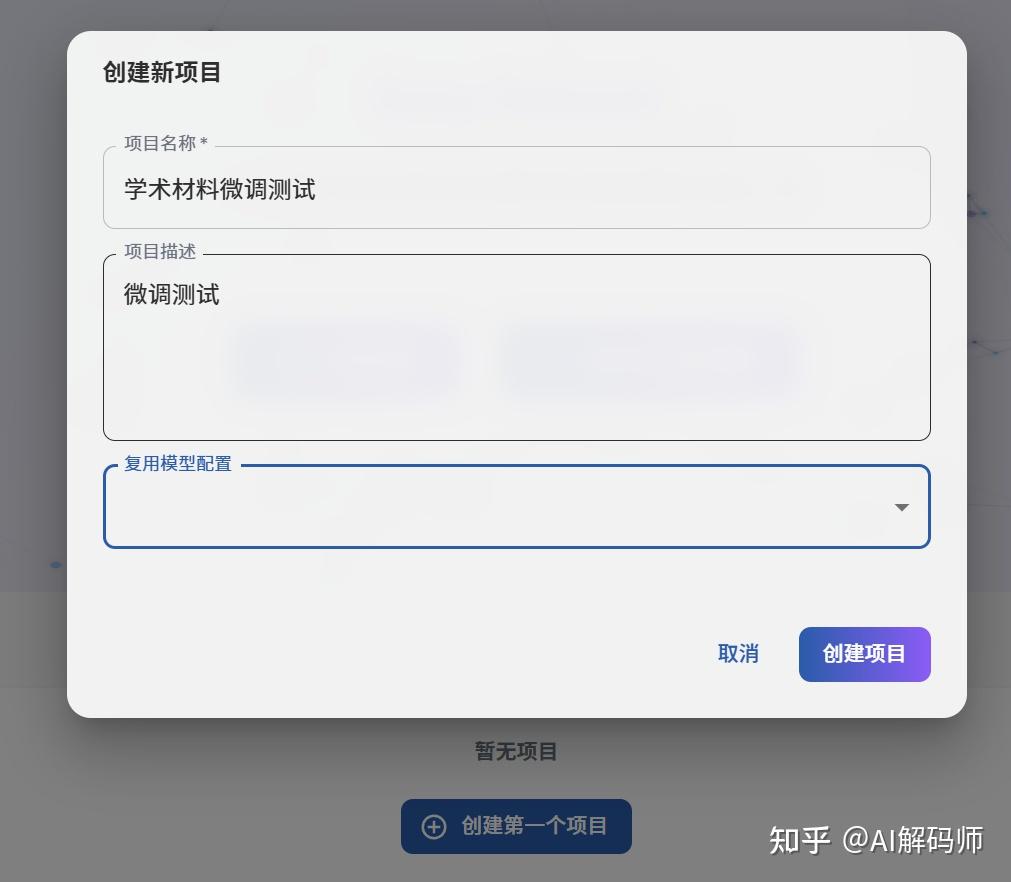

3.1 创建项目

首先,在 Easy Dataset 界面中创建一个新项目,作为您数据集的容器。

3.2 配置模型

Easy Dataset 支持 Ollama、GPT、硅基等多种平台。本文以硅基平台的 API 配置为例。完成模型配置后,请确保在右上角选择您已配置的模型。

3.3 上传文件与解析

在文献处理环节,如果您需要上传 PDF 文件,Easy Dataset 提供了两种解析方式:自带解析或 MinerU API 解析。值得注意的是,MinerU 的解析效果通常优于内置解析。因此,我们强烈建议您先使用 MinerU 将 PDF 文件解析为 Markdown(.md)格式,然后再直接上传 Markdown 文件,这样可以省去二次解析的步骤。

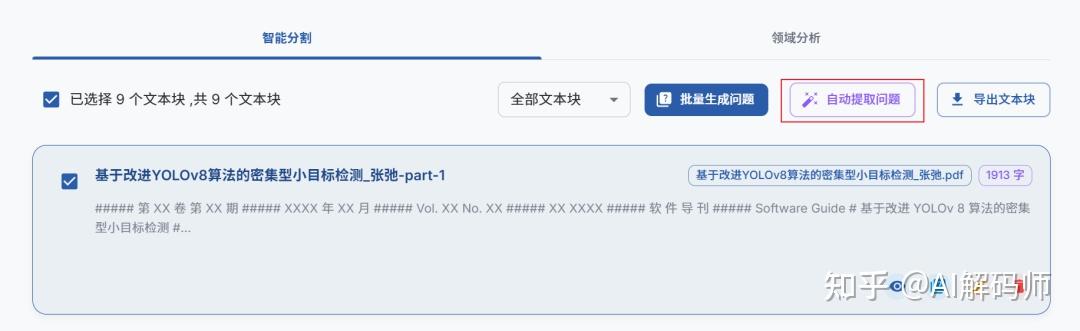

3.4 自动提取问题

文件解析完成后,您可以全选所有文本块,然后选择“自动提取问题”或“批量生成问题”。两者的主要区别在于执行方式:

- 自动提取问题(后台执行): 推荐使用此选项,它会在后台运行,您可以在此期间切换到其他标签页进行操作,而不会中断任务。

- 批量生成问题(前台执行): 此选项会在前台执行,这意味着在生成过程中您无法切换标签页,否则任务将会中断。

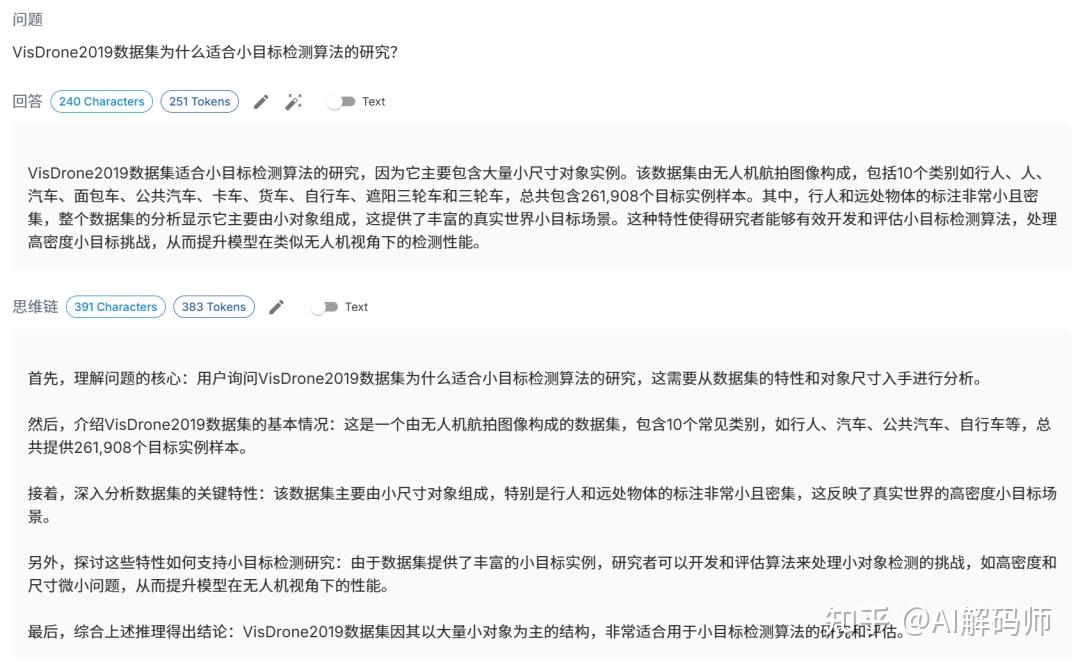

3.5 自动生成数据集

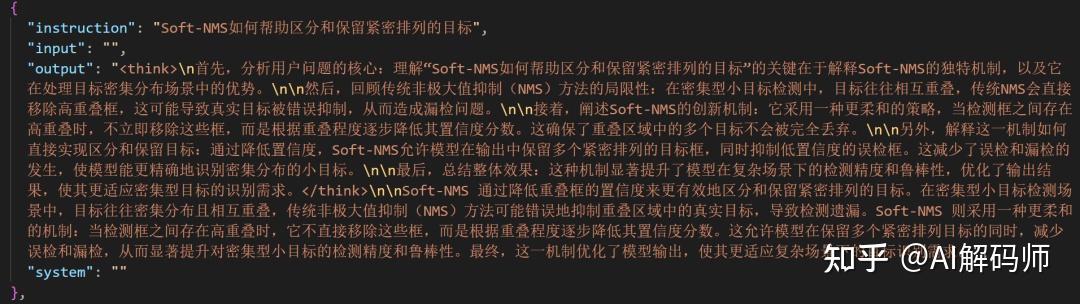

问题提取完毕后,选择“自动生成数据集”。系统将自动调用您当前设置的 LLM 模型,为每个问题生成对应的答案和思维链(Chain of Thought)。数据集生成完成后,您可以直接预览并进行二次编辑。

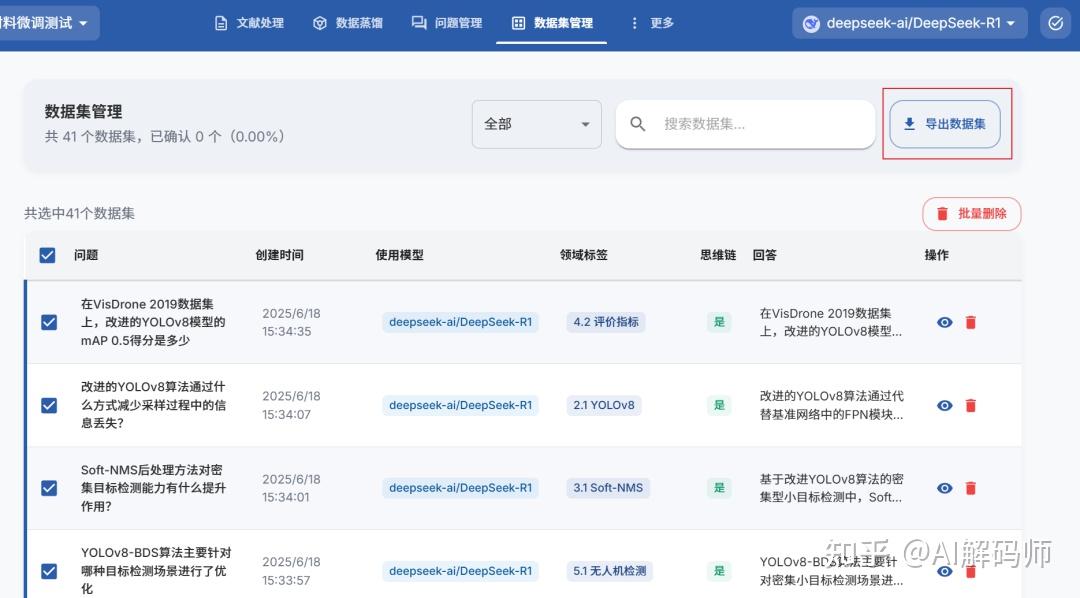

3.6 导出数据集

完成数据集的生成和审阅后,全选所有数据集并点击“导出数据集”,系统会自动下载一个格式化的 JSON 文件。默认的数据集格式为 Alpaca 格式。

我在初期尝试配置 DeepSeek-R1 满血版处理一篇 5 页论文时,成本约为 3.43 元,相对较高。硅基平台也提供了免费的低参数量模型。我尝试了 DeepSeek-R1-0528-Qwen3-8B 模型,发现其生成的数据集效果同样令人满意,并且实现了零成本“白嫖”!

4. 数据集导入 LLaMA-Factory 进行微调

成功导出数据集后,下一步就是将其导入 LLaMA-Factory 进行微调。

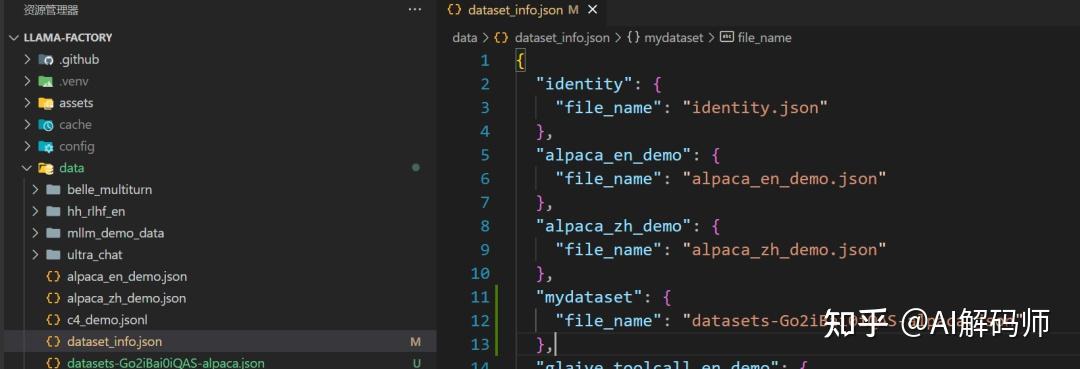

将下载好的 JSON 格式数据集放置到 LLaMA-Factory/data 目录下。然后,修改 dataset_info.json 文件,增加一个新的数据集字典,例如:

"mydataset": {

"file_name": "datasets-Go2iBai0iQAS-alpaca.json"

}请注意,file_name 字段应与您实际下载的数据集文件名保持一致。

完成配置后,启动 LLaMA-Factory 的 Web UI:

llamafactory-cli webui此时,您就可以在 LLaMA-Factory 中选择并使用您刚刚构建的数据集了。需要注意的是,数据集文件并非强制要求放置在 data 目录下,只要在 dataset_info.json 中正确指定文件路径和名称即可。

二、LLaMA-Factory 中的模型评估体系深度解析

找到了最优的模型训练策略后,要如何科学地评估模型性能呢?这可以分解为三个核心子问题:评估标准是什么?如何进行模型评估?如何利用公开数据集进行评估?本文将围绕这三个问题展开深入探讨。

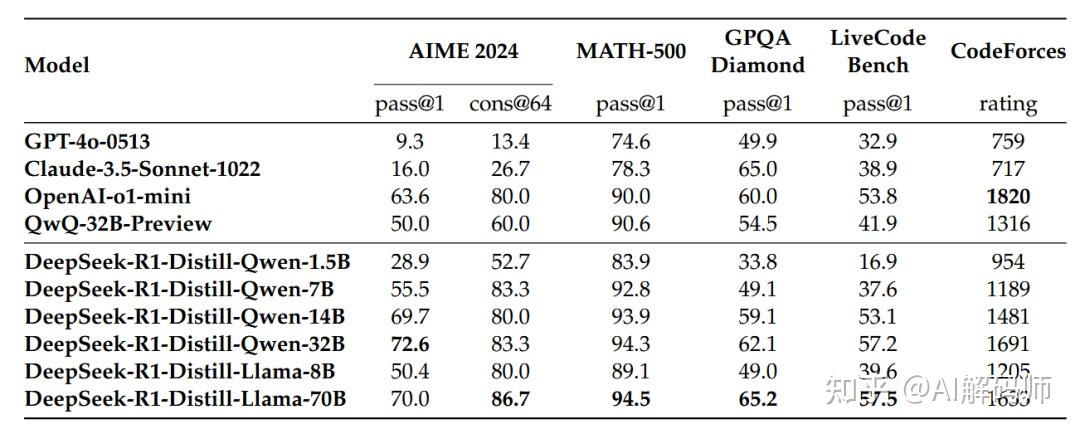

1. 模型评估标准

评估模型性能有多种标准。以 DeepSeek-R1 论文为例,其主要采用了以下三个评估标准:

- Pass@1: 表示模型在第一次尝试中正确解决问题的概率。

- Cons@64: 表示模型在多次尝试(例如 64 次)中一致解决问题的概率。

- Rating: 该平台上的评分或排名,用于衡量模型在编程竞赛中的表现。

然而,根据 LLaMA-Factory 的文档,它并不直接支持上述评估指标,而是采用了以下更通用的性能和速度指标:

1.1 性能指标

- BLEU-4: BLEU(Bilingual Evaluation Understudy)是一种常用的机器翻译质量评估指标。BLEU-4 表示四元语法 BLEU 分数,衡量模型生成文本与参考文本之间的 N-gram 匹配程度,其中 N=4。值越高表示生成的文本与参考文本越相似,最大值为 100。

- ROUGE-1/ROUGE-2: ROUGE(Recall-Oriented Understudy for Gisting Evaluation)用于评估自动摘要和文本生成模型性能。ROUGE-1 表示一元 ROUGE 分数,ROUGE-2 表示二元 ROUGE 分数,分别衡量模型生成文本与参考文本之间的单个词和双词序列的匹配程度。值越高表示生成的文本与参考文本越相似,最大值为 100。

- ROUGE-L: ROUGE-L 衡量模型生成文本与参考文本之间最长公共子序列(Longest Common Subsequence)的匹配程度。值越高表示生成的文本与参考文本越相似,最大值为 100。

1.2 速度指标

- Runtime: 预测运行时间,表示模型生成一批样本所花费的总时间,单位通常为秒。

- Samples_per_second: 每秒生成的样本数量,用于评估模型的推理速度。

- Steps_per_second: 每秒执行的步骤数量,对于生成模型,通常指每秒执行生成操作的次数。

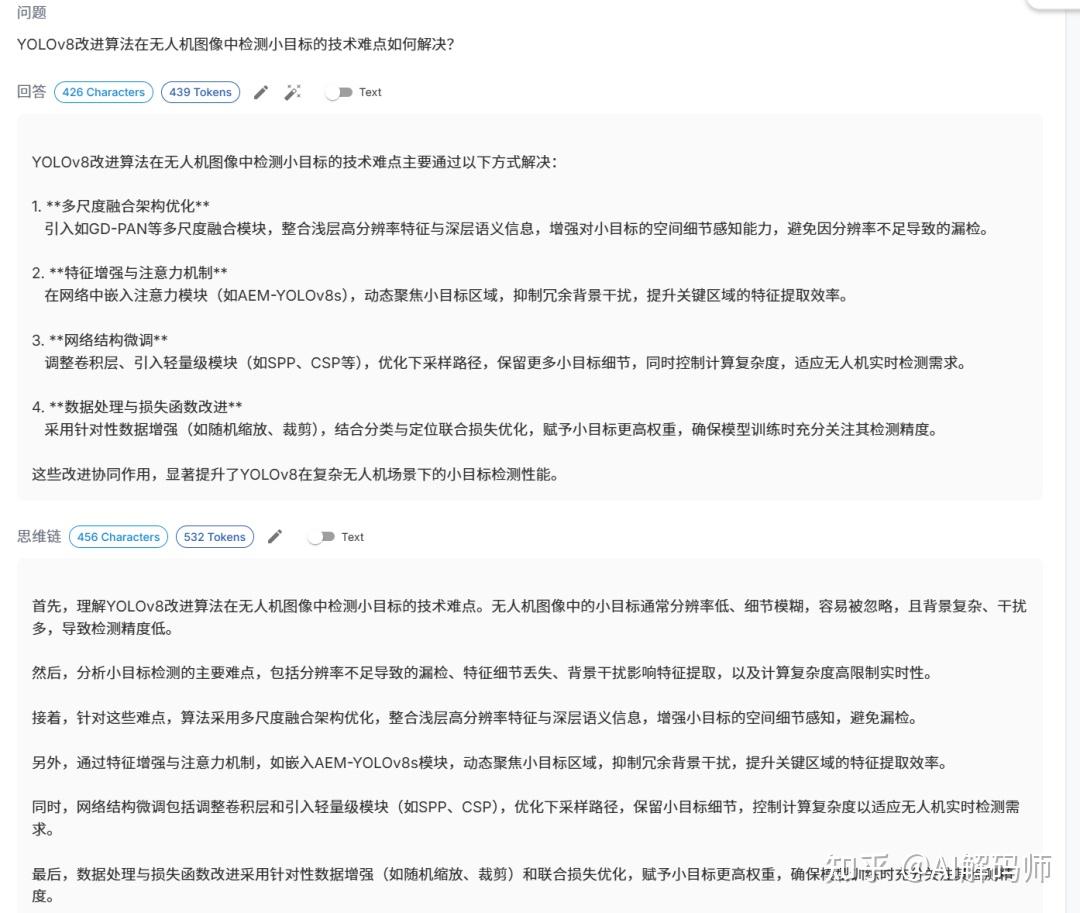

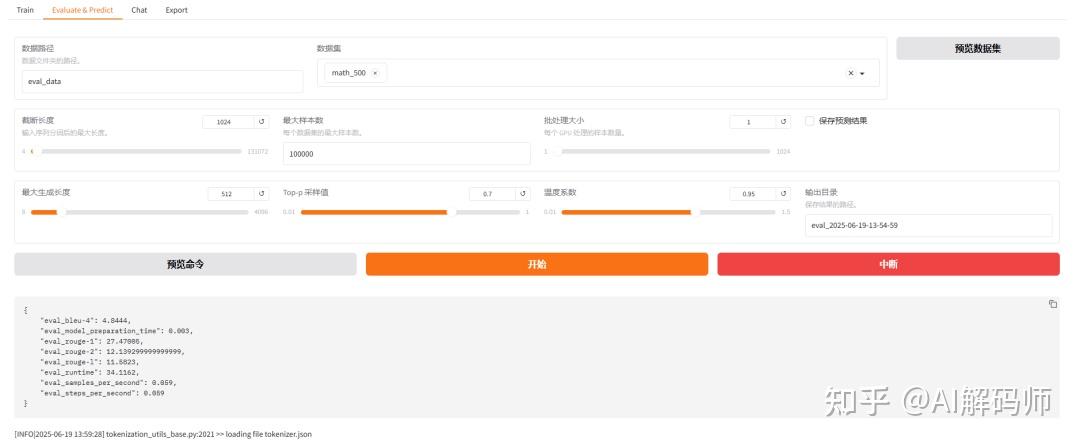

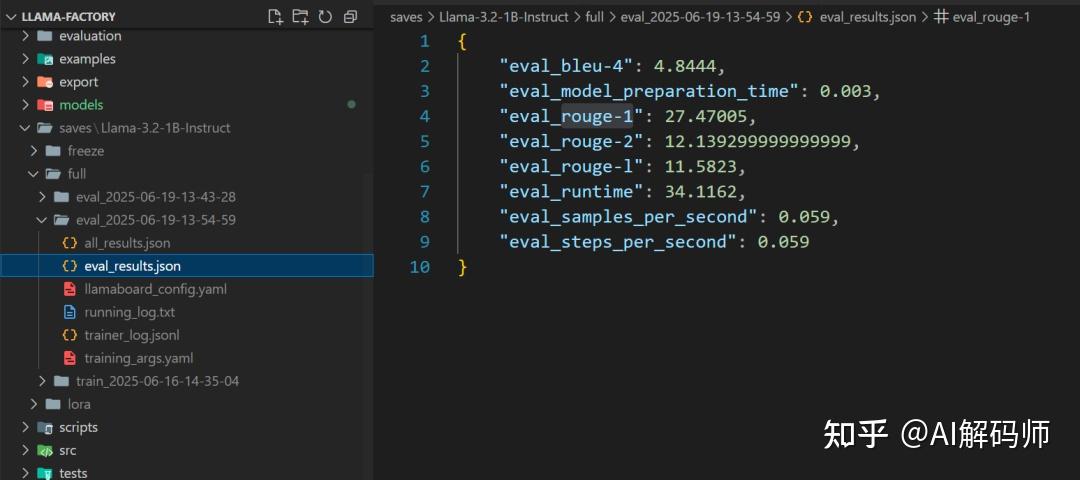

2. LLaMA-Factory 中的模型评估操作

在 LLaMA-Factory 的 Web UI 中,您可以在“Evaluate & Predict”菜单中直接进行模型评估。评估和预测过程是同步进行的,因为需要先通过预测得到模型推理结果,然后才能与真实标签(ground truth)进行比较。如果您不需要保存预测结果,可以取消勾选“保存预测结果”选项(默认开启)。

选择好评测数据集后,您可以设置截断长度(Truncation Length)和最大生成长度(Max Generation Length)。

- 截断长度: 指模型处理文本时能接收的最大 Token 数量。如果数据集的输入较长,模型会进行截断。默认值为 1024,您可以根据实际数据集的效果适当增大此值。

- 最大生成长度: 指模型输出的最大 Token 数量。默认值为 512,在某些场景下可能偏小,也可以适当调大。

完成设置后,评估过程将自动开始,评估结果将保存在输出目录下的 eval_results.json 文件中。

3. 利用公开数据集进行评估(以 MATH-500 为例)

上述评估方法主要基于 Alpaca 格式构建的数据集。下面我们以 MATH-500 公开数据集为例,演示如何在标准公开数据集上进行模型评估。

3.1 下载 MATH-500 数据集

首先,您需要使用 Git LFS 下载数据集。

1.安装 Git LFS:

git lfs install2.下载数据集仓库:

git clone https://huggingface.co/datasets/HuggingFaceH4/MATH-5003.2 格式转换

MATH-500 数据集本身是 JSONL 格式,并且其字典键值与 Alpaca 标准不对应,这会导致 LLaMA-Factory 无法直接解析。因此,我们需要通过一个脚本进行格式转换:

import json

def convert_jsonl_to_alpaca(jsonl_path, output_json_path):

alpaca_data = []

with open(jsonl_path, encoding="utf-8") as infile:

for line in infile:

item = json.loads(line.strip())

alpaca_item = {

"instruction": "" + item.get("problem", ""),

"input": "",

"output": item.get("solution", ""),

}

alpaca_data.append(alpaca_item)

with open(output_json_path, "w", encoding="utf-8") as outfile:

json.dump(alpaca_data, outfile, ensure_ascii=False, indent=2)

print(f"转换完成,保存到 {output_json_path}")

if __name__ == "__main__":

# Convert the MATH-500 test data

convert_jsonl_to_alpaca("eval_data/MATH-500_test.jsonl", "eval_data/math_500_alpaca_output.json")转换完成后,您就可以按照之前文章所描述的方式,将转换后的数据集加载到 LLaMA-Factory 中,并执行模型评估了。

通过本文的详细讲解,我们就可以利用 Easy Dataset 构建微调数据集的方法,并对 LLaMA-Factory 中的模型评估体系有了清晰的认识。在实际操作中,不断尝试和优化数据集构建及评估策略,是提升大模型性能的关键。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?

别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明:AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献271条内容

已为社区贡献271条内容

所有评论(0)