hadoop安装流程

这篇文章主要记录安装hadoop的过程,给后来者一点帮助,官网获取安装包选一款你想要的Apache Hadoop下载完成后上传到服务器(我用的是finalshell)先别急着解压准备Java包像上面一样官网下载对应的Java包这边我已经准备好了jdk-8u212-linux-x64.tar同样的 上传到服务器现在我们开始正式安装hadoop新建一个个人用户adduser wolf (我用的是wol

这篇文章主要记录安装hadoop的过程,给后来者一点帮助,

- 官网获取安装包

选一款你想要的

- 下载完成后上传到服务器(我用的是finalshell)

先别急着解压

- 准备Java包

像上面一样官网下载对应的Java包

这边我已经准备好了

jdk-8u212-linux-x64.tar

同样的 上传到服务器

- 现在我们开始正式安装hadoop

- 新建一个个人用户

adduser wolf (我用的是wolf 大家可以随意设计)

su – wolf 进入到wolf用户下

- 新建几个文件夹

![]()

将root 用户下的

Hadoop压缩包和java包解压到 wolf用户下software文件夹

cp Hadoop-3.1.3.tar.gz /home/wolf/software

cp jdk-8u181-linux-x64.tar.gz /home/wolf/software

然后依次解压到app文件夹下

![]()

![]()

好了,现在app文件夹下就有了两个文件夹

- 接下来创建软链接

![]()

创建软链接的好处之一就是切换版本无感知,对日后的版本管理提供了很大的便利性

ll 一下

- 接下来要更改 etc/hadoop/core-site.xml

![]()

在最后一段加上

注意要改成自己的用户名

- 接下来要更改 etc/hadoop/hdfs-site.xml

![]()

在最后一段加上

- 接着我们要修改主机名

执行

hostnamectl set-hostname wolf 这边一定修改 不然会报错的

- 接着修改workers

![]()

修改成自己的用户名

改完之后要重新进入服务器 才能生效

- 接着配置下/home/wolf/app/hadoop/etc/hadoop/ hadoop-env.sh

Vi hadoop-env.sh

这边要设置下java_home

这个时候应该能体会到软链接的好处,下次我们更新jdk版本的时候只需要整体替换jdk包就行了,不需要再一个个修改这些路径了

- 接着设置下免登录

分别执行

ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

chmod 0600 ~/.ssh/authorized_keys

- 最后修改环境变量

切换到root用户下

vi /etc/profile

在文件最后添加这么几行代码

export JAVA_HOME=/home/wolf/app/java

export PATH=$JAVA_HOME/bin:$PATH

保存退出

并执行 source /etc/profile 重启使环境变量生效

- 安装hadoop

- 格式化节点

来到 /home/wolf/app/Hadoop 路径下

执行

bin/hdfs namenode -format

当出现这句话时 就说明执行成功了

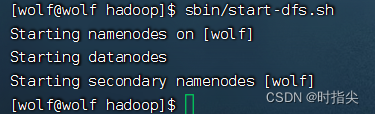

- 启动hadoop

sbin/start-dfs.sh

这样就启动起来了

- 最后结果

输入 jps

看到这几个结果 就算是大功告成了

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)