简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

真实图像去噪Path-Restore: Learning Network Path Selection for Image Restoration(商汤)PRIDNet: Pyramid Real Image Denoising NetworkRIDNet: A Multi-Level Network for Real Image DenoisingPD: When AWGN-ba...

BF16牺牲了数据精度(表示由10位降到7位),但扩大了数据的表示范围(有研究表明数据表示范围比精度更重要)有个参数服务器,模型参数在参数服务器上进行更新,然后所有节点pull模型参数。alpha取0.1,手动降低embedding层的梯度。在code数据集上训练,增强大模型的逻辑推理能力。GLM和LLaMA中采用RoPE旋转式编码。100B参数的大模型开始出现智能涌现。LLaMA采用BF16训练

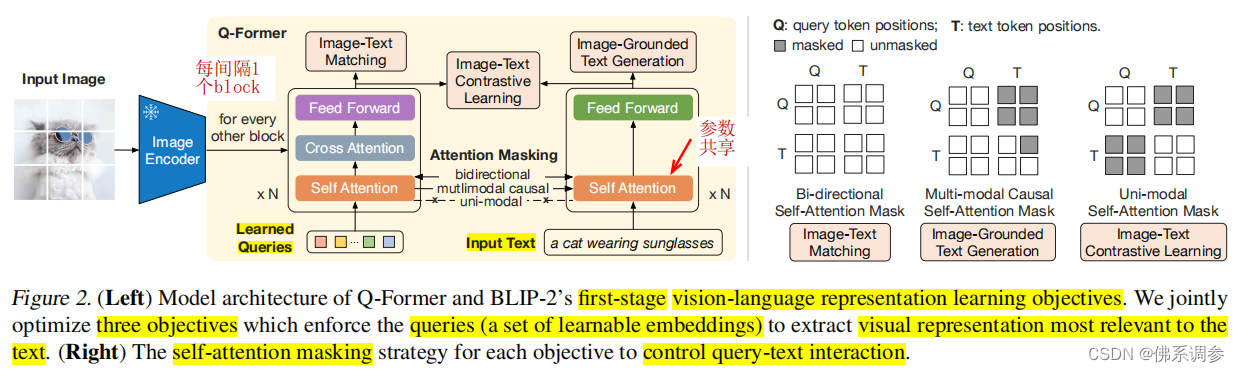

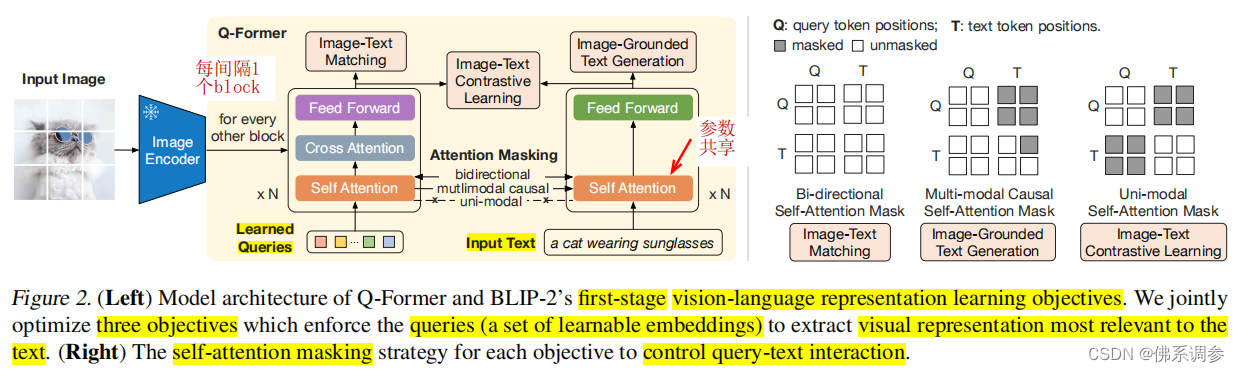

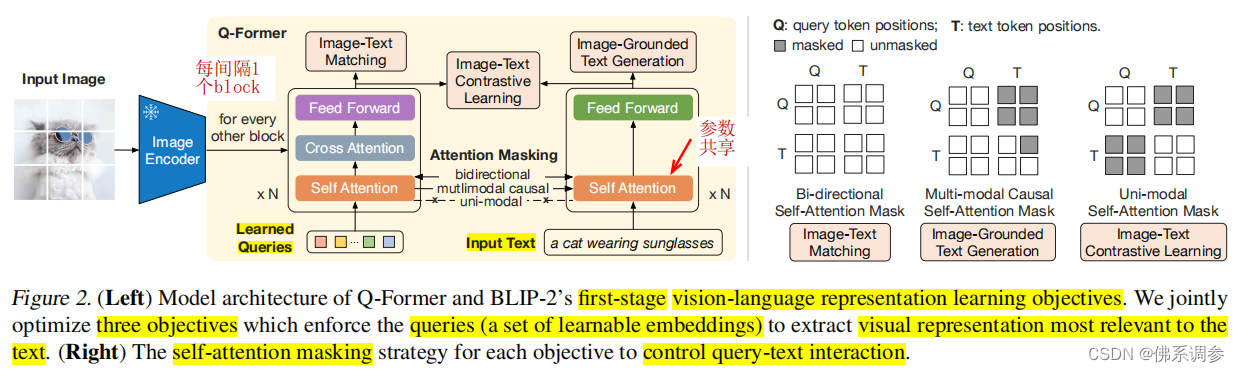

对2023年主流视觉-语言多模态大模型进行总结

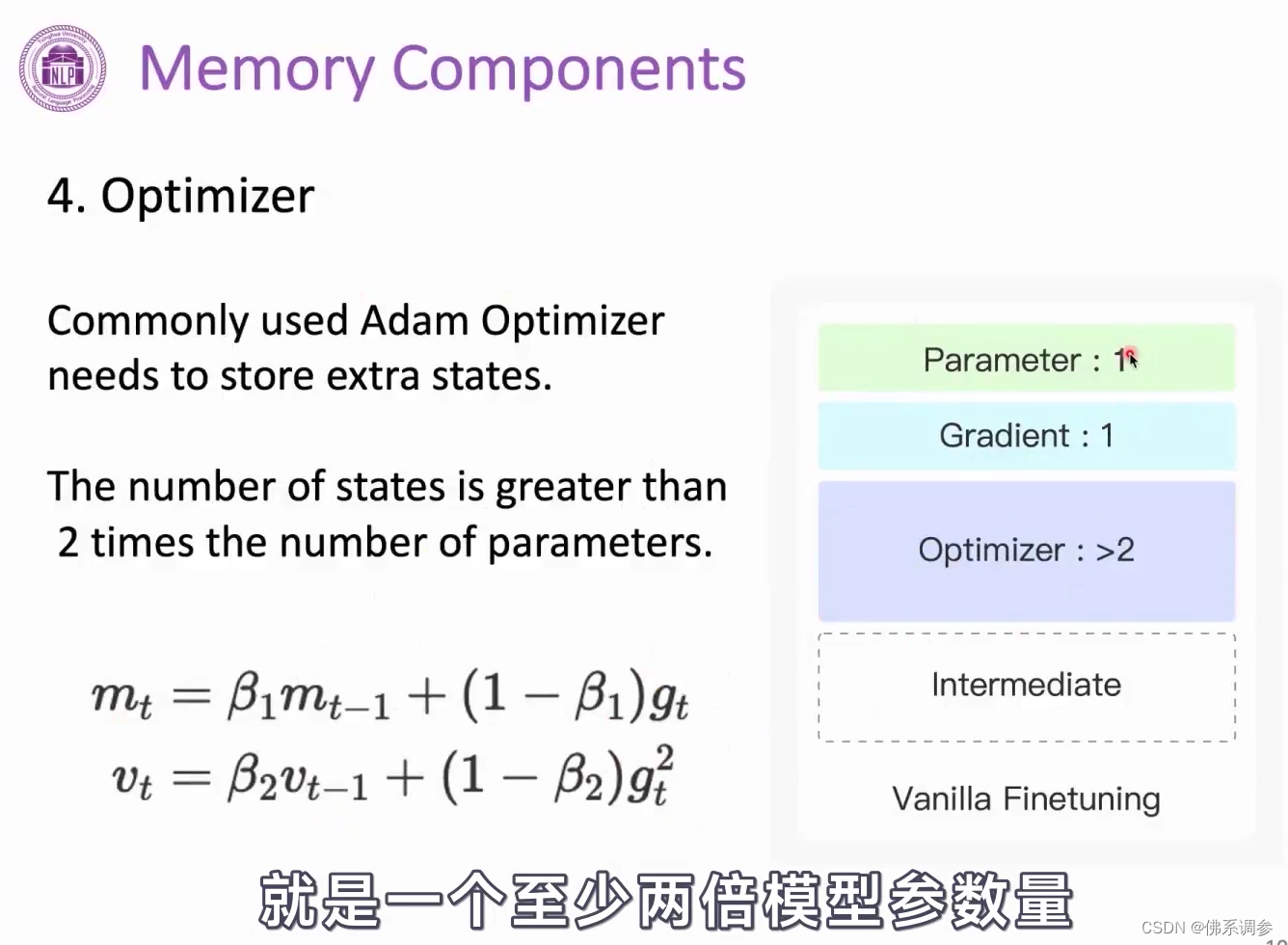

下图以Transformer中的全连接层为例,每一个全连接层的输入参数维度为[batch, 句子长度, 每个token维度]4.模型的中间计算结果,因为反向传播求导时会用到,需要存储每一层的输入。3.优化器参数(占大头):以Adam参数为例,还需要在显卡中额外存储。1. 模型本身参数,假设是1个单位。2.模型的梯度,同样也是一个单位。两个参数,因此为2个单位参数。

Wavelet Toolbox GUI (Graphical User Interface). waveletAnalyzer - Start Wavelet Analyzer graphical user interface tools Wavelets: General biorfilt - Biorthogonal wavelet filter set...

对2023年主流视觉-语言多模态大模型进行总结

BF16牺牲了数据精度(表示由10位降到7位),但扩大了数据的表示范围(有研究表明数据表示范围比精度更重要)有个参数服务器,模型参数在参数服务器上进行更新,然后所有节点pull模型参数。alpha取0.1,手动降低embedding层的梯度。在code数据集上训练,增强大模型的逻辑推理能力。GLM和LLaMA中采用RoPE旋转式编码。100B参数的大模型开始出现智能涌现。LLaMA采用BF16训练

对2023年主流视觉-语言多模态大模型进行总结