简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

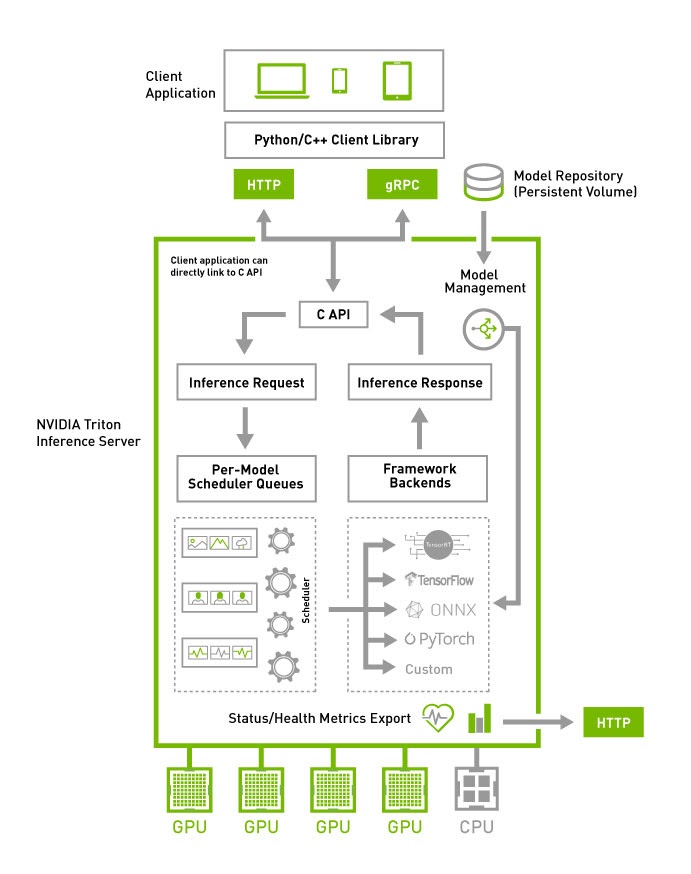

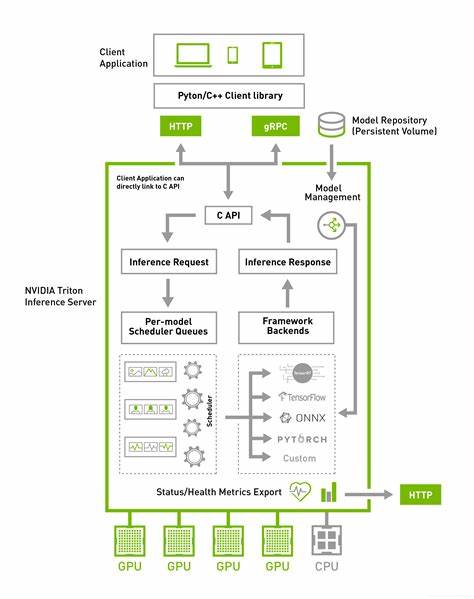

什么是triton inference server?它的前身是nvidia的tensorRT,triton在具备tensorRT的基础上,增加了主流的TF,pytorch,onnx等模型的推理部署支持。是一款非常好的推理模型部署服务。具体了解:NVIDIA Triton Inference Server | NVIDIA Developerhttps://developer.nvidia.com

道战略力,数字领导力,变革力战略力:变成企业必须做、大家一起做的共同战略变革力:变革的本质是对人的行为的重塑术流程驱动,数据驱动,智能驱动流程驱动:是聚焦业务重构数字化流程,从企业的角度来看,数据是不完整的。数据已经在随着业务的开展而逐步产生,所以企业也需要开展有限度的数据治理工作。数据驱动:业务数据的实时,准确,可视。数据安全体系(防攻击,防泄密,防特权)智能驱动:但如果应用场景不成熟,流程在线

我的笔记本虽然有nvidia独显,但为了更好的续航,平时会切换为intel集成显卡,需要AI计算时,才临时切换会nvidia独显。采用prime-select指令prime-select query 可以查询在用的显卡是哪一个sudo prime-select nvidia 切换nvidia独显sudo prime-select intel 切换intel集成显卡...

pytorch, tensorflow, onnx, tensorrt 格式的横向比较

v /disk/triton_models:/models 代表你的模型文件夹都要放在物理机的/disk/triton_models文件夹中(这个文件夹会mount到容器内部的/models里)代表使用显卡1(第二张显卡),triton并不会独占显卡,启动后,显卡仍然可以进行训练和其他任务(triton加载模型越多,显存占用越多,不需要的模型可以挪出文件夹)(--model-control-mod

道战略力,数字领导力,变革力战略力:变成企业必须做、大家一起做的共同战略变革力:变革的本质是对人的行为的重塑术流程驱动,数据驱动,智能驱动流程驱动:是聚焦业务重构数字化流程,从企业的角度来看,数据是不完整的。数据已经在随着业务的开展而逐步产生,所以企业也需要开展有限度的数据治理工作。数据驱动:业务数据的实时,准确,可视。数据安全体系(防攻击,防泄密,防特权)智能驱动:但如果应用场景不成熟,流程在线

背景:最近在建设linux统一开发服务器,用的是ubuntu16.04系统.由于开发人员需要使用docker,因此,需要做一个docker image给大家用.由于国家的网络限制问题,很难从dockerhub中下载到docker镜像,因此,委托同事下载了一个ubuntu14.04的docker镜像虽然,docker镜像是14.04,不是我们系统的16.04,但是,d

为什么要上gunicorn?flask自带的web容器不满足生产环境的要求。生产环境不能直接采用flask自带的web容器。gunicorn是目前应用较广的支持WSGI的web容器。gunicorn能否替代flask自带的web容器进行开发调试?可以,加入- -reload,则代码变更后,gunicorn会自动重启。gunicorn的worker选择gevent时的...

我们已经有了比较标杆的CI项目,需要将其变成JJB能使用的YAML文件。于是,找到了Jenkins Job Wrecker

每个docker容器会在/var/lib/docker/containers路径下产生自己的日志(信息比放射软件自身的logs文件夹更为齐全)。如果不对这些日志文件做切割,压缩处理,当软件长期运行后,将会出现日志文件过大的问题。在/etc/docker/daemon.json文件中,追加:"log-driver": "json-file","log-opts": {"max-size": "100