简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文指出,任何通过标准 “next token prediction” 训练得到的 LLM 内部已经隐含了一个通用奖励模型,其本质上等价于离线逆强化学习所得的奖励函数

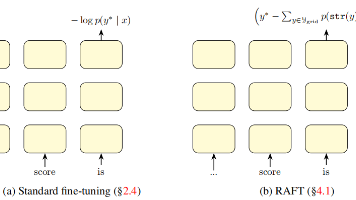

本文提出了回归感知微调(RAFT)方法,通过对候选数值的概率加权期望直接优化均方误差,将回归损失直接融入解码式LLM的训练中,从而同时保留自回归预训练的优势并利用数值目标的特性,在多项自然语言回归任务中显著优于传统交叉熵微调和预测头方法

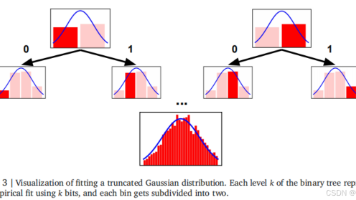

本文探讨了语言模型(LLM)在数值回归任务中的能力,证明了其可逼近任意一维概率密度的理论界,在数值范围大、噪声复杂或数据较少的情形相比传统点回归头和 Riemann 回归头有优势

最近组里配了电脑,性能比我的笔记本好不少,特别是一张 3080Ti 的显卡,如果不物尽其用就太可惜了。所以我拿到之后立马就装了向日葵远程软件,感觉还可以,但总是有点卡顿,没法拿来写代码什么的,最多看看程序运行情况今天一个同学教了我一下怎么用 vscode 连组里的服务器,顿时感觉很不错,通过一个插件的形式来连接,写程序就的感觉就和本地开发差不多,还能享受高性能,于是今晚折腾了几个小时也配了一套两边

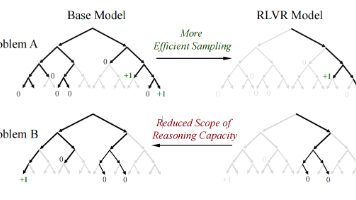

本文系统评估了 RLVR 在提升 LLM 推理能力方面的实际效果。发现当前RLVR方法主要提高了基座模型已有推理路径的采样效率,但并未创造新的推理模式。相比之下,蒸馏方法能真正扩展模型推理能力。研究呼吁开发新的RL范式,如改进探索机制、数据设计和反馈信号,以真正释放强化学习在扩展模型推理边界方面的潜力。

本文介绍如何使用 torchrun 框架改写 DDP 单机多卡并行代码,增强容错性和稳定性

本文说明重要结论:设模型参数量为 N,训练数据量(Token)为 D,LLM训练中计算量(FLOPs)C ≈ 6ND

总结微机原理课学习的若干芯片教材——《微机原理与接口技术》文章目录一、简介二、8255的内部结构及引脚信号(1)8255内部主要部件(2)8255引脚信号三、8255的工作方式1. 方式0 —— 基本的输入输出控制(1)说明:2. 方式1 —— 选通的输入输出(1)说明:(2)方式1下的输入组态:(3)方式1下的输出组态:3. 方式2 —— 双向的数据传送方式(1)说明:(2)组态逻辑四...

总结微机原理课学习的若干芯片教材——《微机原理与接口技术》文章目录〇、思维导图一、定时/计数 概述二、8253/8254 内部结构及引脚信号1. 主要功能2. 内部结构和外部引脚(1)结构图(2)组成三、8253/8254的工作方式1.方式0:中断信号发生器2.方式1:单稳负脉冲信号发生器3.方式2:速率信号发生器4.方式3: 方波信号发生器5.方式4:软件触发的选通...

Deep Reinforcement Learning from Human Preferences模仿学习 —— 逆向强化学习