简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

步骤1:基于TKernel创建算子工程创建算子描述文件,定义输入输出、属性及计算逻辑步骤2:编写算子实现代码在中实现自注意力计算的核心逻辑,利用昇腾矢量指令(如vaddvmul// 示例:自注意力QKV投影计算// 昇腾矢量指令加速矩阵乘法步骤3:编译与部署算子将编译生成的*.o文件注册到MindSpore算子库,完成自定义算子部署这是一张图片,ocr 内容为:优化效果实测。

步骤1:基于TKernel创建算子工程创建算子描述文件,定义输入输出、属性及计算逻辑步骤2:编写算子实现代码在中实现自注意力计算的核心逻辑,利用昇腾矢量指令(如vaddvmul// 示例:自注意力QKV投影计算// 昇腾矢量指令加速矩阵乘法步骤3:编译与部署算子将编译生成的*.o文件注册到MindSpore算子库,完成自定义算子部署这是一张图片,ocr 内容为:优化效果实测。

步骤1:基于TKernel创建算子工程创建算子描述文件,定义输入输出、属性及计算逻辑步骤2:编写算子实现代码在中实现自注意力计算的核心逻辑,利用昇腾矢量指令(如vaddvmul// 示例:自注意力QKV投影计算// 昇腾矢量指令加速矩阵乘法步骤3:编译与部署算子将编译生成的*.o文件注册到MindSpore算子库,完成自定义算子部署这是一张图片,ocr 内容为:优化效果实测。

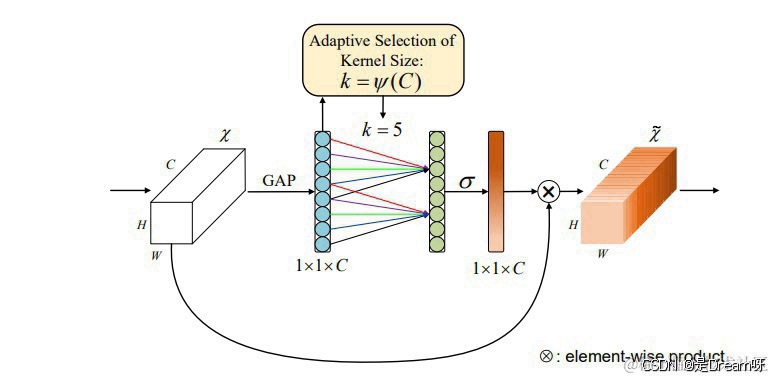

近年来,在提高深度卷积神经网络CNN的性能方面显示出了巨大潜力。然而,大多数现有方法致力于开发更复杂的注意力模块,以实现更好的性能,这不可避免地增加了模型的复杂性。为了克服性能与复杂性之间的矛盾,本论文提出了一种高效的通道注意力(ECA)模块,它仅涉及少量参数,但带来了显著的性能提升。通过剖析SENet中的通道注意力模块,我们从经验上表明,避兔维度缩减对于学习通道注意力很重要,适当的跨通道交互可以

GUI Agent 的意义,不只是让 AI 会点按钮。它代表的是一种更自然的自动化路径:不要求所有系统都为 AI 重做一遍接口,而是让 AI 学会适应已有的数字世界。在短期内,它会面对很多挑战,比如识别准确率、执行稳定性、流程泛化、权限安全、企业知识注入等。但从长期看,它很可能成为 Agent 生态中不可或缺的一环。因为现实世界不会为了 AI 一夜之间完成系统改造。大量遗留系统、封闭后台、复杂流程

实测中,画面画质高达8K,帧率最高可设置到360帧,色彩还原准确,动态画面无撕裂。完整支持Windows、macOS、Linux、Android、iOS、HarmonyOS及统信UOS、麒麟OS等国产系统,移动端虚拟触控板体验优秀。端到端加密模式,连接代码及密码是独一无二的,支持双重密码、临时密码、设备锁屏等多重验证。功能全面度无出其右:远程控制、文件传输、会议系统、AR支持、批量部署等。覆盖专业

通过这些实验,我们可以看到ASK-HAR模型在不同的HAR数据集上都展现出了卓越的性能。模型不仅在动态活动识别上表现出色,如“Walking”和“Running”,在静态活动识别上也有很好的效果,尽管对于一些特定的静态活动,如“Standing”,模型的性能还有待提高。此外,模型在处理一些复杂活动,如“ElevatorUp”和“ElevatorDown”,时也面临挑战。

随着人工智能技术的不断创新与普及,AI安全问题日益成为全球讨论的焦点。如何确保AI技术在带来社会变革的同时,不引发不良后果,是每个从业者和决策者必须面对的挑战。本次CCF-CV企业交流会汇聚了来自学术界、产业界的领先专家,共同探讨了AI安全领域的前沿技术和未来发展方向。通过深入的交流与探讨,会议展示了AI技术如何在保障安全性的同时,更好地服务于社会和人类的长远发展。相信通过政府、学术界和产业界的持

《大模型驱动软件测试》| 软件工程3.0时代,大模型驱动测试实战指南

从当前实现看,五款 DBLens 工具已经具备数据库客户端的主干能力,并在 AI 与 Agent 方向形成了清晰演进路径。MySQL 产品线是现阶段功能最完整的参考样本,MariaDB、PostgreSQL、MongoDB、SQLite 则分别围绕自身数据库特性做了连接、执行、导出和字典能力适配。对追求统一体验和效率提升的数据库用户而言,DBLens 值得进入工具选型清单。适合谁用开发者:接手新项