简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

子图计数(Subgraph Counting)是图分析中重要的研究课题。给定一个查询图 和数据图 , 子图计数需要计算 在 中子图匹配的(近似)数目。一般我们取子图匹配为子图同构语义,即从查询图顶点集 到数据图顶点集 的单射 ,保持拓扑关系(当查询图存在边 时,数据图中对应点也需要有连边 )和标签(查询图顶点 和数据图中对应点 标签相同)不变。

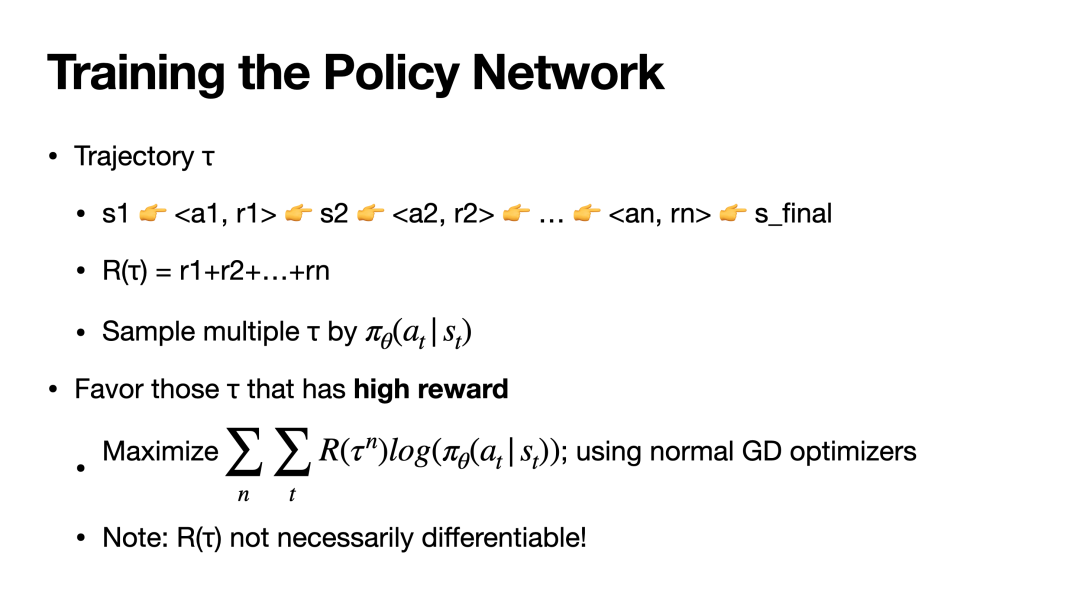

在最近取得广泛关注的大规模语言模型(LLM)应用强化学习(RL)进行与人类行为的对齐,进而可以充分理解和回答人的指令,这一结果展现了强化学习在大规模NLP的丰富应用前景。本文介绍了LLM中应用到的RL技术及其发展路径,希望给读者们一些将RL更好地应用于大规模通用NLP系统的提示与启发。

北京大学 李荆编者按:原文《Foundations and modelling of dynamic networks using Dynamic Graph Neural Networks: A survey》介绍一篇关于动态图上的神经网络模型的综述,本篇综述的主要结构是根据动态图上进行表示学习过程的几个阶段(动态图表示、模型学习、模型预测)进行分别阐述。包括1. 系统的探讨不同维度下的动态图分

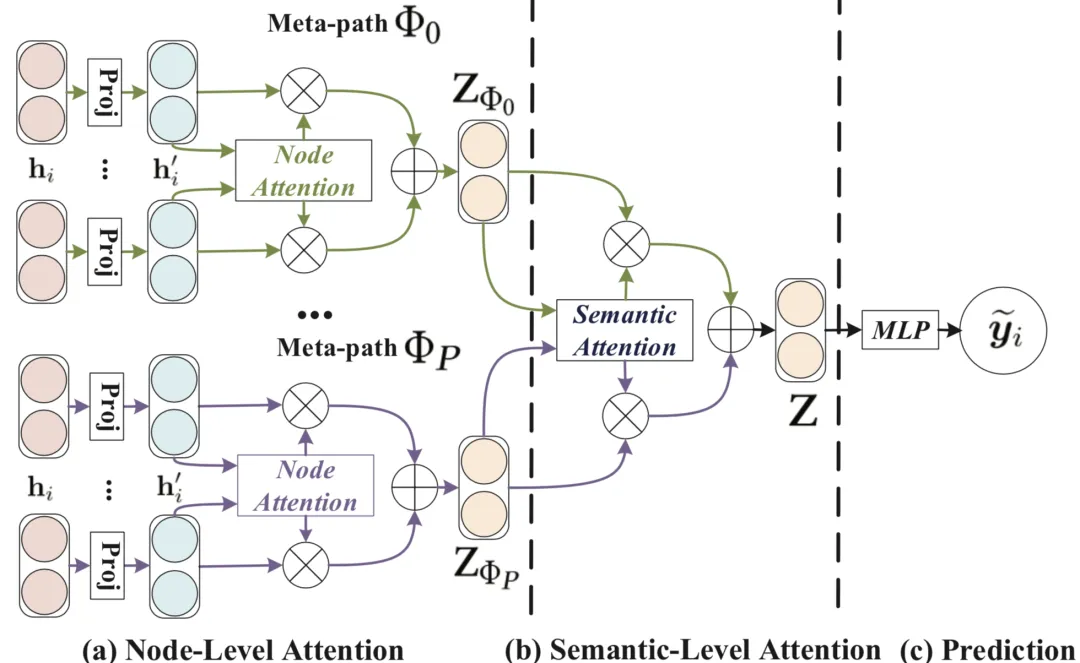

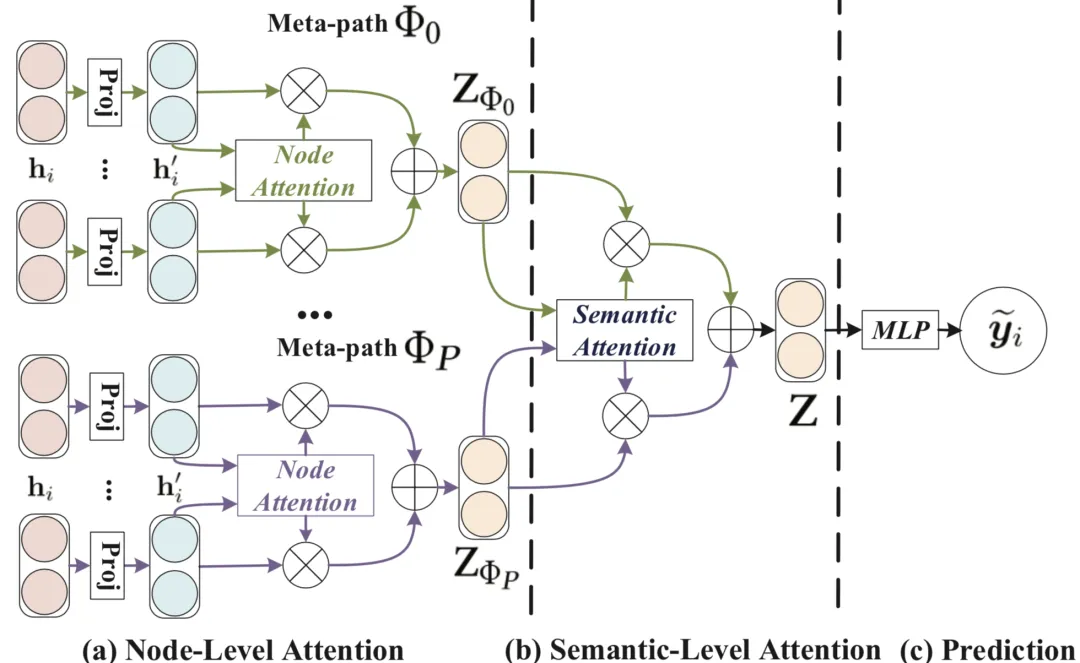

近年来,图神经网络(Graph Neural Networks, GNNs)已成为图挖掘研究的核心,研究人员开始关注其在异构图方面的潜力。异构图由多种类型的节点和边构成,且带有不同的辅助信息,这将新颖有效的图学习算法与嘈杂复杂的工业场景(如推荐系统)联系起来。在异构信息网络中,各类节点的嵌入空间通常不同。不同节点对之间以及相同节点对之间,都存在着各种各样的关系。

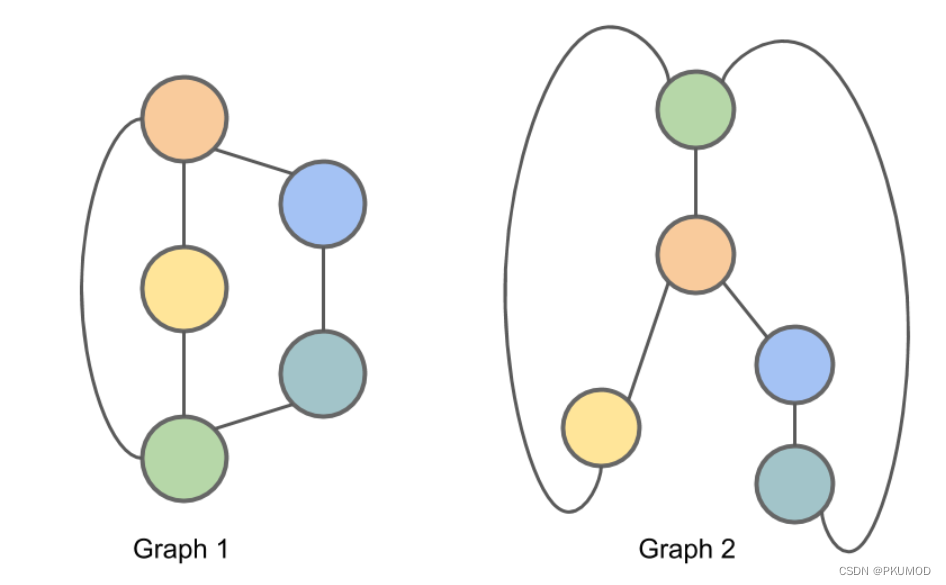

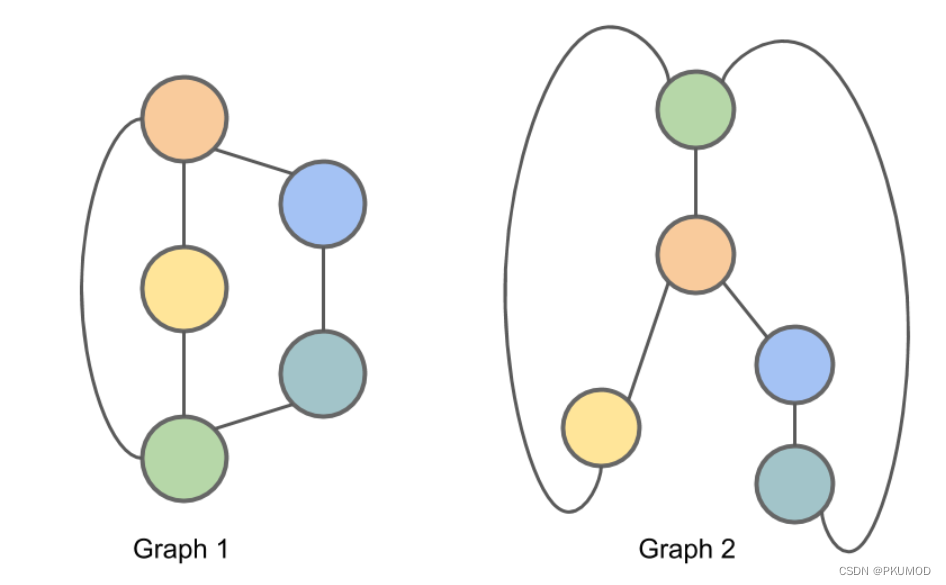

我们首先介绍图的同构问题。给定两个图GVGEGHVHEHGVGEGHVHEH,如果存在一个映射πVG→VHπVG→VHst∈EG⟺πsπt∈EHst∈EG⟺πsπt))∈EH那么GHG,HGH就是同构的,记作G≃HG\simeq HG≃H,且称π\piπ是图GGG和HHH的一个同构。

关系型数据库基础模型研究取得重要进展,从单表处理的TabPFN到跨表学习的Griffin,再到实现零样本预测的RelationalTransformer,三大突破性工作推动该领域快速发展。TabPFN通过合成数据预训练在单表任务表现优异;Griffin将数据库建模为图结构,实现跨表特征融合;RT创新性采用单元格级分词和关系注意力机制,实现异构模式间的零样本泛化。这些研究显著提升了模型通用性,为降低

近年来的嵌入表示学习方法,如平移距离模型、张量分解模型、神经网络模型等,通过将知识图谱中的实体和关系映射到低维稠密向量并保持其结构和属性特征,可用于链接预测、实体分类、三元组分类等任务以解决知识图谱的完整性问题,是进行知识图谱质量控制的一种重要手段。这篇文章对知识图谱质量控制问题展开了广泛的综述,内容不仅包括质量控制的基本概念如问题、维度和指标,也涵盖了质量控制从评估、问题发现到质量提升的全流程,

背景多模态大语言模型(MLLM)以大语言模型(LLM)为基础,能同时处理图像与文本等多种模态的信息。凭借强大的语言推理能力,MLLM在视觉问答、图像描述等任务中展现出了卓越的性能。然而,现有模型经常会出现幻觉(hallucination),即生成看似合理却并不正确的回答或描述。现有的MLLM幻觉原因主要可以分为两类,其一是模态偏差(bias),指模型可能出现“只依赖文本”或“只依赖图像”的倾向,从

我们首先介绍图的同构问题。给定两个图GVGEGHVHEHGVGEGHVHEH,如果存在一个映射πVG→VHπVG→VHst∈EG⟺πsπt∈EHst∈EG⟺πsπt))∈EH那么GHG,HGH就是同构的,记作G≃HG\simeq HG≃H,且称π\piπ是图GGG和HHH的一个同构。

近年来,图神经网络(Graph Neural Networks, GNNs)已成为图挖掘研究的核心,研究人员开始关注其在异构图方面的潜力。异构图由多种类型的节点和边构成,且带有不同的辅助信息,这将新颖有效的图学习算法与嘈杂复杂的工业场景(如推荐系统)联系起来。在异构信息网络中,各类节点的嵌入空间通常不同。不同节点对之间以及相同节点对之间,都存在着各种各样的关系。