简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

1. 要解决什么问题?主要解决以下两类分类问题:第一类,分类数量较少,每一类的数据量较多,比如ImageNet、VOC等。这种分类问题可以使用神经网络或者SVM解决,只要事先知道了所有的类。第二类,分类数量较多(或者说无法确认具体数量),每一类的数据量较少,比如人脸识别、人脸验证任务。2. 文章创新点解决以上两个问题,本文提出了以下解决方法:提出了一种思路:将输入映射为一个特...

对于动态场景来说,从一组不同曝光的图像中生成高动态范围(HDR)图像是一个具有挑战性的过程。这个问题可以分为两个阶段:1)对齐输入的LDR图像,2)合并对齐的图像到HDR图像。方法主要分为两类:一种直接基于LDR对齐融合,一种是先通过相机响应函数线性化这些输入图像(一般就是一个单调的非线性函数),将LDR图像转为HDR域,然后在HDR域进行融合得到HDR图像。另外一种是直接基于LDR(...

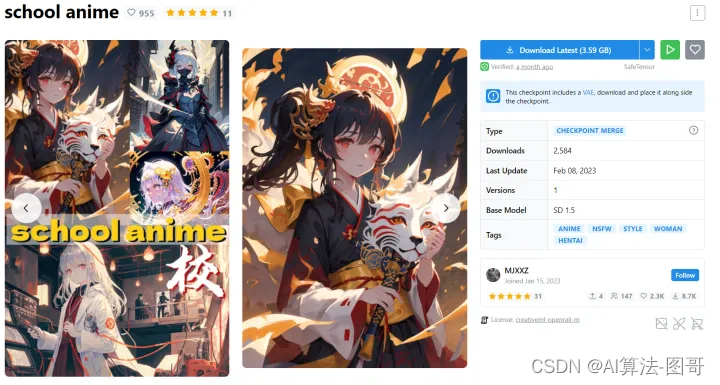

stable diffusion lora模型训练

1. 介绍本文介绍一个大规模的人脸识别数据集:WebFace260M,由 4M identities(身份)和 260M 人脸组成,为百万级深度人脸清洗和识别提供了很好的资源,如图1和Tab.1所示。又通过提纯,即所设计的可扩展高效的自训练 pipeline 对 WebFace260M 进行自动提纯,获得最大的训练集 WebFace42M,它在具有挑战性的 IJB-C 上得到新的SOTA,在 NI

对于动态场景来说,从一组不同曝光的图像中生成高动态范围(HDR)图像是一个具有挑战性的过程。这个问题可以分为两个阶段:1)对齐输入的LDR图像,2)合并对齐的图像到HDR图像。方法主要分为两类:一种直接基于LDR对齐融合,一种是先通过相机响应函数线性化这些输入图像(一般就是一个单调的非线性函数),将LDR图像转为HDR域,然后在HDR域进行融合得到HDR图像。另外一种是直接基于LDR(...

1. 背景直方图均衡化在图像增强方面有着很重要的应用。一些拍摄得到的图片,我们从其直方图可以看出,它的分布是集中于某些灰度区间,这导致人在视觉上感觉这张图的对比度不高。所以,对于这类图像,我们可以通过直方图均衡技术,将图像的灰度分布变得较为均匀,从而使得图像对比度增大,视觉效果更佳。2. 原理直方图均衡化的作用是图像增强。有两个问题比较难懂,一是为什么要选用累积分布函数,二是为什么使用累积分布函数

1. 背景训练集全是16x16,32x32之类的小图,达到上千万张,训练时发现数据加载很慢很慢很慢!!!看了下CPU 内存 GPU使用情况,发现CPU使用率都跑到90%去了,GPU使用率却较低2. 解决方法2.1 预处理提速尽量减少每次读取数据时的预处理操作,可以考虑把一些固定的操作,例如 resize ,事先处理好保存下来,训练的时候直接拿来用Linux上将预处理搬到GPU上加速:NVIDIA/

参考:Data Augmentation | How to use Deep Learning when you have Limited Data—Part 2文章目录1. 数据增广(Data Augmentation)2. 数据增广方法2.1 镜像(Flip)2.2 旋转(Rotation)2.3 缩放(Scale)2.4 裁剪(Crop)2.5 平移(Translation)2.6 高斯..

1. Pytorch分类器网络# 定义一个简单的分类网络class SimpleNet(nn.Module):def __init__(self):super(SimpleNet, self).__init__()# 三个卷积层用于提取特征# 1 input channel image 90x90, 8 output channel image 44x44self.conv1 = nn.Seque

在编译opencv时,会碰到ippicv_2019_lnx_intel64_general_20180723.tgz这个文件下载超级慢的问题。那该怎么办呢?1. 手动下载ippicv_2019_lnx_intel64_general_20180723.tgz下载地址保存路径随意,我是放在默认的下载路径 ~/DownLoad/2. 修改opencv里相关配置文件# 打开终端,输入ged...