简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Ollama本地api调用,调用Ollama对外提供的api?你可以直接用 Python、JavaScript 等主流编程语言调用 Ollama API,将其集成到你的 Web 应用、聊天机器人或者自动化脚本中。

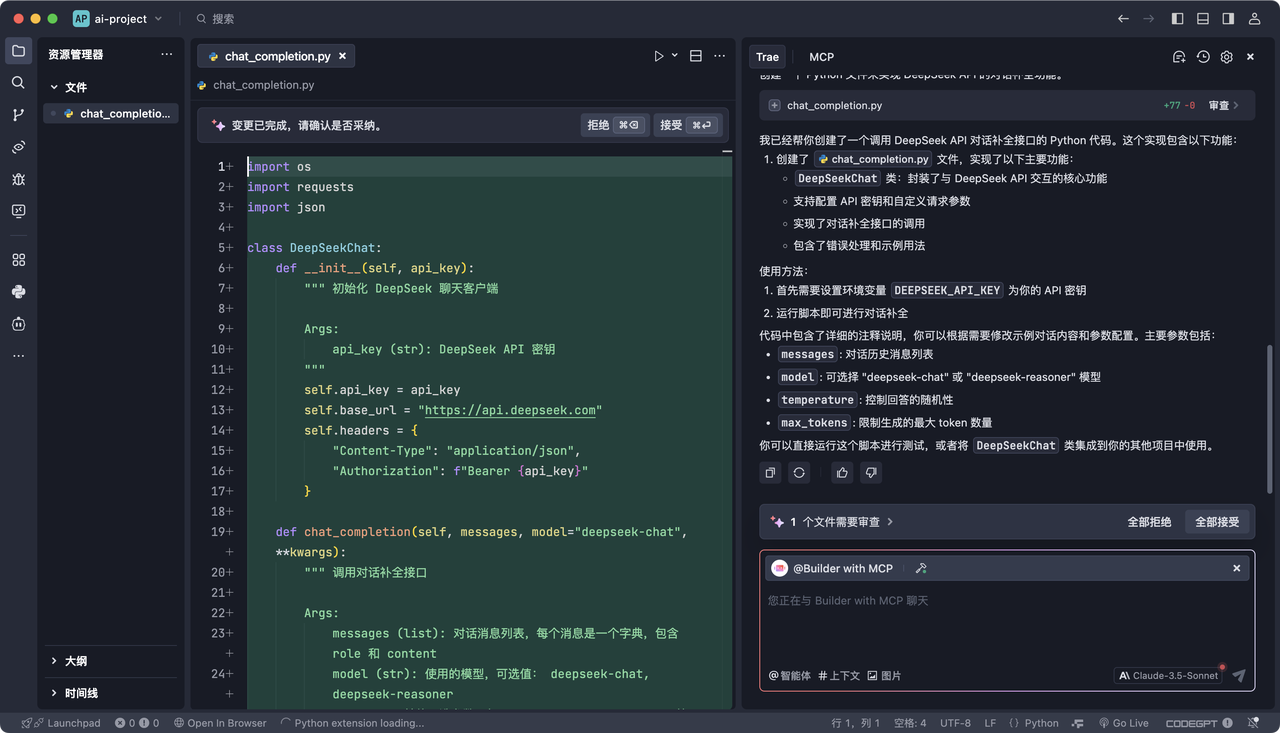

本教程详细介绍了如何获取和使用 DeepSeek API 密钥进行调试。通过指定不同的模型参数,可以调用 DeepSeek 的不同版本:使用 model='deepseek-chat' 调用 DeepSeek-V3,或使用 model='deepseek-reasoner' 调用 DeepSeek-R1。教程还提供了图文并茂的详细步骤,帮助用户快速上手。更多详细内容可参考提供的链接。

本文介绍了如何通过API调用Google的Gemini系列AI模型(包括gemini-3-pro和gemini-3-flash)。教程详细说明了获取API密钥、安装SDK等准备工作,并提供了Node.js环境下的JavaScript代码示例。两种模型的调用方式相似,仅需修改模型名称参数即可切换使用。文章还解释了不同模型版本的区别,指导开发者根据需求选择合适的模型进行开发测试或生产部署。

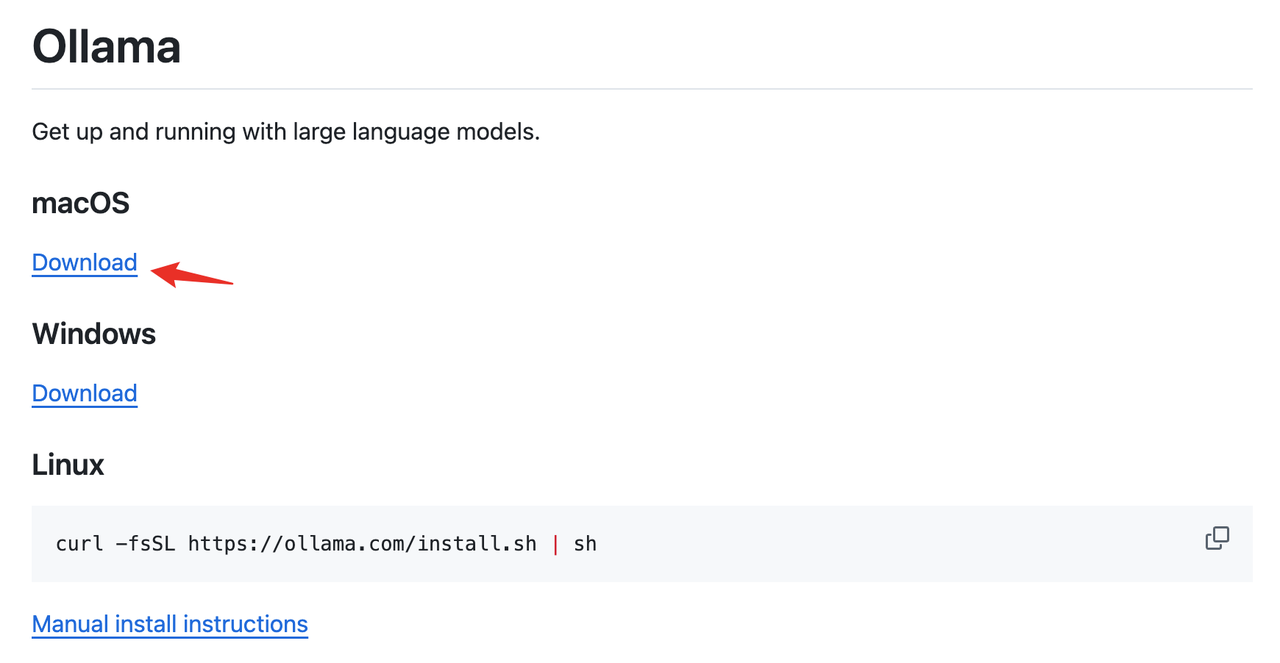

本文详细介绍了如何利用 Ollama 工具在本地下载、安装和运行开源AI大模型(如 DeepSeek-R1、Llama3.2 等),分步骤讲解了从 Ollama 安装、模型下载、命令行对话到 API 调试的全过程,为实现高效便捷的 AI 互动应用提供了完整指南。使用 Ollama 在本地部署 AI 大模型: 安装、部署和 API 调用的分步指南。

在Trae的聊天框中,点击"智能体"选项,然后选择"Builder with MCP"模式。添加MCP服务:可从内置MCP市场选择现有服务,或手动添加配置信息(如。在Trae界面右上角找到并点击"AI侧栏"按钮,展开AI辅助功能区。现在可以开始使用MCP功能,通过AI助手查询接口文档或生成相关代码。进入MCP设置界面:点击设置图标,然后选择"MCP"选项。首先确保Trae已更新至最新版本,以支持M

本文介绍了如何通过API调用Google的Gemini系列AI模型(包括gemini-3-pro和gemini-3-flash)。教程详细说明了获取API密钥、安装SDK等准备工作,并提供了Node.js环境下的JavaScript代码示例。两种模型的调用方式相似,仅需修改模型名称参数即可切换使用。文章还解释了不同模型版本的区别,指导开发者根据需求选择合适的模型进行开发测试或生产部署。

本文介绍了如何通过API调用Google的Gemini系列AI模型(包括gemini-3-pro和gemini-3-flash)。教程详细说明了获取API密钥、安装SDK等准备工作,并提供了Node.js环境下的JavaScript代码示例。两种模型的调用方式相似,仅需修改模型名称参数即可切换使用。文章还解释了不同模型版本的区别,指导开发者根据需求选择合适的模型进行开发测试或生产部署。

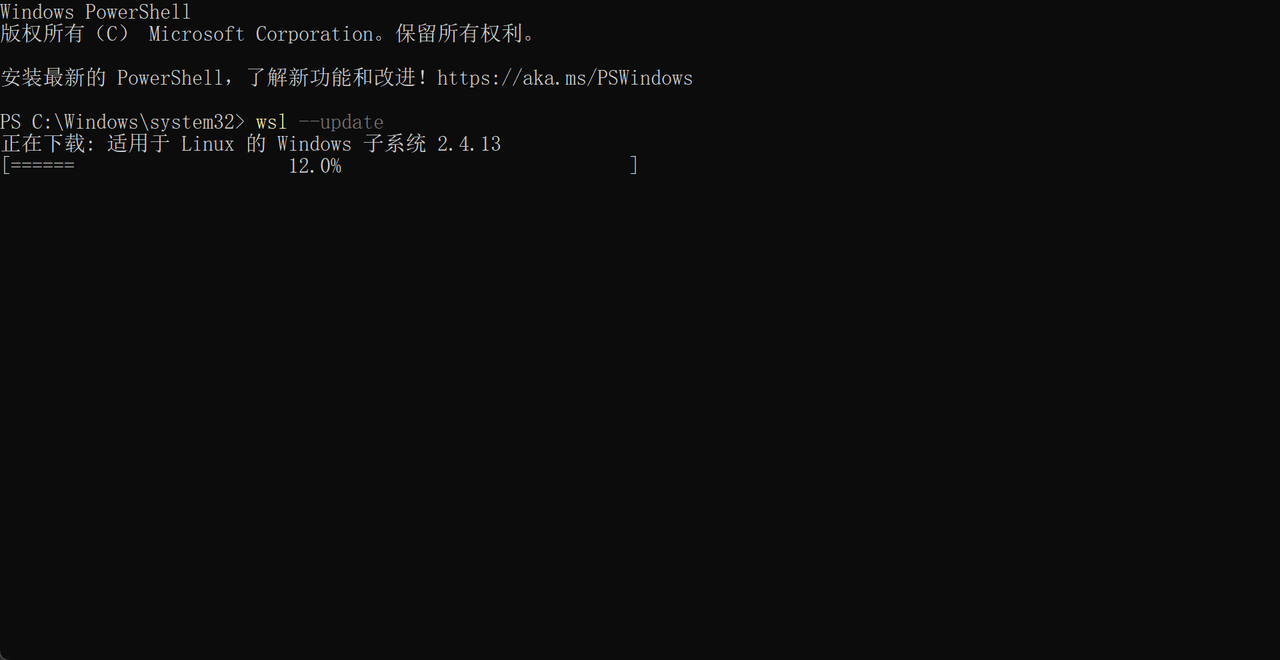

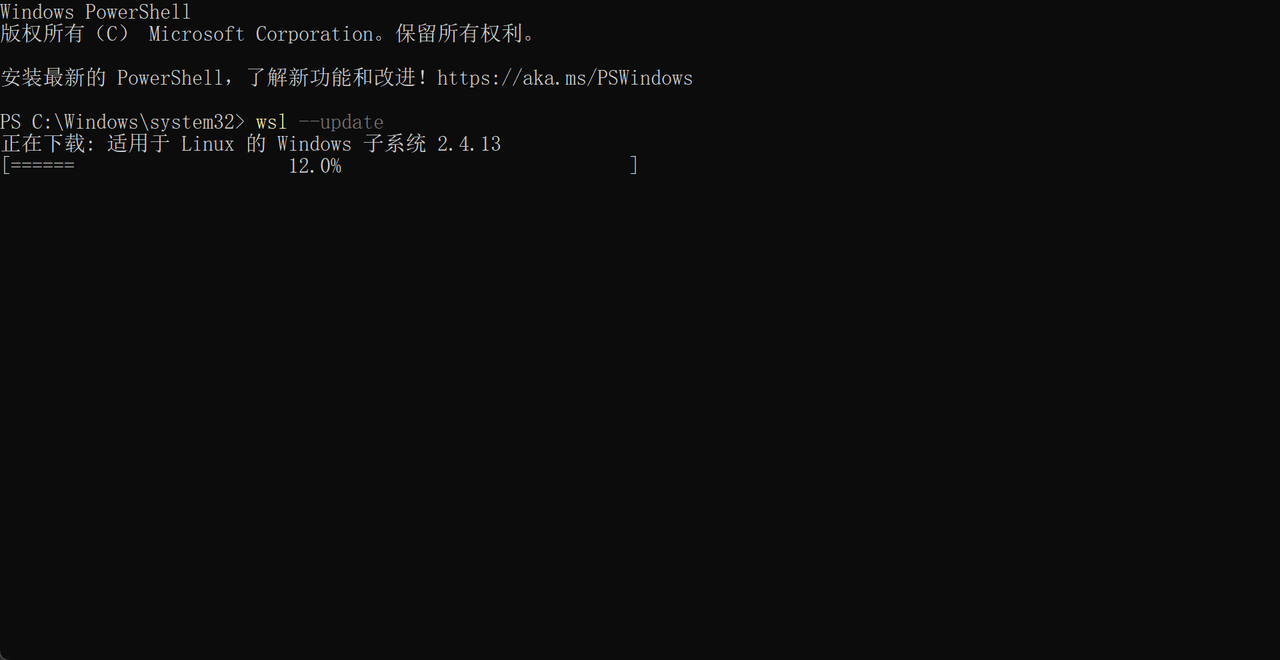

在 Windows 系统上安装或启动 Docker Desktop 时,可能会遇到“WSL update failed”的错误提示。这通常是由于 WSL(Windows 子系统 Linux)组件未正确更新或配置异常所致。解决方法很简单:以管理员身份打开 PowerShell,输入命令 wsl --update 即可手动更新 WSL。此操作通常能有效解决问题,确保 Docker Desktop 正常

在 Windows 系统上安装或启动 Docker Desktop 时,可能会遇到“WSL update failed”的错误提示。这通常是由于 Windows 子系统 Linux(WSL)组件未正确更新或配置异常所致。解决此问题的方法很简单:只需以管理员身份打开 PowerShell,并输入命令 wsl --update 即可手动更新 WSL。通过这一步骤,用户可以顺利解决 Docker Des

LLMs.txt是一个 Markdown 格式的文本文件,放在网站根目录,里面索引了网站内所有可供 LLM(大模型)处理的 Markdown 页面。此外,它还可简要描述每个页面内容、用途以及相关属性。,即可打开 Markdown 版本。这样,AI 助手读取内容时无需解析复杂网页,只需聚焦精炼的信息,大幅提升响应速度和理解力。目前已支持使用 llms.txt,你可以在“在线文档”中使用,例如。如果访