简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

OpenCL内核性能优化8 内核性能优化8.1 内核融合或分裂8.2编译器选项8.3 Conformant vs. fast vs. vs. native math functions8.4循环展开8.5 避免分支8.6 处理图像边界8.7 32位与64位GPU内存访问8.8 避免使用size_t8.9 通用内存地址空间8.10 其它8 内核性能优化本节介绍有关内核优化的技巧。8.1 内核融合或分

高通骁龙 X2 Elite 的 18 核 Oryon CPU + 85 TOPS Hexagon NPU + 超低功耗设计,让它成为运行 AI 智能体的理想移动平台。Hermes Agent 作为一个自我进化、多模型、多平台的开源智能体框架,与 X2 Elite 的 ARM64 原生环境完美搭配——无论是本地 AI 推理、远程智能体服务,还是无人值守的自动化工作流,都能在一台轻薄本上高效完成。

在高通骁龙 Snapdragon X2 Elite 上安装 Hermes Agent是RM AI PC 的智能体新范式。

摘要 本文详细介绍了基于Llama 2 7B的任务规划引擎实现,包含: 任务分解与规划:通过LLM将自然语言指令转换为结构化JSON任务链 多模态集成:支持语音交互(Whisper ASR + TTS)和视觉查询(VLM) 技能执行框架:定义9种原子技能(导航/抓取/搜索等)及其执行逻辑 容错机制:支持3次重试和规则回退方案 完整示例:演示"去厨房拿水"的端到端执行流程(45秒闭环) 核心代码展示

摘要 本文详细介绍了基于Llama 2 7B的任务规划引擎实现,包含: 任务分解与规划:通过LLM将自然语言指令转换为结构化JSON任务链 多模态集成:支持语音交互(Whisper ASR + TTS)和视觉查询(VLM) 技能执行框架:定义9种原子技能(导航/抓取/搜索等)及其执行逻辑 容错机制:支持3次重试和规则回退方案 完整示例:演示"去厨房拿水"的端到端执行流程(45秒闭环) 核心代码展示

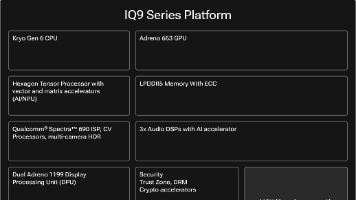

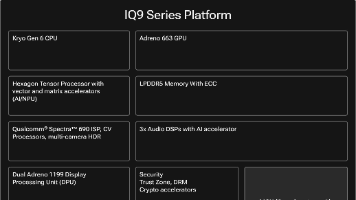

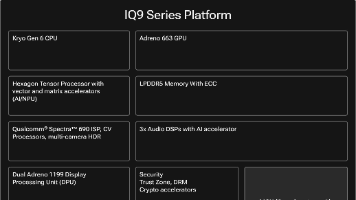

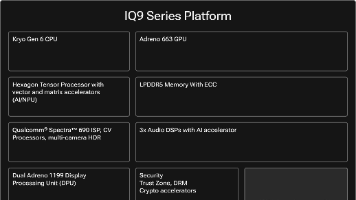

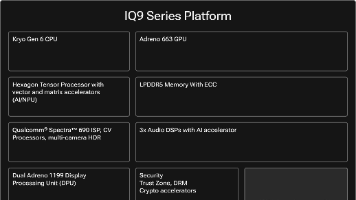

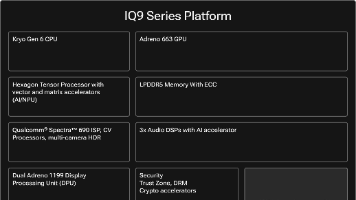

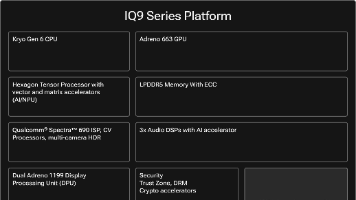

摘要: 本文探讨如何通过端侧多模态大模型赋予机器人“理解”人类意图的能力,基于高通跃龙IQ-9100平台(100 TOPS NPU)部署视觉语言模型(VLM),实现场景理解与任务分解。传统机器人依赖预编程规则,而具身智能体通过大模型(如Llama 2 7B)自主解析复杂指令,结合导航、抓取等底层技能完成任务。端侧部署在延迟、隐私和可靠性上优于云端方案。系统架构涵盖多模态输入、VLM场景理解、LLM

摘要: 本文探讨如何通过端侧多模态大模型赋予机器人“理解”人类意图的能力,基于高通跃龙IQ-9100平台(100 TOPS NPU)部署视觉语言模型(VLM),实现场景理解与任务分解。传统机器人依赖预编程规则,而具身智能体通过大模型(如Llama 2 7B)自主解析复杂指令,结合导航、抓取等底层技能完成任务。端侧部署在延迟、隐私和可靠性上优于云端方案。系统架构涵盖多模态输入、VLM场景理解、LLM

本文提出了一种基于Eye-in-Hand手眼标定和MoveIt 2运动规划的机器人抓取系统。首先采用AX=XB模型完成相机到机械臂末端的手眼标定,通过采集15-20个不同位姿的标定板数据求解变换矩阵。随后基于MoveIt 2开发了状态机驱动的抓取管理器,实现预抓取、精确抓取、提升和返回等完整动作序列。系统通过协调视觉检测、运动规划和夹爪控制,实现了高效的物体抓取操作。实验结果表明该方法能有效完成手

本文提出了一种基于Eye-in-Hand手眼标定和MoveIt 2运动规划的机器人抓取系统。首先采用AX=XB模型完成相机到机械臂末端的手眼标定,通过采集15-20个不同位姿的标定板数据求解变换矩阵。随后基于MoveIt 2开发了状态机驱动的抓取管理器,实现预抓取、精确抓取、提升和返回等完整动作序列。系统通过协调视觉检测、运动规划和夹爪控制,实现了高效的物体抓取操作。实验结果表明该方法能有效完成手

本文基于高通跃龙IQ-9100工业机器人平台,开发了一套完整的视觉引导抓取系统。系统采用"眼-手"协作架构,利用NPU加速的YOLOv8n-seg模型实现目标检测与实例分割,结合深度图进行抓取姿态估计。通过手眼标定建立视觉与机械臂的坐标映射,使用MoveIt2进行运动规划和碰撞避免,最终通过CAN-FD接口驱动6-DOF机械臂完成精准抓取。文章详细介绍了系统架构、硬件配置及基于