简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

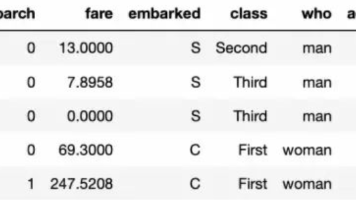

学习pandas时候如果没有合适的数据集,可以用一些自带的数据集做数据分析。seaborn是个非常好用的数据分析包,其中包含了非常多的自带数据集,这些数据集存放在线上github中,用户load时自动从网络中加载,返回pandas的dataframe对象。

AST 就是“把 RTL 源码翻译成一棵树形的语法/语义表示”,它仍然保留modulealwaysif<=这些源码层次;它还不是电路网表,但已经让综合前端可以系统地做 simplify、符号解析、位宽解析,再继续降成 RTLIL、mux/dff 和 AIG。

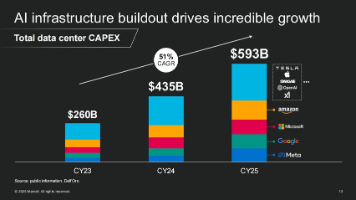

事实上,尽管目前英伟达依然保持着AI芯片中的超然地位,但谷歌、亚马逊和微软等主要云巨头正在加速推动自研芯片开发计划,力图在英伟达解决方案之外实现多元化发展。而在这些云巨头自研芯片背后的真正受益者,就是博通与Marvell。有意思的是,博通和 Marvell 在定制AI领域采用了截然不同的发展战略。博通优先考虑大规模集成和平台设计,并以大量的研发投入和先进的技术集成为后盾。而 Marvell 则通过

只需要把它们放到 Claude Desktop 的配置里,你的 Claude 就能瞬间学会“查你的资料”这个技能了。

底层用 MCP:先把公司里的数据库、Slack、Jira 全部变成 MCP Server,让 AI 能连得上。中间层用 Skills:编写各种 Skills(如“自动报修 Skill”、“周报生成 Skill”),把业务逻辑教给 AI。顶层用 A2A:搞一堆不同角色的 Agent(客服、运维、财务),用 A2A 协议把它们连成一个网,让它们自己开会解决问题。

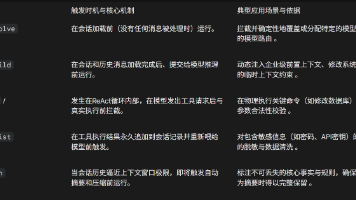

人工智能系统正在经历从“被动响应的聊天机器人(Chatbot)”向“能够自主推理、规划并操作物理与数字环境的自主智能体(Autonomous Agent)”的根本性范式转变。在这一技术演进的浪潮中,OpenClaw作为一个在2026年初短短六十天内迅速突破15.7万GitHub Star的开源智能体网关平台,提供了一个极具代表性且被广泛验证的工业级参考架构。

人工智能系统正在经历从“被动响应的聊天机器人(Chatbot)”向“能够自主推理、规划并操作物理与数字环境的自主智能体(Autonomous Agent)”的根本性范式转变。在这一技术演进的浪潮中,OpenClaw作为一个在2026年初短短六十天内迅速突破15.7万GitHub Star的开源智能体网关平台,提供了一个极具代表性且被广泛验证的工业级参考架构。

人工智能系统正在经历从“被动响应的聊天机器人(Chatbot)”向“能够自主推理、规划并操作物理与数字环境的自主智能体(Autonomous Agent)”的根本性范式转变。在这一技术演进的浪潮中,OpenClaw作为一个在2026年初短短六十天内迅速突破15.7万GitHub Star的开源智能体网关平台,提供了一个极具代表性且被广泛验证的工业级参考架构。

人工智能系统正在经历从“被动响应的聊天机器人(Chatbot)”向“能够自主推理、规划并操作物理与数字环境的自主智能体(Autonomous Agent)”的根本性范式转变。在这一技术演进的浪潮中,OpenClaw作为一个在2026年初短短六十天内迅速突破15.7万GitHub Star的开源智能体网关平台,提供了一个极具代表性且被广泛验证的工业级参考架构。

芯片间接口是一种功能模块,用于在同一封装内组装的两个硅芯片之间提供数据接口。芯片间接口利用极短的通道连接封装内的两个芯片,从而实现远超传统芯片间接口的功率效率和极高的带宽效率。芯片间接口通常由物理层 (PHY) 和控制器模块组成,可在两个芯片的内部互连结构之间提供无缝连接。芯片间 PHY 采用高速 SerDes 架构 或高密度并行架构实现,这些架构经过优化,可支持多种先进的 2D、2.5D 和 3