简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

目录本章导读1.机器学习概率2.Spark MLlib总体设计3.数据类型3.1局部向量3.2标记点3.3局部矩阵3.4分布式矩阵4.基础统计4.1摘要统计4.2相关统计1.皮尔森相关系数2.斯皮尔森秩相关系数4.3分层抽样4.4假设校验4.5随机数生成5. 分类和回归5.1数学公式5.2线性回归1.简单线性回归2.多元线性回归5.3分类1.线性支持向量机2.逻辑回归...

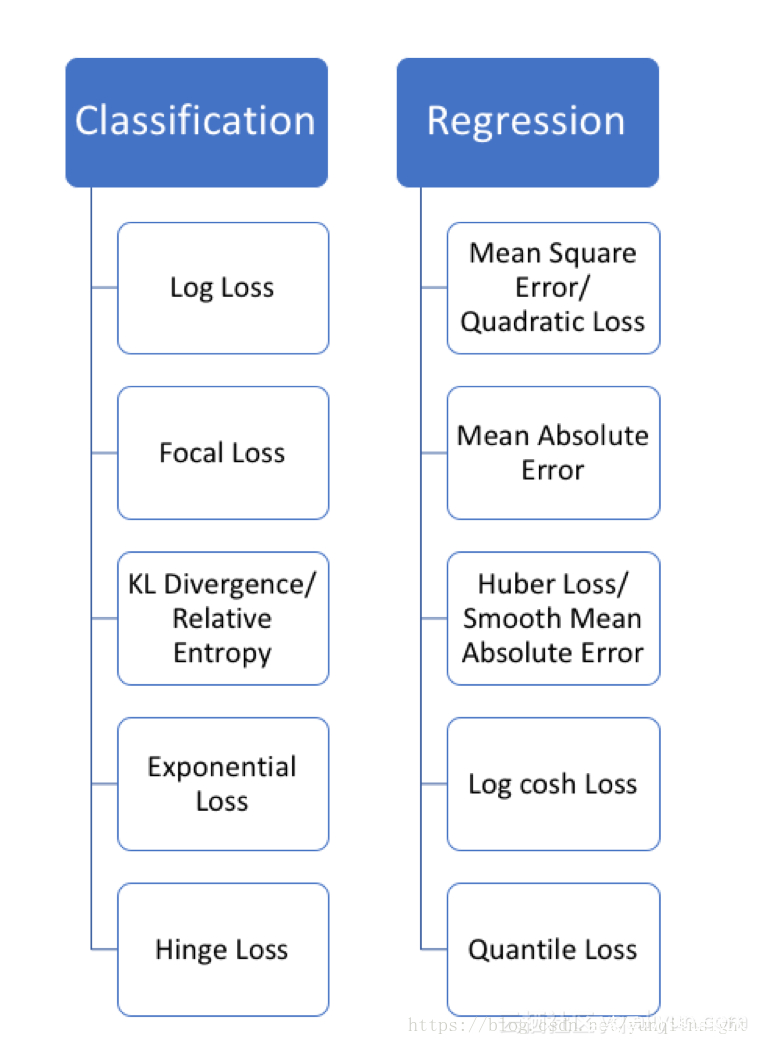

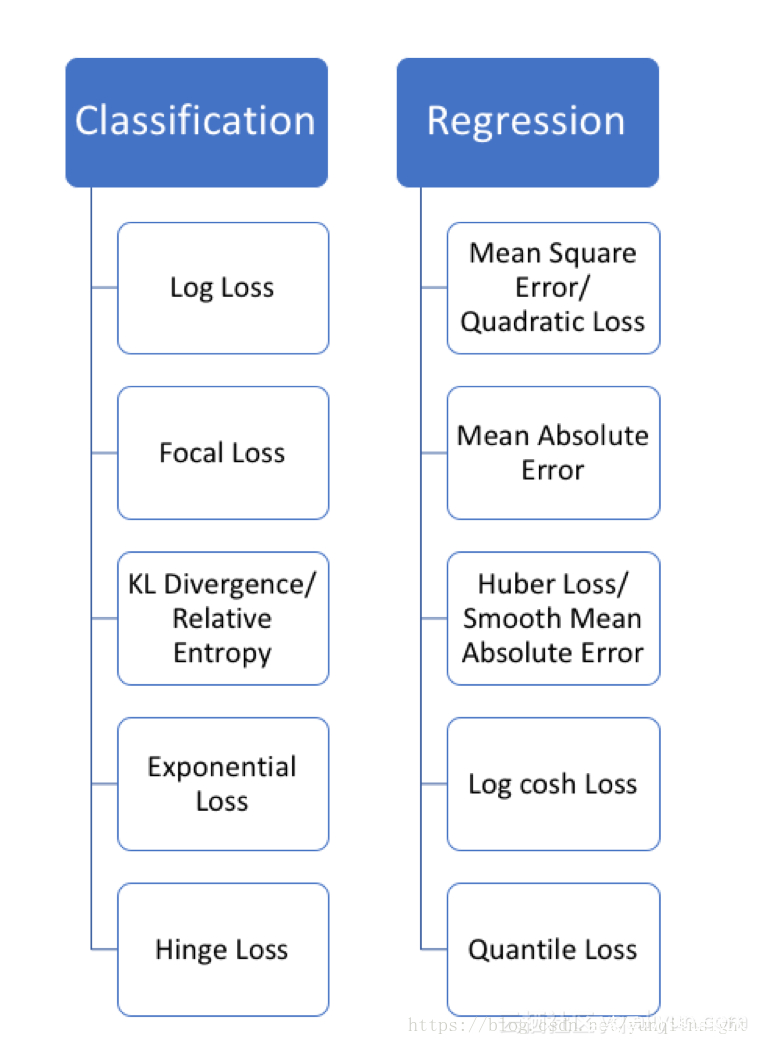

深度学习(tensorflow)中的所有学习算法都必须 有一个 最小化或最大化一个函数,称之为损失函数(loss function),或“目标函数”、“代价函数”。损失函数是衡量模型的效果评估。损失函数严格上可分为两类:分类损失和回归损失,其中分类损失根据类别数量又可分为二分类损失和多分类损失。在使用的时候需要注意的是:回归函数预测数量,分类函数预测标签。

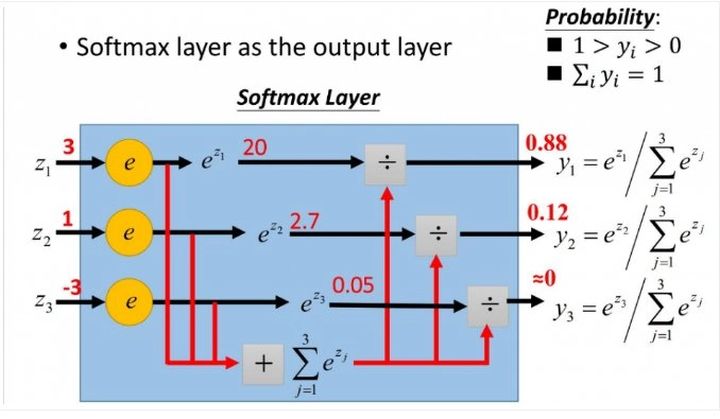

多分类任务损失函数:多分类问题一般用softmax作为神经网络的最后一层,然后计算交叉熵损失。TensorFlow中的tf.nn.softmax_cross_entropy_with_logits函数可以直接计算多分类损失。

在很多机器学习和深度学习的应用中,我们发现用的最多的优化器是 Adam,为什么呢?下面是 TensorFlow 中的优化器https://www.tensorflow.org/api_guides/python/train在 keras 中也有 SGD,RMSprop,Adagrad,Adadelta,Adam等:https://keras.io/optimizers/我...

由于最近公司需要,所以赶紧转载一篇一. 简介 首先来看百度百科对最小二乘法的介绍:最小二乘法(又称最小平方法)是一种数学优化技术。它通过最小化误差的平方和寻找数据的最佳函数匹配。利用最小二乘法可以简便地求得未知的数据,并使得这些求得的数据与实际数据之间误差的平方和为最小。最小二乘法还可用于曲线拟合。其他一些优化问题也可通过最小化能量或最大化熵用最小二乘法来表达。 简而言之,最小二乘法同梯度

RMSERoot Mean Square Error,均方根误差是观测值与真值偏差的平方和与观测次数m比值的平方根。是用来衡量观测值同真值之间的偏差MAEMean Absolute Error ,平均绝对误差是绝对误差的平均值能更好地反映预测值误差的实际情况.标准差Standard Deviation ,标准差是方差的算数平方根是用来衡量一组数自身的离散程度...

混淆矩阵是除了ROC曲线和AUC之外的另一个判断分类好坏程度的方法。以下有几个概念需要先说明:TP(True Positive): 真实为0,预测也为0FN(False Negative): 真实为0,预测为1FP(False Positive): 真实为1,预测为0TN(True Negative): 真实为1,预测也为1:分类模型总体判断的准确率(包括了所有class的总体准确率): 预测为0

深度学习(tensorflow)中的所有学习算法都必须 有一个 最小化或最大化一个函数,称之为损失函数(loss function),或“目标函数”、“代价函数”。损失函数是衡量模型的效果评估。损失函数严格上可分为两类:分类损失和回归损失,其中分类损失根据类别数量又可分为二分类损失和多分类损失。在使用的时候需要注意的是:回归函数预测数量,分类函数预测标签。

项目中出现了二分类数据不平横问题,研究总结下对于类别不平横问题的处理经验:为什么类别不平横会影响模型的输出? 许多模型的输出类别是基于阈值的,例如逻辑回归中小于0.5的为反例,大于则为正例。在数据不平衡时,默认的阈值会导致模型输出倾向与类别数据多的类别。因此可以在实际应用中,解决办法包括:1)调整分类阈值,使得更倾向与类别少的数据。2)选择合适的评估标准,比如ROC或者F1,...

前言最近在看自动文摘的论文,之前对Rouge评测略有了解,为了更好的理解Rouge评测原理,查了些资料,并简单总结。关于RougeRouge(Recall-Oriented Understudy for Gisting Evaluation),是评估自动文摘以及机器翻译的一组指标。它通过将自动生成的摘要或翻译与一组参考摘要(通常是人工生成的)进行比较计算,得出相应的分值,以衡量自动生成的摘要或翻译