简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

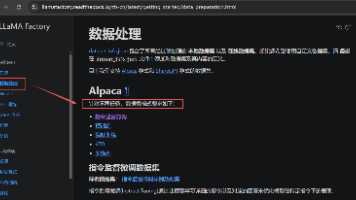

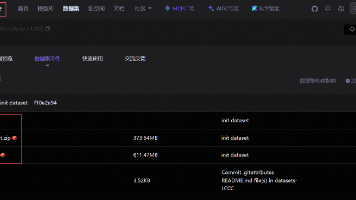

接下来使用弱智吧的数据集微调我自己的模型,首先得给它做个配置:找到data目录里面有一个,然后我们就模仿人家配数据的方式,把我们自己的数据给它配进去:我们把identity东西我们拷贝一份儿。拷贝一份儿,然后给它粘过来找到弱智吧数据路径,给它把填到file_name里面进入到根目录,启动在启动页面我们就可以看到刚才的数据集了。Llama factory支持增加多套数据同时做训练。比如说可以选两个数

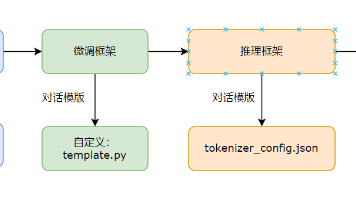

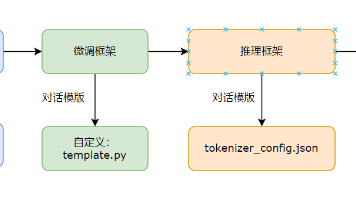

各阶段使用的对话模版如下:由于微调框架修改了大模型,故后续都要以微调框架的对话模版为主!!!vllmvllm默认使用大模型自带的对话模版,若要使用自动以的对话模版,需要添加参数。利用现有对话模板,直接配置一个如下的json文件使用。model_name为必填项,可以是LMDeploy内置对话模板名(通过可查阅),也可以是新名字。其他字段可选填。当model_name是内置对话模板名时,json文件

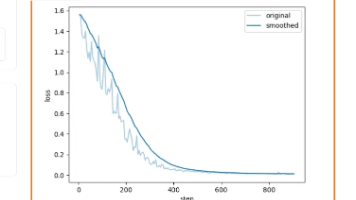

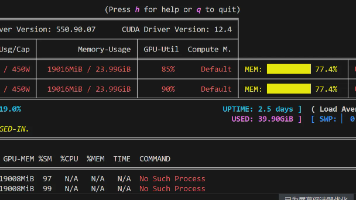

我们在训练模型的时候,批次越大,模型训练的越快、效果越好,但是如果模型的参数固定是16位的情况下,微调批次batch一般不会设置很大。为了加速模型训练,可以用8位或者4位来替代训练过程中16位的运算,当我们把16位降到8位或者降到4位的时候,显存占用就降低了,批次就可以调整更大,模型训练起来就会更快。这种训练方式并没有改变模型的参数数量,只是降低了模型的计算精度而已。GGUF格式的全名为(),是由

Qwen-Agent是一个开发框架。充分利用基于通义千问模型(Qwen)的指令遵循、工具使用、规划、记忆能力。Qwen-AgentDashScope服务提供的Qwen模型服务支持通过OpenAI API方式接入开源的Qwen模型服务RAGAs。

各阶段使用的对话模版如下:由于微调框架修改了大模型,故后续都要以微调框架的对话模版为主!!!vllmvllm默认使用大模型自带的对话模版,若要使用自动以的对话模版,需要添加参数。利用现有对话模板,直接配置一个如下的json文件使用。model_name为必填项,可以是LMDeploy内置对话模板名(通过可查阅),也可以是新名字。其他字段可选填。当model_name是内置对话模板名时,json文件

特性全量微调参数高效微调(PEFT)局部微调更新参数范围全部参数新增的少量参数部分原始参数资源消耗非常高极低中等存储开销整个模型副本很小(仅需保存增量参数)整个模型副本灾难性遗忘风险高风险极低风险中等性能潜力可能最高通常接近全量微调取决于解冻层数易用性简单直接需要选择/配置方法(如LoRA)需要选择解冻层现代建议:对于大语言模型的微调,参数高效微调(PEFT),尤其是LoRA及其变体,已经成为事实

微软开源了一个分布式训练deepspeed框架,目前来讲,主流微调工具支持的分布式训练框架都是基于deepseed来实现的,这个框架的特点就是它支持千亿级参数模型的训练,基本上可以适配目前英伟达下面的主流显卡。deepspeed框架的核心目标是降低大模型训练成本,提升显存和计算效率。它其实基于PyTorch这个框架来构建的,支持库。[{# 单轮对话},# 多轮对话},}]单轮对话转换代码如下:#

我们提出了一个大型清洁汉语会话语料库(LCCCLCCC-base和LCCC-large。为了保证语料库的质量,设计了严格的数据清洗流水线。该管道涉及一组规则和几个基于分类器的过滤器。诸如攻击性或敏感词、特殊符号、表情符号、语法错误的句子和不连贯的对话等噪音都会被过滤掉。LCCC数据集包含large和base版本,large版本数据很大,基于base数据集选择1000到3000条数据作为样本的输入话

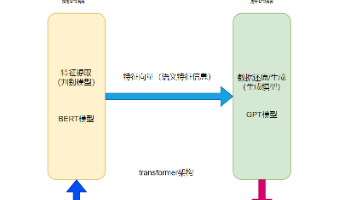

分词就是将连续的字序列按照一定的规范重新组合成词序列的过程。我们知道,在英文的行文中,单词之间是以空格作为自然分界符的,而中文只是字、句和段能通过明显的分界符来简单划界,唯独词没有一个形式上的分界符, 分词过程就是找到这样分界符的过程。举个例子:语句:无线电法国别研究分词:['无线电法', '国别', '研究']词作为语言语义理解的最小单元, 是人类理解文本语言的基础。因此也是AI解决NLP领域高

是一个开放的人工智能社区和平台,致力于提供方便易用的自然语言处理(NLP)模型和工具。它的核心价值在于通过快速访问海量预训练模型,并提供端到端的机器学习开发工具链,极大降低了构建智能应用的门槛。在架构上,包含模型库(Model Hub)、数据集库(Datasets)、训练工具(和)、推理部署方案等多个模块,彼此协同支持开发者从模型训练、微调到推理部署的全流程。