简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

本文详细介绍了在Ubuntu和CentOS系统上安装Docker的完整步骤,包括环境检查、旧版本卸载、源配置、安装及验证方法。同时讲解了Docker镜像仓库的结构与管理命令(login/pull/push/search/logout),以及常用镜像和容器操作指令。此外,还提供了搭建Nginx服务的实践示例,包括镜像选取、容器运行和页面修改。最后介绍了BusyBox工具的使用及如何将镜像推送到个人仓

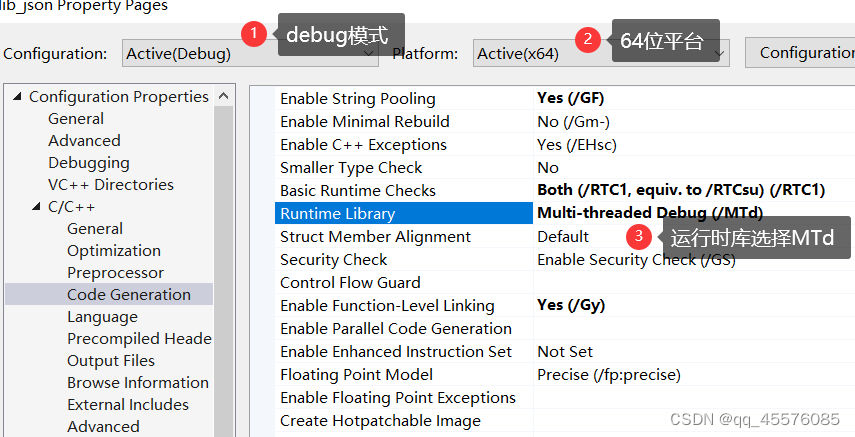

2、在解压文件的makefiles文件下有个vs71,在vs71中有visual studio项目,不过这里的项目是visual studio2008写的,这里打开之前需要升级。升级完成之后,选中lib_json文件夹进行配置,生成想要的库文件。将解压文件夹下的json文件夹拷贝至新建libjson文件下的include目录,下边是json文件的位置。配置运行时库类型,我刚刚生成库文件的时候选择的

本文详细介绍了在Ubuntu和CentOS系统上安装Docker的完整步骤,包括环境检查、旧版本卸载、源配置、安装及验证方法。同时讲解了Docker镜像仓库的结构与管理命令(login/pull/push/search/logout),以及常用镜像和容器操作指令。此外,还提供了搭建Nginx服务的实践示例,包括镜像选取、容器运行和页面修改。最后介绍了BusyBox工具的使用及如何将镜像推送到个人仓

本文摘要: 本文系统介绍了LangChain框架在构建大型语言模型(LLM)应用中的核心组件和关键技术。主要内容包括: 消息系统:详细解析了LLM消息结构,包括系统、用户、助理和工具四种角色消息,以及LangChain的统一消息格式。 对话管理:涵盖多轮对话实现、历史消息缓存策略,以及从RunnableWithMessageHistory到LangGraph持久化的演进。 提示工程:深入探讨提示词

大语⾔模型 (LLM) 在各种与语⾔相关的任务(例如⽂本⽣成、翻译、摘要、问答等)中表现出⾊。现代 LLM 通常通过聊天模型接⼝访问,该接⼝将消息列表作为输⼊(LangChain消息列表),并返回消息作为输出(AIMessage),而不是使 ⽤纯⽂本。这⾥需要注意LLM与 LangChain 中 聊天模型 的关系:•在 LangChain 的官方文档中,认为 LLM⼤多数是纯⽂本补全模型。这些纯⽂

大语言模型(LLM)原生接入存在六大核心问题:1)幻觉问题(输出不合理答案);2)提示词问题(输出结果受提示词影响);3)模型切换成本高(API强耦合);4)输出非结构化数据;5)无法获取实时信息;6)专业领域可信度不足。LangChain框架通过RAG技术、统一接口封装、结构化输出强制、实时工具集成及专业知识库查询等方式解决这些问题。针对复杂场景,LangGraph进一步提供图结构编排,支持循环