简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

长上下文泛化问题:算力、显存与无限注意力

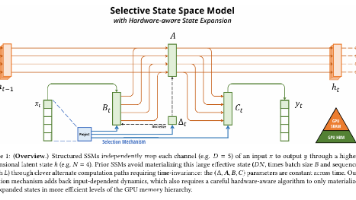

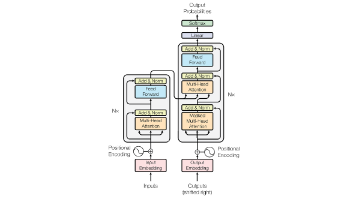

本文针对 2026 年大语言模型面临的“长上下文泛化 (Long-Context Generalization)”核心挑战进行了全景式技术复盘。文章首先剖析了长文本处理中普遍存在的 "Lost in the Middle" 现象及其背后的注意力退化机制;继而系统阐述了从 **RoPE** 旋转位置编码到 **YaRN** 频率内插,再到 **LongRoPE** 非均匀进化搜索的数学修正演进路径。

Transformer 时代的语言模型:大规模语言模型的发展脉络与技术演化

本文梳理了Transformer时代大规模语言模型(LLMs)的技术演进脉络。从2017年Transformer架构的提出开始,重点分析了关键技术创新:双向编码器BERT通过掩码语言建模实现深度理解;GPT-3证明模型规模与提示工程的协同效应;InstructGPT引入人类反馈强化学习(RLHF)实现指令对齐;LLaMA通过数据规模优化突破参数量限制;FlashAttention通过IO感知优化解

到底了