简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

数据通信概念

传统的时序预测方法,如 ARIMA、LSTM 等,虽然有较好的性能,但通常在处理复杂的、包含多种输入特征的时序数据时,表现不佳。TFT 是在 Transformer 的基础上进行了改进,专门针对多变量时序数据的建模需求,提出了一些新技术,使其更适合进行长时间序列的预测,尤其是在金融、医疗和工业领域等应用场景中。总体来说,TFT 结合了 Transformer 和传统时序建模技术的优点,是一个非常强

时间卷积神经网络(Temporal Convolutional Network,TCN)是一种具有时序特性的卷积神经网络,由Lea等人于2016年首次提出,起初应用于视频里动作的分割,后逐渐拓展到了一般性时序领域。TCN将一维全卷积网络、因果卷积和膨胀卷积结合在一起,具有稳定性更高,求解速度更快等优点。

众所周知,机器学习是一门跨学科的学科,主要研究计算机如何通过学习人类的行为和思维模式,以实现某些特定的功能或目标。它涉及到概率论、统计学、逼近论、凸分析、算法复杂度理论等多门学科,使用计算机作为工具并致力于真实实时的模拟人类学习方式, 并将现有内容进行知识结构划分来有效提高学习效率。深度学习是机器学习的一个子集或一个重要分支。深度学习是机器学习的一种方法,通过模仿人类神经网络来实现学习。深度学习的

1.是一种用于时间序列预测的深度学习模型,它结合了Transformer架构的优点和专门为时间序列设计的一些优化技术。TFT尤其擅长处理多变量时间序列数据,并且能够捕捉到长期依赖关系,同时通过自注意力机制有效地处理时序特征。TFT的工作原理主要由以下几个部分组成:1.:TFT的输入是一个多变量时间序列,每个样本包含多个特征(如10个特征,每个特征有240个时间步)。每个时间步的特征值可以是连续的(

AI基础设施运维中,传统网络遥测工具面临新挑战。AI训练流量具有同步性、突发性和结构性特征,与南北向流量模式截然不同。流量分析在AI场景下仍具价值,能有效识别性能瓶颈节点、排查I/O问题、验证网络分段及监测数据窃取行为。但需注意其局限性:无法直接反映GPU性能,且对RDMA流量不可见。合理运用流量数据可支持容量规划和异常检测,但需结合其他工具进行深度诊断。

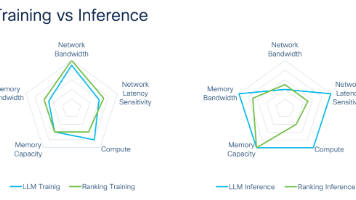

摘要:LLM(大语言模型)和Ranking(排序模型)代表了AI领域两大核心技术范式。LLM作为生成式大模型,体现大参数量、长序列、高算力需求等极端性能挑战;Ranking作为判别式模型,覆盖高并发、低延迟等工业级在线服务需求。二者共同涵盖了从训练到推理的核心性能瓶颈:LLM在训练阶段面临显存、并行、计算效率等挑战,推理阶段存在高延迟、低吞吐问题;Ranking则需解决多特征融合、增量训练等训练难

传统的时序预测方法,如 ARIMA、LSTM 等,虽然有较好的性能,但通常在处理复杂的、包含多种输入特征的时序数据时,表现不佳。TFT 是在 Transformer 的基础上进行了改进,专门针对多变量时序数据的建模需求,提出了一些新技术,使其更适合进行长时间序列的预测,尤其是在金融、医疗和工业领域等应用场景中。总体来说,TFT 结合了 Transformer 和传统时序建模技术的优点,是一个非常强

时间卷积神经网络(Temporal Convolutional Network,TCN)是一种具有时序特性的卷积神经网络,由Lea等人于2016年首次提出,起初应用于视频里动作的分割,后逐渐拓展到了一般性时序领域。TCN将一维全卷积网络、因果卷积和膨胀卷积结合在一起,具有稳定性更高,求解速度更快等优点。

众所周知,机器学习是一门跨学科的学科,主要研究计算机如何通过学习人类的行为和思维模式,以实现某些特定的功能或目标。它涉及到概率论、统计学、逼近论、凸分析、算法复杂度理论等多门学科,使用计算机作为工具并致力于真实实时的模拟人类学习方式, 并将现有内容进行知识结构划分来有效提高学习效率。深度学习是机器学习的一个子集或一个重要分支。深度学习是机器学习的一种方法,通过模仿人类神经网络来实现学习。深度学习的