简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

摘要: ROCm是AMD推出的开源GPU计算平台,旨在挑战NVIDIA CUDA在高性能计算领域的地位。其核心组件包括支持Radeon和Instinct GPU的硬件层、ROCr运行时及HIP工具,后者可实现CUDA代码向ROCm的移植。ROCm还提供对标CUDA的数学库(如rocBLAS、MIOpen),优化HPC和AI任务。尽管开源策略带来透明度和社区优势,但ROCm仍面临生态系统成熟度、性能

本文详细介绍了在Linux系统上安装NVIDIA GPU驱动和CUDA工具包的完整流程。主要内容包括:1)安装前的系统环境检查与硬件要求;2)通过系统包管理器或官方安装程序安装GPU驱动的详细步骤;3)CUDA工具包的版本选择、安装流程及环境配置;4)cuDNN的安装与验证方法。文章提供了多种安装方式的比较,包含代码示例和命令操作,适用于开发者配置深度学习开发环境。

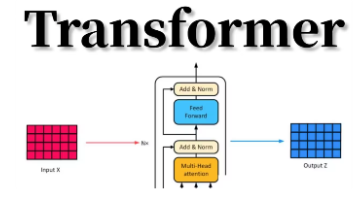

本文深入解析了Transformer中前馈神经网络(FFN)的关键作用。FFN采用两层全连接结构,通常隐藏层维度是输入维度的4倍,在Transformer块中承担了约2/3的参数。通过激活函数,FFN实现了非线性变换能力,在自注意力机制后进一步处理特征。实验分析表明,FFN的内存占用和计算复杂度与输入序列长度线性相关,是Transformer模型性能的重要决定因素。

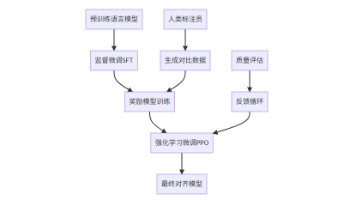

本文深入解析了基于人类反馈的强化学习(RLHF)技术原理及其在大型语言模型中的应用。RLHF通过三阶段训练流程实现模型与人类价值观的对齐:1)监督微调(SFT)使用高质量标注数据优化预训练模型;2)奖励模型训练学习人类偏好,构建响应质量评估体系;3)近端策略优化(PPO)基于奖励反馈微调模型。该技术有效解决了语言模型在价值观对齐、意图理解和安全性等方面的关键问题,已成为ChatGPT等先进模型的核

大语言模型演进全景图 前Transformer时代(2017前): 依赖统计语言模型和RNN/LSTM 面临长距离依赖、并行化困难等局限 Transformer革命(2017): 自注意力机制实现完全并行化 催生BERT(编码器)和GPT(解码器)两大流派 预训练时代(2018-2019): BERT开创双向预训练范式 GPT系列展示生成式潜力 规模扩展(2020-2021): GPT-3展现17

本文介绍了使用CUDA实现向量加法的并行计算过程。首先回顾了CUDA中主机(CPU)和设备(GPU)的核心概念与分工,然后详细阐述了CUDA向量加法程序的六个关键步骤:主机初始化、设备内存分配、数据传输、内核启动、结果回传和资源清理。重点讲解了kernel函数vectorAdd的实现原理,包括线程索引计算和边界检查机制,并提供了完整的主机端代码实现,涵盖内存管理、线程配置和结果验证等内容。通过对比

本文深入探讨大模型微调技术,重点解析如何将通用AI能力转化为专业生产力。文章对比了提示工程与微调技术的差异,指出微调在垂直领域任务中的优势。核心内容聚焦参数高效微调技术(PEFT)特别是LoRA方法,详细讲解其实现原理和代码实践,显著降低算力需求(7B模型仅需16.5GB显存)。文章提供完整的六步实战流程,从数据准备到模型部署,并给出显存占用分析和优化策略,包括4-bit量化等进阶技术。通过这套方

本文分析了RTX4090魔改48GB显存的技术路线,并探讨了RTX5090魔改128GB显存的可行性。RTX4090通过PCB背面加装12颗GDDR6X显存颗粒和VBIOS固件改造实现48GB容量,其成功验证了英伟达显卡的硬件复用设计。而RTX5090要实现128GB需突破32Gb GDDR7颗粒量产和显存控制器兼容性两大技术壁垒,目前仅理论可行。文章还预测了魔改技术对产业链的影响,包括加速GDD

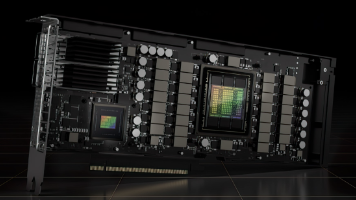

NVIDIA GPU架构十年演进:从通用计算到AI与光追的融合 2010-2022年间,NVIDIA GPU架构经历了显著的技术转型: Fermi(2010)奠定现代GPU计算基础,首次实现通用计算能力 Kepler(2012)和Maxwell(2014)专注于能效比革命 Pascal(2016)引入AI计算支持,采用16nm工艺和HBM2显存 Volta(2017)首次集成专用张量核心,大幅提升

NVIDIA发布革命性Blackwell Ultra GB300 GPU,开启AI计算新纪元。这款采用双芯片架构的GPU基于台积电4NP工艺,集成2080亿晶体管,配备288GB HBM3e内存和8TB/s带宽,计算性能达15-20 PetaFLOPS。其创新之处包括:10TB/s芯片间互联的NV-HBI技术、第四代TensorCore支持多种精度计算、NVLink 5.0实现1.8TB/s互连带