简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

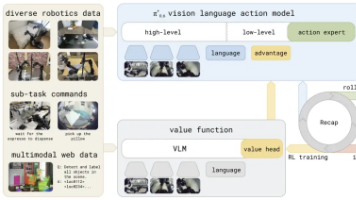

从离线强化学习到在线强化学习的范式转变,数据飞轮高效轮转在这其中发挥着异常重要的作用。但想让这个数据飞轮转得更快、更稳、更有效率,从算法到数据,从真机到数据池,每一个环节的设计都非常关键。2026年以来,**上海创智学院联合智元机器人相继推出SOP和LWD两项工作,**是具身领域如何构造切实可用的数据飞轮,让众多本体在真实场景下“越工作越强”的代表性和开创性工作。

近日,Neuracore AI CEO、RLBench 一作、前Dyson机器人技术负责人 Stephen James在X平台上发表了一个帖子。主要观点是,“全量微调VLA正在摧毁你花预训练预算建立的那些先验知识”,同时也引出了一个名叫(来自原力灵机和中科院自动化所),并剖析方法是如何轻成本微调,同时保留了先验知识。这也引出了,行业对VLA的微调任务长期以来的态度和痛点。把“预训练只是更聪明的随机

机器人是否真的需要一亿小时数据,今天还很难给出确定答案。但这句话背后可以折射出一个提醒:如果具身智能希望复制大模型时代的能力跃迁,就必须面对数据规模、数据质量和数据组织方式这三个问题。过去几年,行业已经证明了真机数据的价值,也证明了遥操作路线的有效性。但这条路径成本高、扩展慢、强依赖本体,很难单独支撑通用机器人模型走向下一阶段。human data 路线提供了另一种可能。从人类在真实世界中的动作痕

机器人是否真的需要一亿小时数据,今天还很难给出确定答案。但这句话背后可以折射出一个提醒:如果具身智能希望复制大模型时代的能力跃迁,就必须面对数据规模、数据质量和数据组织方式这三个问题。过去几年,行业已经证明了真机数据的价值,也证明了遥操作路线的有效性。但这条路径成本高、扩展慢、强依赖本体,很难单独支撑通用机器人模型走向下一阶段。human data 路线提供了另一种可能。从人类在真实世界中的动作痕

真实机器人上的强化学习确实很容易出现不稳定,尤其是在多任务、长任务和大模型策略的场景下。LWD 中重点防范的典型问题包括:critic 过估计、策略更新过大导致原有能力退化、长任务 sparse reward 传播太慢,以及在线数据中混入人类干预后造成训练目标不一致。系统主要通过几类设计来解决这些问题。第一,使用 DIVL,也就是 distributional value learning,而不是

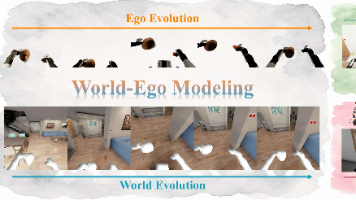

最近,视频世界模型正在从“生成好看的视频”,走向“预测机器人在物理世界中的未来”。从机器人数据生成,到策略评估,再到长时序任务想象,大家都希望模型能够提前“想象”机器人接下来会看到什么、会怎样行动、世界会怎样变化。但一进入具身场景,尤其是长时序任务,问题就不再只是画面质量。机器人需要一边导航、一边操作、一边根据连续指令改变环境。模型既要记住房间布局、物体位置、场景结构,又要预测机器人手臂、被操作物

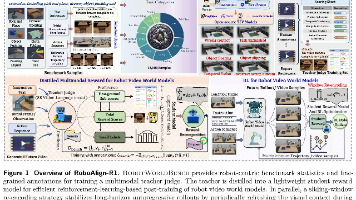

用蒸馏多模态奖励解决训练错位,让模型以任务与物理为优化目标;用在线迭代蒸馏保证奖励精准,避免模型作弊与分布偏移;用滑动窗口重编码解决长时序漂移,以极低开销实现稳定预测。三者结合,构成了可落地、高性能、高效率的机器人世界模型训练与推理体系。RoboAlign-R1 面向机器人视频世界模型,提出了一套训练对齐 + 推理稳定的完整方案,解决了当前领域最核心的痛点:提出蒸馏多模态奖励对齐框架,让世界模型从

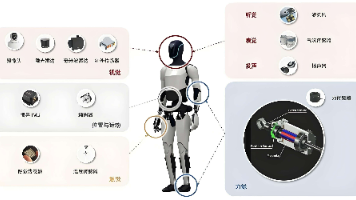

正如开头所说,本文更多地是为初学者提供对整条链路的抽象,给出一张“知识地图”,很多具体环节的实现细节并没有深入介绍。最后,汇总一下各个层级所涉及到的岗位。传感器:常见岗位包括传感器工程师、硬件工程师、电子工程师、嵌入式工程师、标定工程师、测试工程师等。他们主要负责相机、深度相机、LiDAR、IMU、编码器、力/力矩传感器、触觉传感器等硬件的选型、集成、驱动、同步、标定和可靠性测试。这个方向更靠近硬

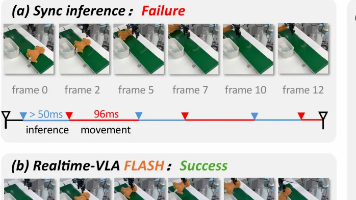

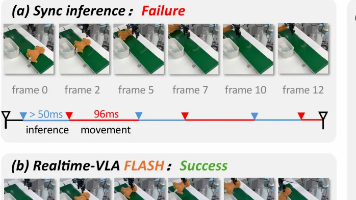

在具身智能的研究前沿,扩散式视觉-语言-动作模型(Diffusion-based VLAs)因其在连续动作空间中出色的多模态分布建模能力,已成为复杂机器人操作任务的主流范式。然而,高昂的完整推理延迟导致的“动作滞后”问题,严重制约了此类模型在真实、动态场景中的部署。针对具身智能的实时性(Real-time)挑战,在 V1 中,团队聚焦底层系统与算子优化,通过消除推理计算冗余,使百亿参数大模型在单张

在具身智能的研究前沿,扩散式视觉-语言-动作模型(Diffusion-based VLAs)因其在连续动作空间中出色的多模态分布建模能力,已成为复杂机器人操作任务的主流范式。然而,高昂的完整推理延迟导致的“动作滞后”问题,严重制约了此类模型在真实、动态场景中的部署。针对具身智能的实时性(Real-time)挑战,在 V1 中,团队聚焦底层系统与算子优化,通过消除推理计算冗余,使百亿参数大模型在单张