简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

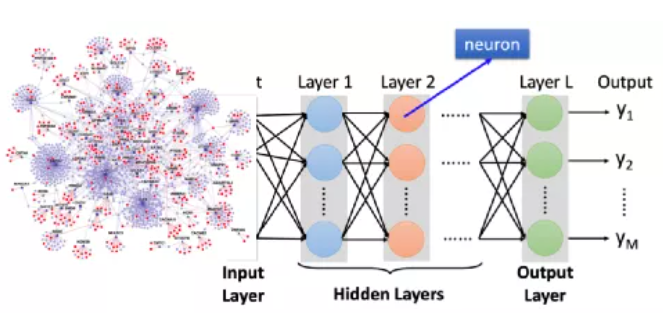

人工神经网络的灵感来自生物神经网络。神经元是生物神经网络的原子单元。每个神经元由树突,细胞核和轴突组成。它通过树突接收信号,并通过轴突进行(图1)。计算在核中进行。整个网络由一系列神经元组成。人工智能研究人员借用这个想法来开发人工神经网络(ANN)。它以加权方式累积来自各种其他神经元或输入的输入它总结了所有输入信号基于求和值,它调用激活函数因此,每个神经元可以分类一组输入是属于一个类还是另一个类。

①人工智能/大模型学习路线②AI产品经理入门指南③大模型方向必读书籍PDF版④超详细海量大模型实战项目⑤LLM大模型系统学习教程⑥640套-AI大模型报告合集⑦从0-1入门大模型教程视频⑧AGI大模型技术公开课名额。

站在巨人肩膀上”——这正是深度学习中预训练模型所带来的好处。从零开始训练深度神经网络既耗费资源又消耗时间,不过好消息是 PyTorch 的预训练模型可以很好的解决这个问题,pytorch 可以提供已在大型数据集上学习到鲁棒特征的模型,让我们可以快速将这些模型适配到特定任务中,跳过繁重的训练工作,直接进行微调。

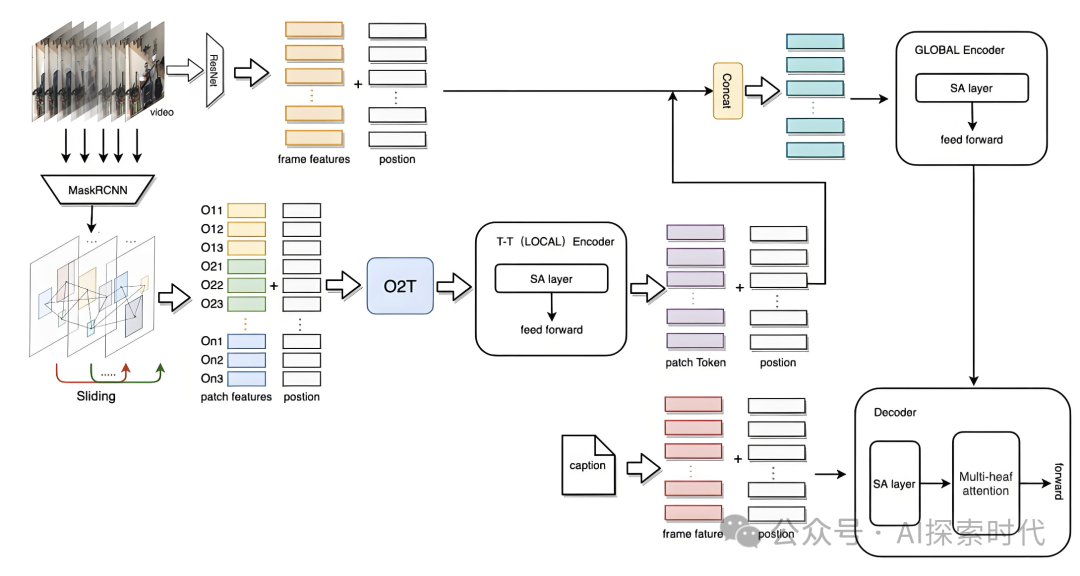

简单来说,所谓的多模态大模型就是一种能够理解和处理多种类型的机器学习模型——而类型也被叫做模态,包括文本,图片,音频,视频等。这种模型可以融合多种不同模态的信息,执行更复杂和智能的任务;如视觉问答(AI面试官),图文生成,语音识别与合成等。。

首先了解,什么是开源大模型?开源大模型是基于开放源代码和共享数据集构建的人工智能模型。市场上知名的开源大模型如Meta AI的LLaMA 3.1 405B,Mistral AI的Mistral Large 2,深度求索(deepseek)的DeepSeek-V2等,在自然语言处理、文本生成等领域展现了卓越的性能。这些模型都是开源的,并且在全球范围内被广泛使用和研究。数据来源:甲子光年智库但开源大模

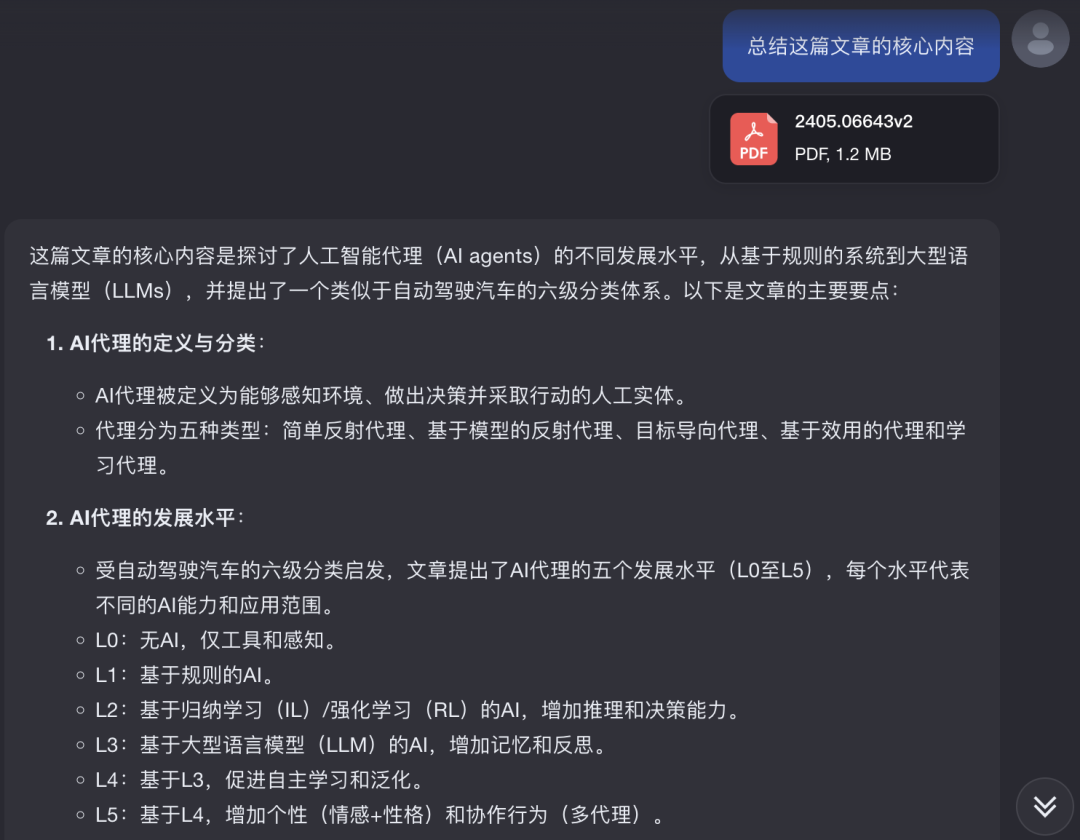

最近读了篇AI智能体论文,里面提出了一个类似于自动驾驶汽车的六级分类体系结合我之前做过的智能体,和最近在公司正在做的业务,谈谈对每个级别的理解。L0 就不说了,都没用到AI,这tm绝对是来捣乱的。其实就是设置一堆代码规则,看起来像是AI而已。比如:反作弊系统,当某IP访问超过阈值,就被判定作弊IP。这个级别的智能体是通过制定一系列“死”规则实现。这个级别的智能体通过传统的机器学习、深度学习算法,针

随着人工智能大模型技术的迅速发展,一种创新的计费模式正在逐渐普及,即以“令牌”(Token)作为衡量使用成本的单位。那么,究竟什么是Token呢?Token 是一种将自然语言文本转化为计算机可以理解的形式——词向量的手段。这个转化过程涉及对文本进行分词处理,将每个单词、汉字或字符转换为唯一的词向量表示。通过计算这些词向量在模型中的使用次数,服务提供商就能够量化用户所消耗的计算资源,并据此收取费用。

在展开之前,有必要澄清下当下大家经常听到的 AI 产品的概念,我对它的定义是基于生成式 AI 技术构建的软硬件产品,而生成式 AI 是人工智能的一个分支,其核心是能够生成随机内容的计算机模型,常见的生成式 AI 模型包括生成式对抗网络 (GAN),变分自动编码器 (VAE),大型语言模型 (LLM)等,基于生成式 AI 技术的应用示例有 ChatGPT、DALL-E、Google Bard、Mid

我们将讨论以下内容:• 构建我们自己的自定义 AI 工具供智能体使用• 创建智能体并为其提供我们构建的自定义工具• 构建一个工具,用于使用 Neo4j 向量索引进行向量搜索• 构建另一个工具,将自然语言转换为 Cypher 查询代码

本文将从什么是CNN?什么是RNN?什么是Transformer?三个问题,带您一文搞懂人工智能基础(下):神经网络结构。