简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

将你的想法落地,本质上是在构建一个“可微分的操作系统”解析型 Head调度器(Scheduler):根据规则分配任务。寻址型 Head内存管理器(MMU):管理 AI 内存的地址管道。取值型 HeadCPU/ALU:执行具体的数据操作。这种白盒规则(逻辑骨架) + 黑盒 QKV(神经直觉)的结合,正是下一代 AI 架构打破算力诅咒的最优解。

这是一个非常深入的问题。在LLM(大语言模型)中,QKV并没有显式的“开关”来决定走哪条路,所谓的“逻辑通路自适应”,本质上是的过程。我们可以用和这两个机制来解释这个过程,这比单纯的梯度下降更形象。

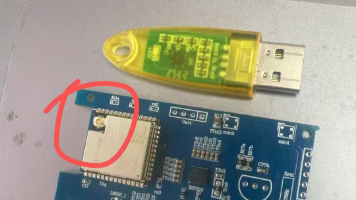

做了一块可以调用百度云语音识别api和语音合成tts接口的esp32 s3开发板,支持跑ai小智机器人的源码,基于idf5.5.1库编译,分享

python复制下载# 嵌入层self.position_embedding = nn.Embedding(100, d_model)# 最大长度100# 变量状态记忆槽(模拟变量存储)self.variable_slots = nn.Parameter(torch.zeros(5, d_model))# 5个变量槽# Transformer编码器# 数值提取头(识别数字)nn.ReLU(),#

QKV机制通过模式匹配和权重分配来模拟变量访问,通过前馈网络实现数值计算,通过层间传递保持状态。虽然不是传统意义上的变量系统,但足够强大的Transformer可以学习到类似的抽象操作,实现累加、存储、读取等功能。

损失函数扩展:代码训练不只是交叉熵,还包括结构损失、语法损失注意力模式:代码训练使注意力权重学习特殊模式(作用域、语法配对)多任务学习:通过多种相关任务(掩码预测、类型推断)联合训练层次化训练:先学轮廓,再学细节评估驱动:编译通过率、语法正确性等指标指导训练本质:在代码训练中,WqWkWv等权重通过反向传播更新,学习捕捉代码特有的结构模式、语法约束和逻辑关系,而不仅仅是文本的统计规律。模型通过预测

stm32单片机裸机调用百度语音识别接口和合成接口的部分代码实现,有意向的可以联系我 qq790861133 ---作者:阮丁远先介绍个要用到的函数:lwip 下 WebClient或者说http cilent的实现:int8_t WebClient(const char *url, const char *post, uint8_t **pageBuf,uint8_t is...