简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

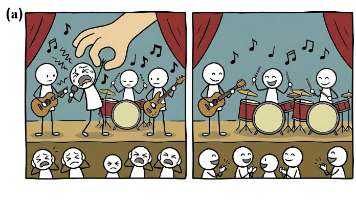

这篇博客主要介绍一种Model-free的Indirect RL方法——Monte Carlo Learning。这里的Model-free指的是Monte Carlo Learning不需要环境的模型,而是通过和环境的交互来学习。Indirect RL指的是Monte Carlo Learning不直接优化策略,而是通过求解Bellman方程来学习策略。

原书第五单元DP(动态规划)部分。本部分因为内容太多,因此分成几部分发布。这是第二部分。

本单元作为Reinforcement Learning for Sequential Decision and Optimal Control这本书第一单元的读书笔记,算是一个入门的笔记。介绍了强化学习的历史渊源和面临的挑战。这个单元的内容以介绍性的为主,因此就简单写写。

本文从技术角度详细分析了LeCun关于近日发表的“相比于强化学习(RL),我确实更喜欢模型预测控制(MPC)。”的说法,就MPC与强化学习哪个更好提出了自己的看法。笔者认为,MPC与强化学习各有优劣。但是,在方法的灵活性、可扩展性等方面强于MPC,更适合用于解决实际情景中的复杂任务。

对应于原书第八单元Approximate Dynamic Programming,主要讲述了近似动态规划算法(ADP)。本次文章分两次发布。

本篇博客对应于原书的第十单元,重点讲述了深度强化学习(Deep Reinforcement Learning,DRL)的基础知识。深度强化学习时神经网络与强化学习的结合,需要进行大量的交互并消耗巨量的计算资源。在早期因为硬件计算资源的限制,并未受到太多重视。但是近些年来随着计算能力的不断提高,将深度学习与强化学习结合的研究取得了巨大的进展。AlphaGo及其后继者不断战胜人类顶尖高手标志着人工智能

对应于原书第九单元State Constraints and Safety Consideration,主要讲述了强化学习中的约束和安全考量。本次文章分三次发布。这是第一篇。

清华大学与滴滴实验室联合提出STAPO算法,解决大模型强化学习训练中的策略熵失稳问题。该算法通过词元级分析,定义"虚假词元"概念,并开发S2T机制剔除有害梯度。在六个数学推理基准测试中,STAPO超越GRPO等现有算法,性能提升3.69%-7.13%,同时保持更稳定的训练过程。研究为基于词元的大模型训练提供了新思路,相关成果已发表于arXiv。

本文从技术角度详细分析了LeCun关于近日发表的“相比于强化学习(RL),我确实更喜欢模型预测控制(MPC)。”的说法,就MPC与强化学习哪个更好提出了自己的看法。笔者认为,MPC与强化学习各有优劣。但是,在方法的灵活性、可扩展性等方面强于MPC,更适合用于解决实际情景中的复杂任务。