简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

新兴世界模型根据动作(如相机移动和文本提示等控制信号)自回归地生成视频帧。 由于时间上下文窗口大小有限,这些模型在重访期间往往难以保持场景的一致性,从而导致对先前生成的环境的严重遗忘。 受人类记忆机制的启发,我们引入了一个新的框架,通过基于几何学的长期空间记忆来增强视频世界模型的长期一致性。 我们的框架包括从长期空间记忆中存储和检索信息的机制,我们策划了自定义数据集,以训练和评估具有显式存储的3D

本研究针对大型语言模型在医疗问答领域的应用局限性,构建了目前规模最大的医疗推理数据集ReasonMed。通过多智能体验证系统从170万条初始推理路径中筛选出37万高质量示例,并创新性地设计了错误精炼机制优化数据质量。研究发现,结合详细思维链推理与简洁答案摘要的混合策略是最有效的微调方法。基于此训练的ReasonMed-7B模型在多项医疗问答基准测试中表现优异,较同类最佳模型提升4.17%,甚至在P

本研究引入ScienceBoard平台,评估多模态自主代理在科学工作流程中的表现。ScienceBoard包含逼真的多领域环境(集成专业软件)和169个经验证的跨学科任务基准。结果显示,最先进模型(GPT-4o、Claude3.7等)整体成功率仅15%,在复杂视觉任务和领域专业知识要求高的任务表现欠佳。多模态输入(文本+视觉)显著提升性能,但代理仍存在规划与执行脱节、视觉理解不足等问题。研究提出了

生成式人工智能在文本、图像、音频和视频领域取得了显著进展,但在3D生成领域仍面临数据稀缺、算法局限性和生态系统碎片化等挑战。为此,我们提出了Step1X-3D框架,通过严格的数据管理流程处理超过500万个资产,创建了一个包含200万个高质量3D模型的数据集。该框架采用两阶段3D-native架构,结合混合VAE-DiT几何生成器和基于扩散的纹理合成模块,以提高生成模型的几何精度和纹理保真度。Ste

Bielik11Bv2是一款专为波兰语文本处理优化的先进语言模型,基于Mistral7Bv0.2架构,通过深度上采样技术扩展至110亿参数。该模型在波兰语基准测试中表现卓越,同时具备强大的跨语言能力。Bielik11Bv2引入了两项关键技术:加权指令交叉熵损失和自适应学习率,有效提升了模型性能。在多个基准测试中,Bielik11Bv2超越了更大规模的模型,并在语言理解和复杂推理任务中显著优于其他波

TTT层的核心思想是将隐藏状态本身视为一个神经网络,并通过在测试时间进行训练来更新这个神经网络。这种方法使得隐藏状态能够表达更丰富的信息,从而提高模型处理长上下文的能力。具体来说,TTT层通过梯度下降来优化隐藏状态,使其能够更好地压缩历史上下文。在本文中,TTT层被实例化为一个包含两层MLP(多层感知机)的模型,其中隐藏层的维度是输入维度的四倍,并使用GELU激活函数。为了稳定训练过程,TTT层还

通过先进的机器人技术和人工智能,科学发现有望取得快速进展。目前的科学实践面临着巨大的局限性,因为人工实验仍然耗时耗力,而多学科研究需要知识整合,超越单个研究人员的专业知识边界。在这里,我们设想了一个自主的通才科学家(AGS)概念,它将代理人工智能和具身机器人技术结合起来,使整个研究生命周期自动化。该系统可以与物理和虚拟环境动态交互,同时促进跨不同科学学科的知识整合。

物理人工智能系统需要在物理世界中感知、理解并执行复杂动作。在本文中,我们介绍了Cosmos-Reason1模型,该模型能够通过长链思维推理过程理解物理世界,并以自然语言生成适当的具身决策(例如,下一步动作)。我们首先定义了物理人工智能推理的关键能力,重点聚焦于物理常识和具身推理。为了表示物理常识,我们采用了一种层次化本体论,它捕捉了关于空间、时间和物理学的基本知识。对于具身推理,我们依赖于一种二维

东南亚(SEA)是一个语言和文化多样性极为丰富的地区,然而在视觉-语言(VL)研究中,该地区的代表性仍然严重不足。这往往导致人工智能(AI)模型无法捕捉到东南亚文化的细微差别。为了填补这一空白,我们推出了SEA-VL,这是一项开源倡议,旨在为东南亚语言开发高质量、具有文化相关性的数据。通过邀请来自东南亚国家的贡献者参与,SEA-VL旨在确保更好的文化相关性和多样性,促进在视觉-语言研究中对代表性不

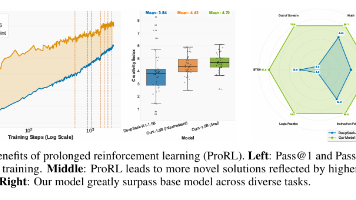

摘要:本研究挑战了强化学习(RL)仅放大语言模型已有能力的观点,提出通过Prolonged RL(ProRL)训练可发现全新推理策略。ProRL方法整合KL散度控制、策略重置和多样化任务,在16,000 GPU小时的训练后,模型在数学、代码等任务上pass@1准确率提升14.7%-54.8%,特别解决了基础模型完全失败的场景。研究表明RL能持续扩展推理边界,其效果取决于基础模型能力和训练时长。虽然