简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

EAGLE-3: Scaling up Inference Acceleration of Large Language Models via Training-Time Test

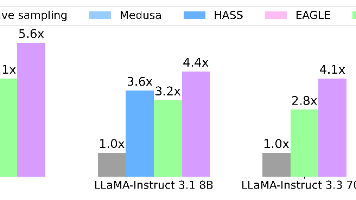

本文提出EAGLE-3方法,通过改进草稿模型训练策略显著提升LLM推理效率。该方法取消特征预测约束,改为直接训练草稿模型进行token预测,并引入多层特征融合机制提供更丰富的语义信息。实验表明,EAGLE-3在保持无损加速的前提下,加速比可达3.0x-6.5x,较前代提升1.4倍,并首次展现出推理加速随训练数据规模增长的scaling law特性。该方法通过训练时模拟多步生成过程,有效缓解误差累积

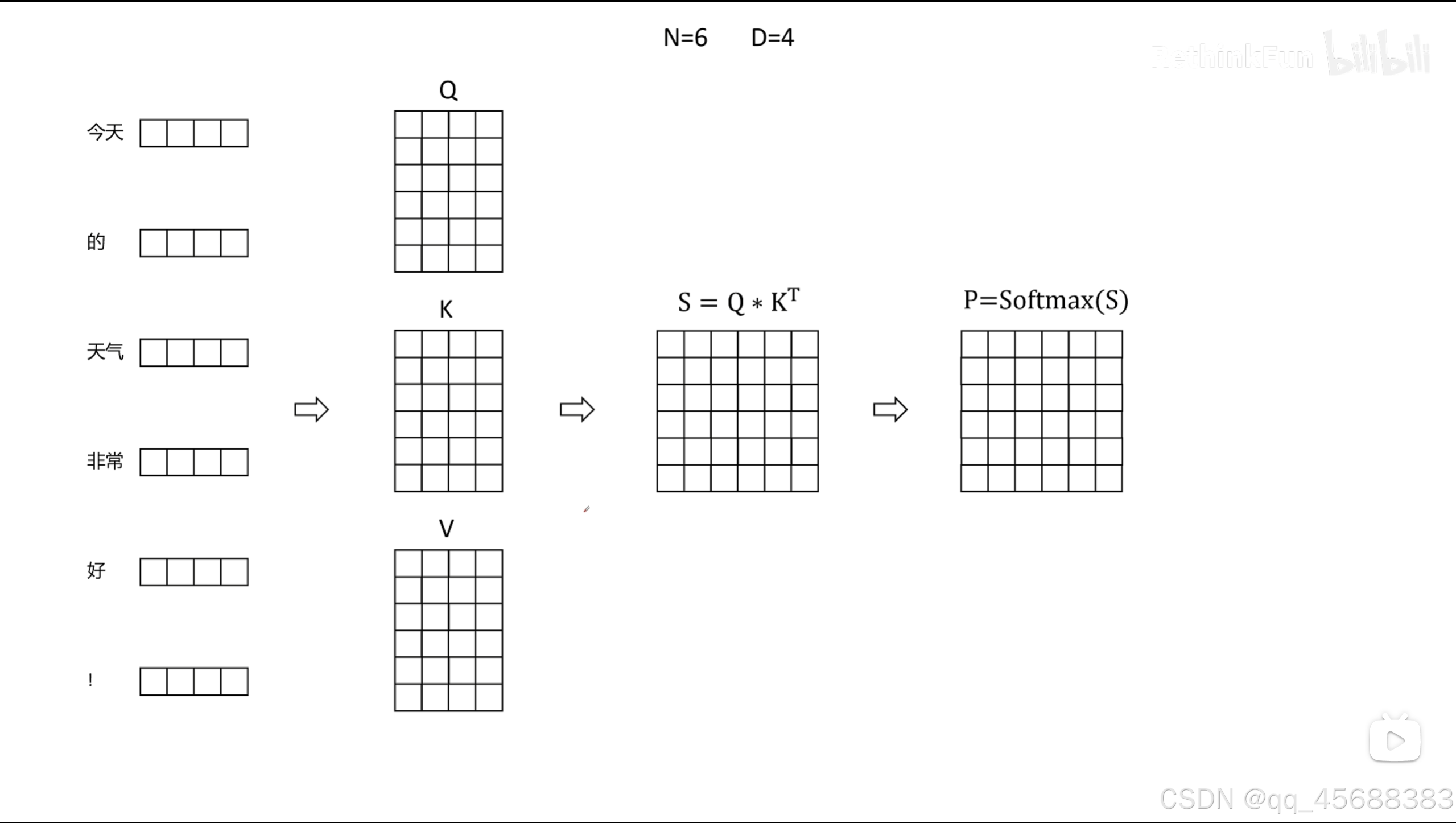

FlashAttention:深度学习中的高效注意力机制

FlashAttention 通过分块计算、块内归一化和 CUDA 并行化技术,显著提高了注意力机制的计算速度和内存效率。它在自然语言处理、计算机视觉和语音识别等多个领域具有广泛的应用前景。通过本文的介绍和公式推导,希望读者能够更好地理解和应用 FlashAttention,为深度学习模型的训练和推理提供更高效的支持。

深度学习推理框架对比表

未完待续…

到底了